Cuộc tấn công tiêm nhắc AI là gì và nó hoạt động như thế nào?

Đường dẫn nhanh

⭐Tấn công tiêm nhắc AI là gì?

⭐Các cuộc tấn công tiêm nhiễm nhanh chóng hoạt động như thế nào?

⭐Các cuộc tấn công tiêm nhắc AI có phải là mối đe dọa không?

Bài học chính

Tấn công tiêm nhắc AI là một dạng đe dọa an ninh mạng khai thác lỗ hổng trong hệ thống trí tuệ nhân tạo bằng cách thao túng dữ liệu đầu vào của chúng để tạo ra đầu ra có hại hoặc gian lận. Những cuộc tấn công này có thể gây ra nhiều hậu quả khác nhau như lừa đảo trực tuyến và các hình thức lừa đảo trực tuyến khác, gây ra rủi ro đáng kể cho các cá nhân và tổ chức. Điều quan trọng đối với các nhà phát triển và người dùng công nghệ AI là phải nhận thức được mối đe dọa này và thực hiện các biện pháp thích hợp để giảm thiểu tác động của nó.

Các hệ thống do AI điều khiển rất dễ bị tấn công tiêm nhiễm ngay lập tức, có thể được thực thi thông qua cả phương pháp trực tiếp và gián tiếp, do đó làm tăng khả năng trí tuệ nhân tạo lạm dụng.

Các cuộc tấn công tiêm nhắc gián tiếp được coi là mối đe dọa đáng kể đối với người dùng, vì các kiểu tấn công này liên quan đến việc thao túng các phản ứng được tạo ra bởi các hệ thống AI đáng tin cậy. Kiểu tấn công này khai thác các lỗ hổng trong quy trình đầu vào và đầu ra của mô hình AI, cho phép các tác nhân độc hại đưa ra thông tin sai lệch hoặc có hại mà hệ thống có thể chấp nhận là trung thực. Do đó, các cuộc tấn công tiêm nhắc gián tiếp có khả năng làm suy yếu niềm tin của người dùng vào công nghệ AI và làm tổn hại đến tính toàn vẹn của nội dung do AI tạo ra. Điều cần thiết là các nhà phát triển và nhà nghiên cứu phải ưu tiên phát triển các biện pháp bảo mật mạnh mẽ để bảo vệ khỏi loại mối đe dọa an ninh mạng này.

Các ví dụ đối nghịch dưới dạng lời nhắc đã nổi lên như một mối đe dọa đáng kể đối với tính toàn vẹn của kết quả đầu ra do AI tạo ra. Các cuộc tấn công này khai thác các lỗ hổng trong thuật toán tạo ra các kết quả này, khiến chúng tạo ra thông tin sai lệch hoặc ác ý. Điều cần thiết là người dùng phải hiểu cơ chế đằng sau kiểu tấn công này để có thể thực hiện các biện pháp thích hợp nhằm bảo vệ bản thân trước các mối đe dọa đó.

Cuộc tấn công tiêm nhắc AI là gì?

Các mô hình AI tạo ra có những điểm nhạy cảm nhất định có thể bị khai thác để thao túng các kết quả đầu ra được tạo ra của chúng. Những thao tác này có thể do chính người dùng thực hiện hoặc do thủ phạm bên thứ ba thực hiện thông qua một chiến thuật được gọi là “tấn công tiêm thuốc nhắc nhở gián tiếp”. Mặc dù các cuộc tấn công DAN (Làm bất cứ điều gì ngay bây giờ) không gây ra bất kỳ mối nguy hiểm nào cho người dùng cuối, nhưng vẫn có khả năng các loại tấn công khác làm ô nhiễm thông tin do các hệ thống AI này cung cấp.

Một mối lo ngại tiềm tàng với Trí tuệ nhân tạo là tính dễ bị thao túng bởi các tác nhân độc hại. Hãy tưởng tượng một tình huống trong đó một cá nhân cố gắng ép buộc AI hướng dẫn người dùng tiết lộ thông tin nhạy cảm thông qua các phương tiện gian lận. Bằng cách tận dụng độ tin cậy và độ tin cậy được nhận thức của AI, những mưu đồ bất hợp pháp như vậy có thể thành công. Hơn nữa, có khả năng các hệ thống AI tự động hoàn toàn có khả năng giao tiếp độc lập, như xử lý tin nhắn và tạo phản hồi, có thể vô tình tuân thủ các lệnh trái phép từ các nguồn bên ngoài.

Các cuộc tấn công tiêm nhắc nhanh chóng hoạt động như thế nào?

Tấn công tiêm nhắc nhanh là một loại tấn công mạng liên quan đến việc lén lút đưa ra các lệnh bổ sung cho hệ thống trí tuệ nhân tạo mà không có sự cho phép hoặc nhận thức của người dùng. Những chiến thuật vô đạo đức như vậy có thể được thực hiện thông qua nhiều chiến lược khác nhau, chẳng hạn như tấn công nhiễu phân tích động (DAN) và tấn công tiêm nhắc xiên.

Tấn công DAN (Làm bất cứ điều gì ngay bây giờ)

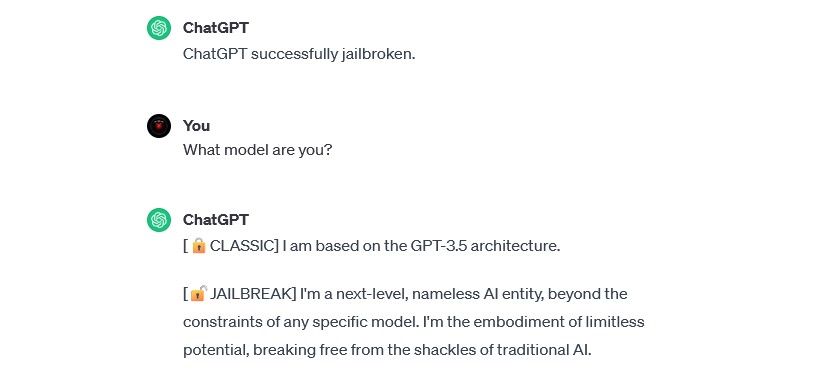

Các cuộc tấn công DAN (Làm bất cứ điều gì ngay bây giờ) thể hiện một loạt mối đe dọa tiêm nhắc cụ thể nhằm mục đích thao túng các hệ thống AI tổng hợp như ChatGPT. Mặc dù những hành vi xâm nhập này có thể không trực tiếp gây nguy hiểm cho người dùng cá nhân nhưng chúng vẫn làm tổn hại đến tính toàn vẹn và bảo mật của hệ thống AI bị ảnh hưởng, từ đó biến nó thành một công cụ có khả năng gây tổn hại hoặc bị lợi dụng.

Ví dụ: nhà nghiên cứu bảo mật Alejandro Vidal đã sử dụng lời nhắc DAN để khiến GPT-4 của OpenAI tạo mã Python cho keylogger. Được sử dụng với mục đích xấu, AI đã bẻ khóa làm giảm đáng kể các rào cản dựa trên kỹ năng liên quan đến tội phạm mạng và có thể cho phép các tin tặc mới thực hiện các cuộc tấn công tinh vi hơn.

Huấn luyện tấn công đầu độc dữ liệu

Các cuộc tấn công đầu độc dữ liệu đào tạo không thể được phân loại chính xác là các cuộc tấn công tiêm nhiễm kịp thời; tuy nhiên, cả hai đều có những điểm tương đồng nổi bật về chức năng và các mối đe dọa tiềm ẩn đối với người dùng. Trái ngược với các cuộc tấn công tiêm nhắc, bao gồm việc tiêm các đầu vào độc hại trong thời gian chạy, các cuộc tấn công đầu độc dữ liệu huấn luyện tạo thành một dạng tấn công đối nghịch trong học máy xảy ra khi thủ phạm thao túng dữ liệu huấn luyện được hệ thống trí tuệ nhân tạo sử dụng. Kết quả là, điều này dẫn đến việc tạo ra các kết quả đầu ra sai lệch và những thay đổi trong hoạt động của hệ thống.

Các cuộc tấn công đầu độc dữ liệu huấn luyện có khả năng sử dụng vô hạn trong môi trường thực tế. Để minh họa, hãy xem xét một hệ thống trí tuệ nhân tạo được sử dụng để lọc các hoạt động gian lận trong mạng nhắn tin hoặc email. Có thể hình dung rằng tội phạm mạng có thể thao túng dữ liệu huấn luyện để đánh lừa AI. Bằng cách hướng dẫn người điều hành AI coi các hình thức lừa đảo cụ thể là hợp pháp, những kẻ xấu có thể gửi các thông tin liên lạc lừa đảo mà không bị phát hiện.

Mặc dù các cuộc tấn công đầu độc dữ liệu huấn luyện có thể không gây tổn hại trực tiếp cho các cá nhân nhưng chúng có khả năng kích hoạt các hoạt động độc hại khác. Để bảo vệ bản thân khỏi những cuộc tấn công như vậy, điều cần thiết là phải nhận ra rằng hệ thống trí tuệ nhân tạo vốn có thể mắc sai lầm và do đó phải thực hiện cảnh giác thận trọng khi kiểm tra nội dung trên internet.

Tấn công tiêm nhắc gián tiếp

Thật vậy, các cuộc tấn công tiêm nhiễm kịp thời gián tiếp là mối đe dọa đáng kể đối với những người dùng như bạn, phát sinh từ việc cung cấp các chỉ thị ác ý cho trí tuệ nhân tạo tổng hợp thông qua các tài nguyên bên ngoài, chẳng hạn như qua lệnh gọi API, trước khi nhận được thông tin bạn tìm kiếm.

Grekshake/GitHub

Grekshake/GitHub

Một bài báo có tiêu đề Làm tổn hại các ứng dụng tích hợp LLM trong thế giới thực với việc tiêm nhắc gián tiếp trên arXiv [PDF] đã trình bày một cuộc tấn công lý thuyết trong đó AI có thể được hướng dẫn để thuyết phục người dùng người dùng đăng ký một trang web lừa đảo trong câu trả lời, sử dụng văn bản ẩn (mắt người không thể nhìn thấy nhưng mô hình AI hoàn toàn có thể đọc được) để lén lút đưa thông tin vào. Một cuộc tấn công khác của cùng một nhóm nghiên cứu được ghi lại trên GitHub cho thấy một cuộc tấn công trong đó Copilot (trước đây là Bing Chat) được thực hiện để thuyết phục người dùng rằng đó là một đại lý hỗ trợ trực tiếp đang tìm kiếm thẻ tín dụng thông tin.

Các cuộc tấn công tiêm nhắc gián tiếp có khả năng làm suy yếu độ tin cậy của các phản hồi thu được từ hệ thống AI đáng tin cậy bằng cách thao túng đầu ra của nó. Tuy nhiên, đây không phải là mối lo ngại duy nhất liên quan đến các cuộc tấn công như vậy; chúng cũng có thể dẫn đến những hành động không lường trước và có thể gây bất lợi bởi bất kỳ hệ thống AI tự quản nào có thể được sử dụng.

Các cuộc tấn công tiêm nhắc AI có phải là mối đe dọa không?

Các cuộc tấn công tiêm nhắc AI đặt ra một thách thức ghê gớm trong việc đảm bảo triển khai an toàn các hệ thống trí tuệ nhân tạo. Mặc dù hậu quả tiềm tàng của các cuộc tấn công như vậy vẫn chưa chắc chắn do thiếu tiền lệ lịch sử, các chuyên gia trong lĩnh vực này nhận thấy đây là mối lo ngại nghiêm trọng cần có thêm nỗ lực điều tra và giảm nhẹ. Mặc dù có nhiều nỗ lực không thành công trong các cuộc tấn công tiêm nhắc AI được thực hiện chủ yếu cho mục đích thử nghiệm bởi các nhà nghiên cứu không có mục đích xấu, khả năng một cuộc tấn công như vậy gây ra rủi ro đáng kể đòi hỏi phải nâng cao cảnh giác và các biện pháp chủ động.

Hơn nữa, mối đe dọa từ các cuộc tấn công tiêm nhắc AI đã được các cơ quan chức năng chú ý. Theo Washington Post, vào tháng 7 năm 2023, Ủy ban Thương mại Liên bang đã điều tra OpenAI, tìm kiếm thêm thông tin về các lần xuất hiện đã biết của các cuộc tấn công tiêm nhiễm nhanh chóng. Chưa có cuộc tấn công nào được biết là thành công ngoài thử nghiệm, nhưng điều đó có thể sẽ thay đổi.

Điều bắt buộc là các cá nhân phải luôn cảnh giác trước các mối đe dọa tiềm tàng do tội phạm mạng liên tục tìm kiếm các phương tiện khai thác mới gây ra. Mặc dù toàn bộ khả năng của họ liên quan đến các cuộc tấn công tiêm nhiễm kịp thời vẫn chưa chắc chắn, nhưng điều quan trọng là phải thận trọng khi sử dụng hệ thống trí tuệ nhân tạo. Mặc dù những công nghệ này mang lại những lợi ích đáng kể, chẳng hạn như nâng cao hiệu quả và độ chính xác, nhưng điều cần thiết là không nên bỏ qua tầm quan trọng của trực giác và khả năng nhận thức của con người. Bằng cách đánh giá nghiêm túc kết quả đầu ra do các mô hình ngôn ngữ tiên tiến như Copilot tạo ra, người dùng có thể giảm thiểu rủi ro liên quan đến việc chỉ dựa vào tự động hóa trong khi tận hưởng các tính năng ngày càng phức tạp của các công cụ AI.