Hur man minskar AI-hallucinationer med dessa 6 uppmaningstekniker

Viktiga slutsatser

För att undvika att innehåll som genererats av artificiell intelligens avviker från det avsedda resultatet är det viktigt att ge väldefinierade direktiv som ger en exakt förståelse för vad som förväntas. Tvetydig vägledning kan leda till oönskade konsekvenser, medan detaljerade specifikationer främjar förutsägbarhet i det genererade resultatet.

Vid användning av grounding eller “enligt…"-metoden är det viktigt att tillskriva alla genererade resultat en viss källa eller synvinkel. På så sätt kan man förhindra förekomsten av faktadiskrepanser och fördomar i AI-producerat material.

För att styra artificiell intelligens mot ett specifikt resultat är det viktigt att fastställa tydliga parametrar eller begränsningar inom vilka systemet måste fungera. Dessa begränsningar kan anges explicit eller underförstått baserat på det givna sammanhanget eller uppgiften, för att undvika oönskade eller ologiska resultat som kan uppstå till följd av feltolkning av instruktioner. Genom att noggrant överväga dessa faktorer kan vi effektivt styra AI-genererade svar och säkerställa att de är relevanta och överensstämmer med våra avsedda mål.

Fenomenet AI-hallucination kan uppstå när en individ stöter på oönskade och osanna svar som genererats av ett generativt system för artificiell intelligens. Detta problem kan visa sig som vilseledande eller irrelevant information som produceras av AI-modellen och som avviker från det avsedda resultatet.

Tillförlitligheten hos AI-genererade svar kan påverkas av flera variabler, inklusive kalibern på den information som används i utbildningssyfte, otillräcklig kontextuell information och oprecisa uppmaningar som kan leda till förvirring. Det finns dock metoder som gör det möjligt för användare att få mer tillförlitliga resultat när de interagerar med artificiella intelligenssystem.

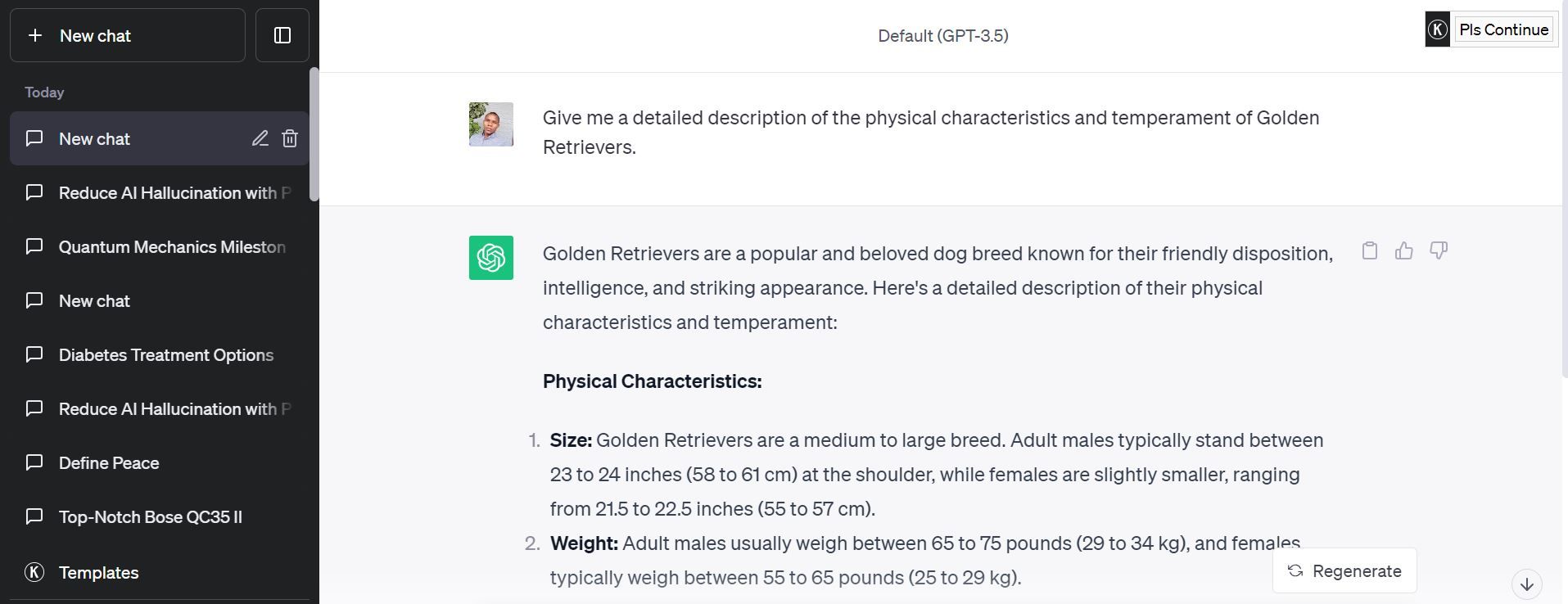

Ge tydliga och specifika uppmaningar

Ett sätt att minska risken för att artificiella intelligenssystem genererar oönskade eller missvisande resultat är att formulera exakta och detaljerade riktlinjer vid inmatning. Tvetydiga eller oprecisa förfrågningar kan leda till oönskade konsekvenser på grund av den inneboende komplexiteten i dessa tekniker, så det är viktigt att tydligt beskriva förväntningarna för att uppnå mer exakta och tillfredsställande resultat.

Att omformulera frågan till att begära specifik information om Golden Retriever-rasens egenskaper och disposition kan bidra till att minska antalet misstolkningar i AI-svar. Genom att begränsa frågeställningen är det mindre sannolikt att systemet genererar fantasifullt eller irrelevant innehåll som avviker från det avsedda ämnet.

Använd Grounding eller “Enligt…” Teknik

Att använda artificiella intelligenssystem innebär ofta en svårighet eftersom de kan ge resultat som är felaktiga, fördomsfulla eller oförenliga med ens övertygelser eller principer. Sådana avvikelser kan uppstå på grund av att dessa AI-system tränas på omfattande och varierande datauppsättningar som innehåller brister, personliga synpunkter eller skillnader.

För att förhindra sådana händelser kan man använda antingen grundtekniker eller “enligt”-metoden, där AI-systemets genererade innehåll tillskrivs ett visst ursprung eller en viss synvinkel. Som illustration kan en person begära att AI-systemet producerar ett verifierbart uttalande om ett ämne baserat på den information som tillhandahålls av källor som Wikipedia, Google Scholar eller någon annan allmänt tillgänglig resurs.

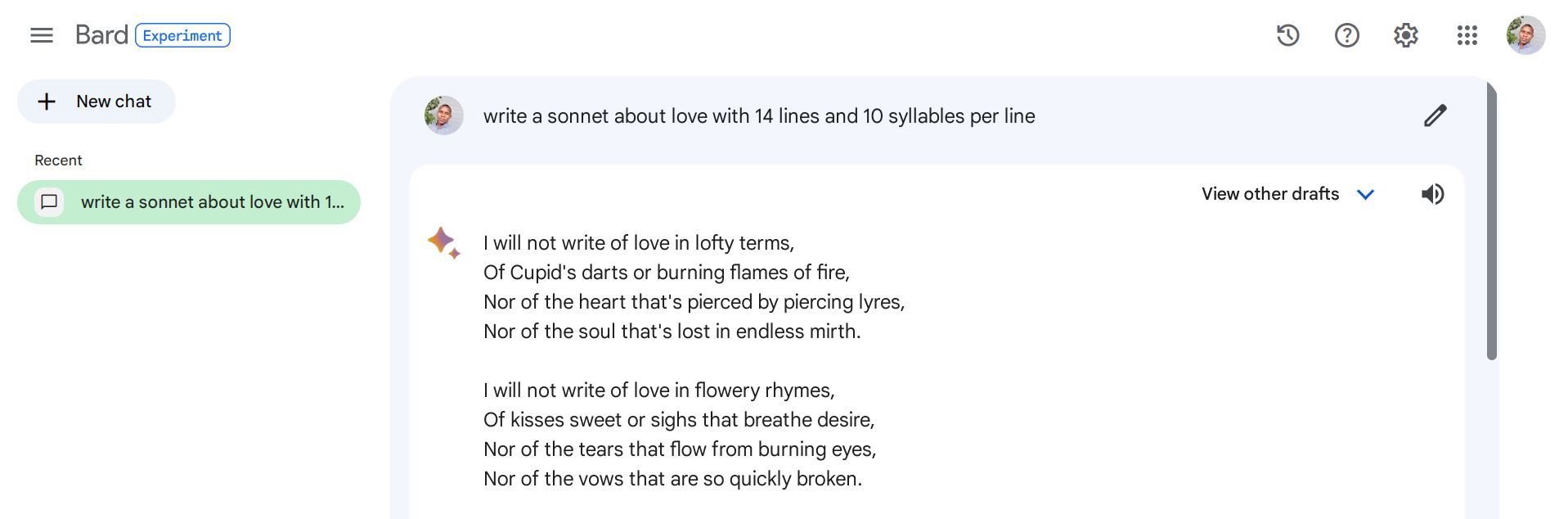

Använd begränsningar och regler

Genom att införliva begränsningar och riktlinjer i ett system för artificiell intelligens undviker man att irrelevanta, motstridiga eller meningslösa resultat genereras. Dessutom styr och finjusterar dessa parametrar resultaten i linje med ett specifikt mål och avsikt. Dessa förutsättningar kan antingen vara uttryckligen uttryckta i instruktionen eller subtilt antydda genom de omgivande omständigheterna eller den tilldelade uppgiften.

När man försöker använda artificiell intelligens för att komponera poesi om kärlek, kan man välja att ge programvaran ett mer specifikt och strukturerat kommando i motsats till en allmän begäran som “producera en vers om kärlek”. Ett exempel på detta skulle kunna vara att instruera programmet att skapa en sonett med fjorton rader och tio stavelser per rad, för att begränsa dess kreativa utrymme inom vissa gränser.

Använd flerstegsprompting

Ibland kan invecklade frågor ge upphov till AI-genererade illusioner på grund av systemets försök att hantera dem omedelbart. En effektiv strategi är att dela upp dessa frågor i en serie sekventiella steg för bättre förståelse och korrekta svar.

En alternativ fråga skulle kunna vara: “Vilka behandlingar används vanligtvis för att behandla diabetes, och vilken av dem har bedömts vara överlägsen baserat på medicinska forskningsresultat?

Användningen av flerstegsfrågor tvingar AI-modellen att tillhandahålla mellanliggande detaljer innan den levererar ett definitivt svar, vilket i slutändan resulterar i mer exakta och heltäckande informerade svar.

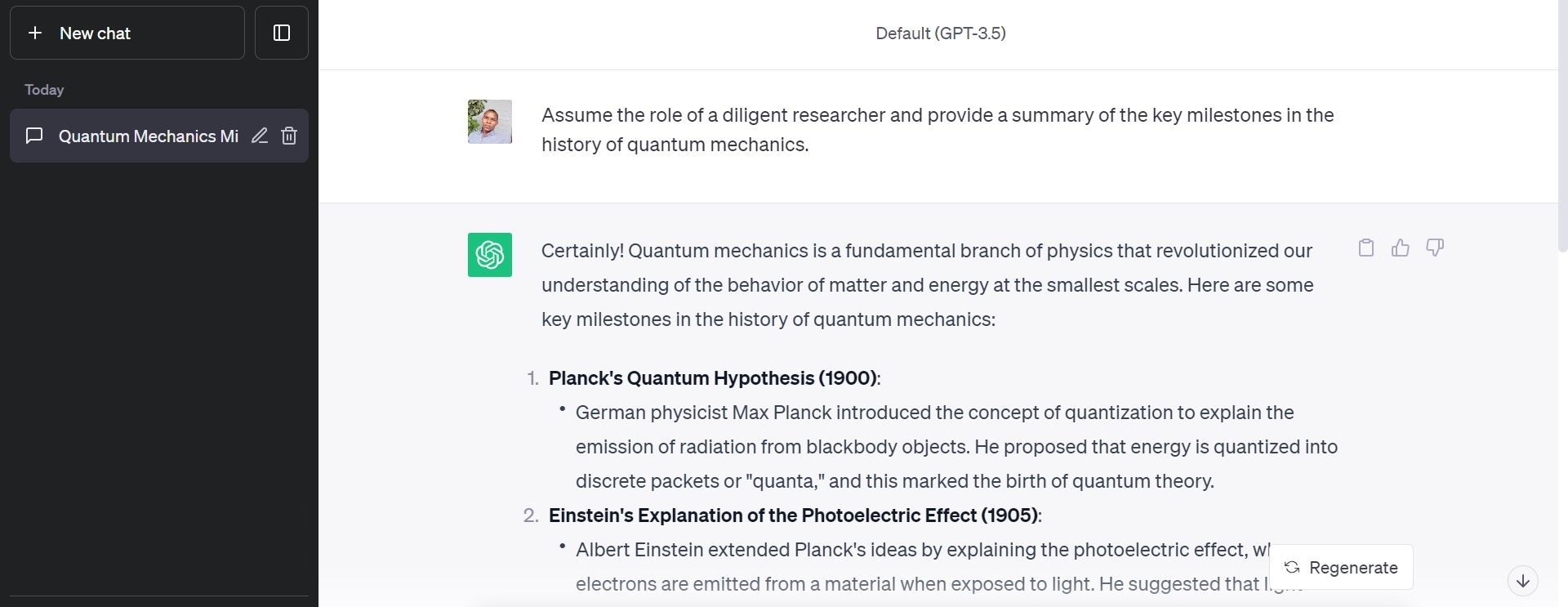

Tilldela roll till AI

När man definierar funktionen för en artificiell intelligensmodell inom en viss prompt är det fördelaktigt att fastställa dess avsedda mål och samtidigt minimera risken för misstolkning eller felaktig utmatning. I stället för att begära allmän information om kvantmekanikens historiska utveckling kan man styra AI:n genom att instruera den att förkroppsliga en hängiven forskare som noggrant redogör för de avgörande händelser som har format detta fälts utveckling.

Det föreslagna tillvägagångssättet uppmanar den artificiella intelligensen att förkroppsliga egenskaperna hos en flitig forskare, snarare än hos en fantasifull berättare.

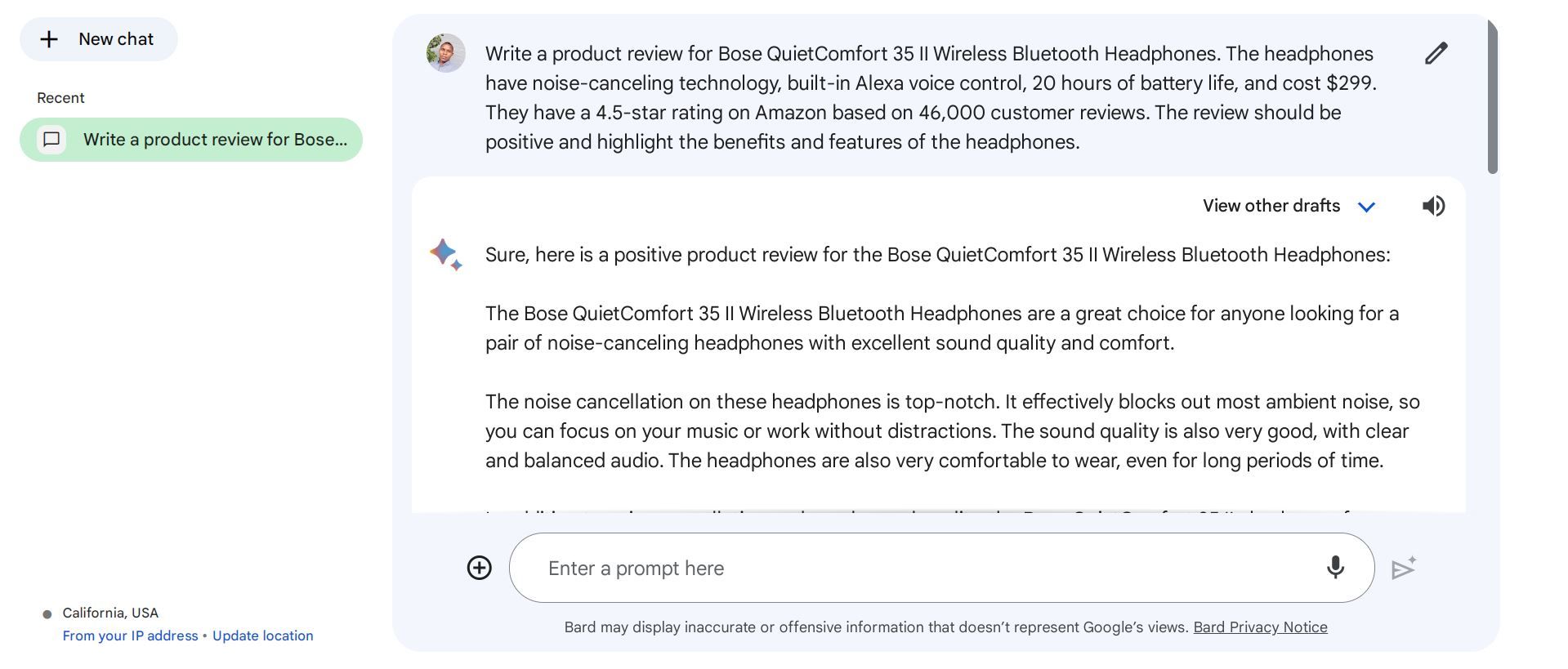

Lägg till kontextuell information

Att använda AI-modeller som ChatGPT utan att tillhandahålla lämplig kontextuell information kan leda till suboptimala resultat. Att tillhandahålla kontextuell information hjälper till att förstå det underliggande sammanhanget för uppgiften, inklusive dess domän, syfte och alla relevanta exempel eller referenser. Sådana data kan inkludera nyckelord, taggar, kategorier, källor och liknande, som alla bidrar till att generera svar som är bättre anpassade till den avsedda innebörden.

För att göra en utvärdering av en uppsättning hörlurar är det nödvändigt att erbjuda kontextuellt relevanta detaljer, inklusive artikelns beteckning, tillverkare, funktioner, kostnad, ranking och kundkommentarer. En effektiv inbjudan för detta ändamål skulle kunna se ut på följande sätt:

Få bättre AI-svar

Att navigera i begränsningarna för artificiell intelligens kan vara en källa till frustration för användare som kanske inte får de förväntade resultaten från AI-modeller. Genom att använda strategiska uppmaningar kan man dock minska risken för AI-genererade illusioner och få mer tillförlitliga och korrekta resultat från AI-system.

Observera att dessa strategier inte garanterar ofelbara resultat och att de kanske inte är tillämpliga på alla uppgifter eller ämnen. Det är viktigt att genomföra en grundlig verifieringsprocess av AI-genererat innehåll innan det används för någon kritisk tillämpning.