Vad är en AI Voice Clone Family Scam? Hur man upptäcker det

Snabblänkar

⭐ Hur fungerar en AI-röstkloningsbedrägeri?

⭐ Varför AI Voice Cloning Scams är så effektiva

⭐ Viktiga tecken på en AI Voice Clone Scam

⭐ Vad du ska göra om du misstänker en AI Voice Clone Scam

⭐ Förebyggande är det bästa försvaret mot AI Voice Cloning Scams

Viktiga Takeaways

Använda avancerad artificiell intelligens teknik, röstkloningsbedrägerier har utvecklat en metod för att troget reproducera mänskliga talmönster med anmärkningsvärd äkthet, utnyttja känslomässiga sårbarheter och skapa en känsla av brådskande hos sina offer.

Bedragare har använt information från olika sociala medieplattformar för att skapa trovärdiga situationer och dra nytta av befintliga relationer, vilket gör deras bedrägerier mer övertygande för potentiella offer.

Se upp för AI-genererade röstimitationssystem och var försiktig när du tar emot oönskade telefonsamtal eller textmeddelanden som påstås komma från en betrodd källa. Om du är osäker på om sådana meddelanden är legitima är det tillrådligt att avsluta samtalet och bekräfta eventuella påstådda nödsituationer innan du vidtar ytterligare åtgärder.

Ett brådskande röstmeddelande från dig själv når dina föräldrar sent på kvällen och framkallar en känsla av nöd när du berättar om en olycklig situation. Du berättar att din plånbok har stulits och att du nu är strandsatt på en olämplig plats, vilket kräver omedelbar ekonomisk hjälp för att du ska kunna återvända hem.

Ljudåtergivningen av kommunikationen verkar vara anmärkningsvärt verklighetstrogen och motsvarar otvetydigt de unika vokala egenskaperna hos deras avkomma - ändå är den inte äkta. Det är snarare en kopia som genererats av artificiell intelligens, och de har oavsiktligt blivit föremål för ett bedrägligt system som har både innovativa och mycket oroande effektivitetsnivåer.

Hur fungerar en AI-röstkloningsbedrägeri?

Röstkloning kan skapa otroligt realistiska digitala kopior av en persons röst. Denna teknik, som vanligtvis kallas audio deepfake , skapas med AI-röstkloningsverktyg som ElevenLabs (kolla in AI-röstklonexemplet nedan). I kombination med generativ AI och röstsyntes kan den klonade rösten återge känslor, nyanser, intonation och till och med rädsla.

Som referenspunkt kan man använda det sätt på vilket Christian Cawley uttrycker sig under sitt framträdande i The Really Useful Podcast.

För att generera en artificiell intelligens-kopia av en röst krävs vanligtvis en relativt liten mängd ljuddata - ofta inte längre än sextio sekunder. Sådana prover kan ofta erhållas genom att extrahera dem från offentligt tillgängligt onlineinnehåll som videor på sociala medier, vilket kan göra vissa individer, inklusive videobloggare och influencers, mer mottagliga på grund av att deras röstinspelningar uppvisar överlägsen ljudkvalitet och är lätta att få tag på.

När bedragarna har fått tag på ett röstprov på olaglig väg använder de antingen text-till-tal-teknik eller realtidsomvandling av tal till text för att generera vilseledande telefonsamtal och röstkommunikation.

Genom att använda en kombination av social ingenjörskonst kan bedragarna skapa en övertygande berättelse baserad på information som hämtats från offrets närvaro på nätet. De kan konstruera en berättelse som involverar en nödsituation som sjukhusvistelse eller arrestering, eller till och med mer extrema scenarier som stöld eller kidnappning. Med hjälp av avancerad tal-till-text-teknik kan de sedan utge sig för att vara en pålitlig myndighetsperson och manipulera en orolig släkting att lämna ifrån sig känslig finansiell information under sken av att hjälpa sin förmodat nödställda nära och kära.

Den djupa äktheten i rösttonerna och känslorna, i kombination med den plötsliga och pressande karaktären hos vädjan, har potential att överskugga skepticism, vilket resulterar i impulsiva val att avslöja ekonomiska resurser eller avslöja konfidentiella uppgifter.

Varför AI Voice Cloning Scams är så effektiva

AI Voice Cloning Scam kapitaliserar på styrkan i personliga relationer genom att utnyttja individer genom deras känslomässiga kontakter med andra. Denna teknik drar nytta av den sårbarhet som uppstår när en individ får ett nödsamtal som påstås komma från en älskad, vilket får dem att agera impulsivt på grund av förhöjda känslor. I huvudsak speglar denna strategi de som används i “quid pro”-bedrägerier, men dess inverkan förstärks avsevärt genom att det talade meddelandet är bekant, vilket ytterligare förvärrar mottagarens känsla av brådska och förvirring.

Personer vars nära och kära har en omfattande närvaro på nätet eller ofta reser kan vara särskilt mottagliga för sådana bedrägerier på grund av den trovärdighet som dessa omständigheter ger den bedrägliga historien. Bedragare samlar vanligtvis in och utnyttjar personlig information från sina målgruppers offentligt tillgängliga profiler på sociala medier i förväg, vilket gör deras bedrägeri ännu mer övertygande.

Viktiga tecken på bedrägeri med AI-röstklon

Trots den avancerade AI-baserade röstkloningstekniken är det fortfarande möjligt att identifiera potentiell bedräglig verksamhet genom att känna igen vissa varningssignaler eller “röda flaggor”. Dessa kan inkludera inkonsekvenser i språkanvändning, grammatikfel och en övergripande brist på sammanhang i kommunikationen. I vissa fall kan användningen av personlig information som namn, adresser och andra identifierande uppgifter också väcka misstankar. Genom att vara vaksam och medveten om dessa vanliga indikatorer på bedrägeri kan individer bättre skydda sig från att falla offer för AI-röstklonbedrägerier.

Den brådska som antyds av bedrägeriet kan skapa en känsla av omedelbarhet och få mottagarna att vidta åtgärder utan att ordentligt överväga situationen, eftersom de leds att tro att allvarliga konsekvenser kommer att följa om de inte följer den bedrägliga begäran.

Det är viktigt att vara vaksam mot bedrägerier, eftersom förövarna kanske inte har fullständig kunskap om ens personliga omständigheter eller historia med en viss person eller enhet. Därför är det viktigt att vara medveten om eventuella avvikelser i information som presenteras av individer eller organisationer som potentiellt kan tyda på bedrägliga avsikter.

Begäran om internationella penningöverföringar eller betalningar till obskyra digitala plånböcker är inte ovanliga under sådana omständigheter.

Med tanke på de utmaningar det innebär att navigera i en sådan olycklig situation kan det visa sig vara en formidabel uppgift. Men genom att ta hänsyn till dessa överväganden kan man potentiellt undvika att falla offer för bedrägliga system.

Vad du ska göra om du misstänker en AI Voice Clone Scam

När du tar emot kommunikation från älskade individer som upplever oro är det viktigt att behålla lugnet. Bedragare utnyttjar ofta förhöjda känslor som ångest och sentimentalitet för personlig vinning, vilket ökar ens mottaglighet för deras listiga manövrer.

Om du får ett telefonsamtal

Om det finns minsta tvivel om legitimiteten hos ett inkommande telefonsamtal, är det absolut nödvändigt att avsluta förbindelsen utan att tveka. Avstå från att lämna ut några personliga uppgifter eller inleda en konversation med misstänkta bedragare. För att verifiera sanningshalten i en påstådd nödsituation, kontakta den avsedda mottagaren via ett betrott kommunikationsmedel.

Dessutom är det viktigt att notera att fortsatt kommunikation med dessa individer kan resultera i att ens röstsignatur fångas, vilket kan leda till obehörig replikering eller användning för skadliga ändamål.

Om du får ett röstmeddelande

Vi rekommenderar starkt att du sparar alla röstmeddelanden från potentiella bedragare på antingen din mobila enhet eller dator. Med hjälp av avancerad teknik för artificiell intelligens, så kallade talklassificeringsverktyg, kan dessa inspelningar sedan analyseras för att avgöra om de härrör från äkta mänskliga röster eller syntetiska röster som skapats genom automatisering. En sådan analys fungerar på samma sätt som textbaserade system för att upptäcka plagiat, där ljudfilen matas in i algoritmen för identifiering.

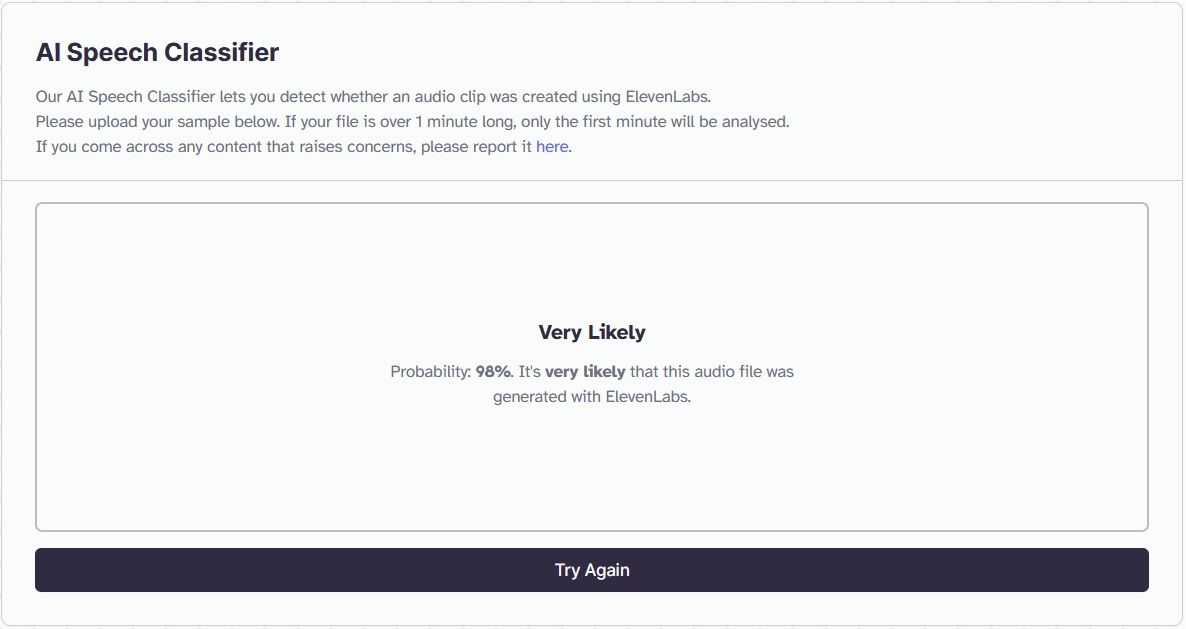

Att utvärdera äktheten hos röstprover kan göras med olika metoder, ett sådant effektivt instrument är Speech Classifier som tillhandahålls av ElevenLabs. ElevenLabs är den ledande leverantören av replikeringstjänster för artificiell intelligens och erbjuder ett tillförlitligt sätt att avgöra om ett röstprov har genomgått digital duplicering. Följ dessa steg för att använda detta verktyg för att identifiera en AI-genererad imitation:

⭐ Gå till ElevenLabs Speech Classifier .

Vänligen förse mig med en ljudfil som innehåller ett röstmeddelande, välj sedan alternativet “Identifiera konstgjord röst” efter att ha laddat upp den genom att klicka på knappen märkt “Ladda upp prov.

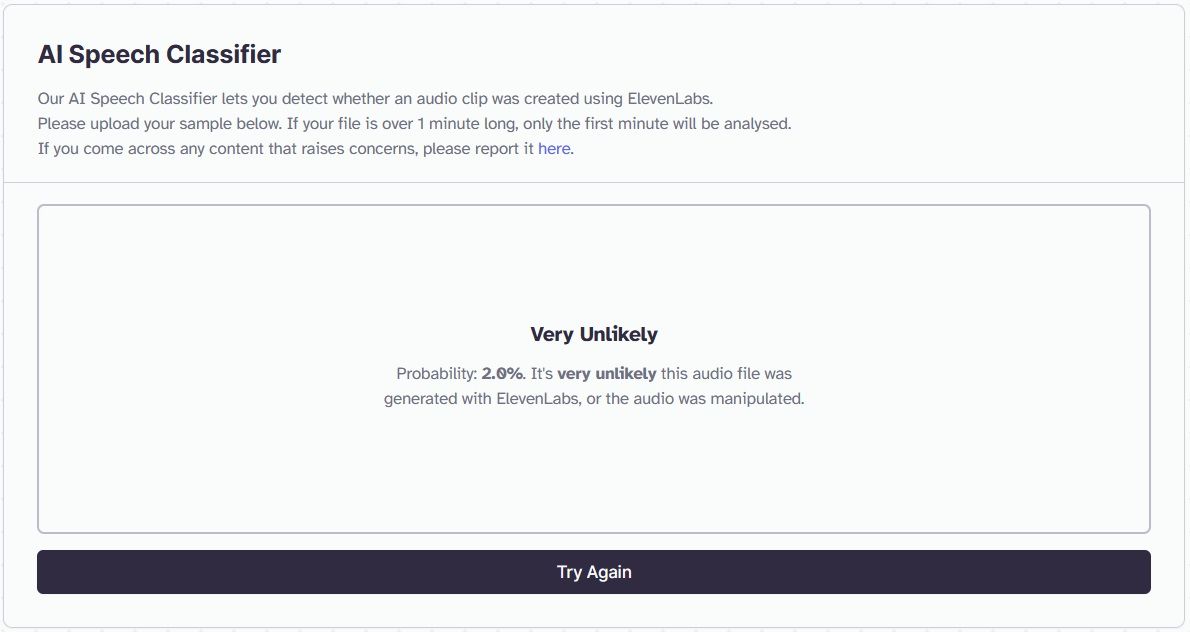

I det angivna fallet förmedlade en person ett oroande meddelande som därefter fångades upp och skickades till klassificeringssystemet för analys. Det är uppenbart att innehållet har tilldelats en blygsam sannolikhet på 2%, vilket motsvarar möjligheten att vara föremål för manipulation.

I det här fallet genererades en oroande kommunikation genom användning av en artificiell intelligens som härmar röster. Även om rösterna kan tyckas vara identiska vid auditiv perception, har tekniken registrerat en anmärkningsvärt hög sannolikhet på 98 procent att kommunikationen härrör från en artificiell källa.

Även om detta klassificeringssystem inte kan ge absolut säkerhet, kan det ge indikationer som tyder på förekomsten av ett duplicerat röstmönster. Vi rekommenderar starkt att du kontaktar din bekant via en etablerad kommunikationskanal för att validera dessa resultat.

Förebyggande är det bästa försvaret mot AI Voice Cloning Scams

Ibland kan ett effektivt sätt att bekämpa avancerade bedrägliga system innebära att man använder relativt enkla metoder.

Överväg att implementera ett personligt lösenord som endast delas med nära bekanta som familjemedlemmar och vänner.Denna diskreta kod kan fungera som en obestridlig verifiering vid brådskande förfrågningar från betrodda källor.

I slutändan är sekretess för personuppgifter på sociala nätverksplattformar en viktig åtgärd för att skydda sig mot bedräglig verksamhet som kan utnyttja sådan information för att skapa fiktiva konton. Det är tillrådligt att vara försiktig när man delar känsliga uppgifter online genom att följa principen att det som är avsett för en begränsad publik inte bör exponeras för en bredare allmänhet.