Como funcionam os assistentes de voz e porque é que nem sempre são exactos

O ato de comandar vocalmente “Ok Google” à distância para modificar a saída de áudio ou apagar a iluminação dentro de um recinto pode provocar sentimentos de espanto, mas esta operação simples depende de uma intrincada rede de mecanismos tecnológicos que funcionam discretamente em segundo plano.

A questão de como os assistentes de voz reconhecem quando estão a ser contactados é uma questão que se coloca em relação aos assistentes digitais mais importantes atualmente disponíveis. Essencialmente, cada um desses programas contém um comando de ativação específico ou uma palavra-chave, que serve como indicador de que o utilizador pretende interagir com o software. Esta palavra-chave é normalmente uma combinação única de palavras, como “Hey Siri” ou “OK Google”, que a distingue de outro discurso ou linguagem no mesmo ambiente.

Como funciona a deteção de frases?

A frase de ativação ou palavra de despertar serve como iniciador de instruções adicionais quando activada por um utilizador através da tecnologia de reconhecimento de voz. Embora o processo de deteção varie ligeiramente entre os diferentes assistentes virtuais, o princípio fundamental mantém-se consistente. No entanto, pequenas discrepâncias no processo de ativação podem levar à frustração dos utilizadores que se vêem a proferir repetidamente a palavra de despertar sem qualquer resposta do dispositivo, especialmente quando estão a tentar relaxar com a ajuda da sua voz

Crédito da imagem: graphicsstudio/

Vecteezy

Crédito da imagem: graphicsstudio/

Vecteezy

A conceção predominante dos altifalantes “inteligentes” contemporâneos envolve a utilização de um circuito integrado de escala modesta, que é o único responsável pela identificação do comando de despertar, iniciando assim a ativação dos restantes componentes de hardware. A maioria dos processos computacionais é executada remotamente através da nuvem, mas o reconhecimento de fases é efectuado localmente para garantir a preservação da privacidade do utilizador. Este modo de funcionamento é semelhante ao dos smartphones, embora com pequenas diferenças de implementação.

Os pormenores técnicos destes sistemas de deteção permanecem confidenciais, mas sabe-se que utilizam algoritmos de aprendizagem automática e redes neuronais profundas (DNN) para criar modelos de inteligência artificial capazes de reconhecer a impressão vocal de um indivíduo e criar um código de verificação único. Este código serve como ponto de referência para confirmar a pronúncia de uma frase específica, enquanto o resto dos dados é transmitido para a nuvem para análise posterior.

Google Assistant

Os dispositivos móveis estão muitas vezes equipados com uma tecnologia Keyword Spotting (KWS) que lhes permite reconhecer a frase “OK Google” e, subsequentemente, enviar o resto do pedido de pesquisa para a nuvem. No entanto, devido a limitações em termos de capacidade de processamento e duração da bateria, estes sistemas KWS não são geralmente tão eficientes como os encontrados nos altifalantes Google Nest.

Este sistema KWS no dispositivo capta continuamente o áudio dos microfones do dispositivo e inicia uma ligação ao servidor quando detecta uma frase de ativação. A Google também utiliza o Reconhecimento Automático de Fala (ASR) contextual do lado do servidor para melhorar a precisão geral do seu sistema KWS. Pode ler mais sobre este assunto no documento de investigação da Google [PDF].

Siri

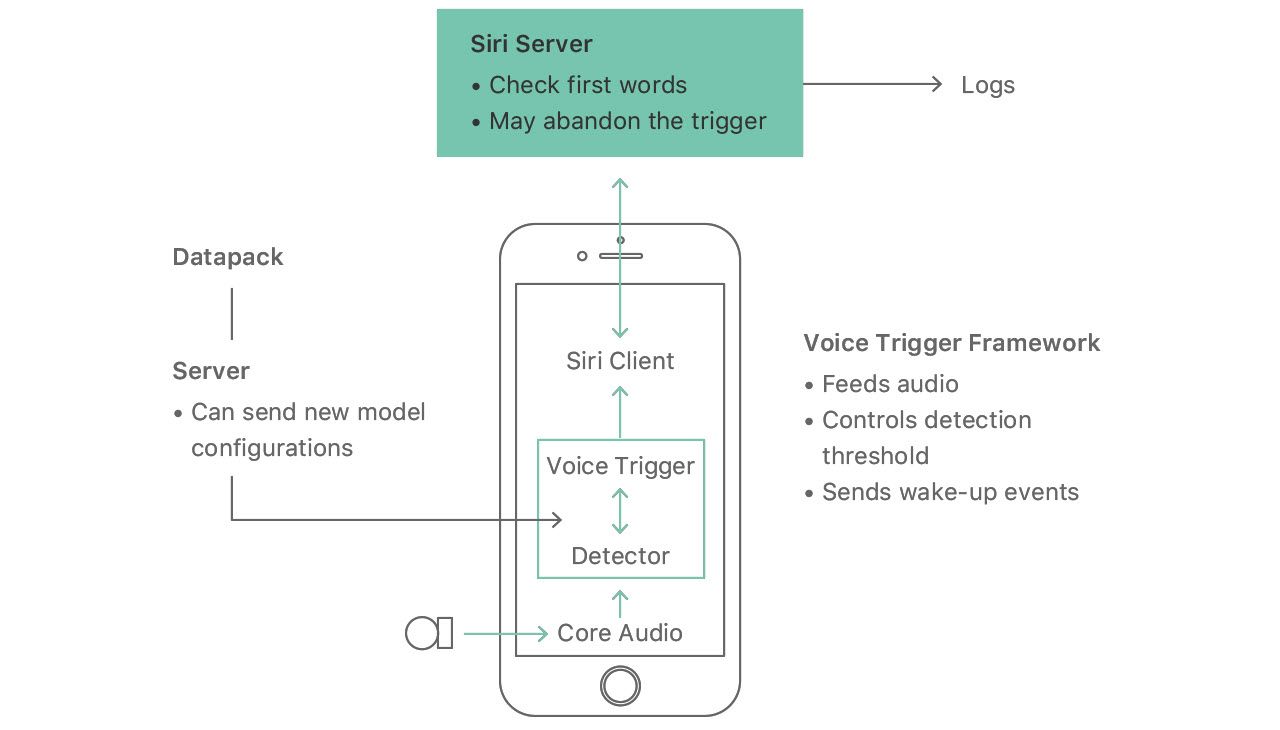

O funcionamento do Siri é semelhante ao do Assistente Google no que diz respeito à deteção de “Hey Siri”. O funcionamento desta tecnologia foi revelado de forma transparente pela Apple, detalhando que utiliza um minúsculo software de reconhecimento de voz que funciona continuamente em segundo plano e ouve apenas a frase de comando específica “Hey Siri”. Este componente utiliza uma rede neural profunda (DNN) para transformar o padrão acústico da voz de um indivíduo, recolhido durante cada ocorrência, numa distribuição de probabilidade de sons de voz, calculando assim um nível de confiança.

A entrada de áudio de um iPhone ou Apple Watch é processada através da conversão da voz do utilizador numa série de amostras de formas de onda a uma frequência de 16.000 vezes por segundo. Estas amostras são subsequentemente reduzidas a uma sequência de fotogramas que captam um intervalo espetral de aproximadamente 0,01 segundos. Eventualmente, um conjunto de 20 quadros consecutivos é fornecido ao modelo de deteção, que utiliza esses padrões para estimar a probabilidade de sons de fala.

Crédito da imagem:

Apple

Crédito da imagem:

Apple

Em circunstâncias em que existe um elevado grau de certeza de que o comando proferido foi “Hey Siri”, determinado pelo sistema, este ativa o Siri e encaminha o resto do inquérito para ser sujeito a um exame adicional na nuvem. Posteriormente, quaisquer acções necessárias serão executadas com base nos resultados deste processo de avaliação.

Existem, naturalmente, medidas adicionais adicionadas para garantir a eficiência da memória e da bateria. O Always On Processor (AOP) do iPhone tem acesso aos microfones do dispositivo (no iPhone 6S e posterior) por esta mesma razão, e uma pequena parte do seu poder de processamento é reservada para executar o DNN. A Apple analisa em pormenor todo o sistema no seu sítio Web de aprendizagem automática, machinelearning.apple .

Alexa

O assistente virtual da Amazon, à semelhança de outros assistentes com IA, como o Assistente do Google e o Siri, utiliza uma tecnologia denominada Reconhecimento Automático da Fala (ASR) para a conversão da fala em texto. Isto permite que o dispositivo compreenda comandos e execute tarefas com base nos pedidos do utilizador.

O Reconhecimento Automático da Fala (ASR) é a base fundamental para o funcionamento da Alexa. Um sistema de bordo é responsável por ouvir palavras de despertar predefinidas, como “Alexa”, “Amazon”, “Echo” ou “Computer”. Quando uma destas palavras-chave é reconhecida, desencadeia a ativação do resto do sistema. Os utilizadores têm a opção de personalizar a sua palavra de ativação, permitindo-lhes utilizar frases como “Hey Disney” para iniciar a funcionalidade da Alexa.

Explique-me como posso melhorar as minhas capacidades de escrita em inglês praticando este exercício regularmente.

Os assistentes de voz estão sempre a ouvir?

É muito provável que a afirmação anterior seja verdadeira. A utilização de palavras de despertar seria impossível se não fosse pela sua capacidade de o fazer. No entanto, não é necessário desfazer-se dos seus altifalantes inteligentes neste momento devido a preocupações com a privacidade.

A possibilidade de escutar cada expressão do utilizador e de a transmitir a um servidor distante para análise ou armazenamento exige recursos computacionais e financeiros substanciais que podem não ser justificáveis na realidade. Além disso, as implicações de privacidade associadas a gigantes da tecnologia como a Google, a Apple e a Amazon tornam o conceito ainda menos plausível.

Foi observado que a implementação de funcionalidades de deteção de palavras de despertar em smartphones como o Google Pixel e o iPhone pode afetar significativamente o seu desempenho e a duração da bateria. A escuta constante de comandos de voz e o envio dos dados de áudio correspondentes para um servidor remoto podem resultar no esgotamento da bateria e na redução da eficiência do dispositivo.

Quem tem a deteção de frases mais eficiente e porquê?

Embora possa ser um desafio avaliar imparcialmente qual

Google Assistant ainda é amplamente utilizado, apesar do aumento da popularidade de grandes modelos de linguagem, como ChatGPT e Bing Chat, devido à sua acessibilidade em vários dispositivos, incluindo telefones Android, smart TVs e sistemas de áudio para automóveis.

qual é o mais avançado entre a siri e o assistente do google? e quanto à sua capacidade de deteção de frases?

A IA é tão assustadora quanto conveniente

A integração de assistentes de inteligência artificial activados por voz tornou-se um aspeto indispensável da vida moderna, mas os processos complexos envolvidos são frequentemente ignorados pelos utilizadores.

A utilização de comandos de voz como meio de comunicação tem-se tornado cada vez mais frequente nos últimos tempos, nomeadamente através da utilização de dispositivos pessoais equipados com capacidades de software avançadas. No entanto, este desenvolvimento deu origem a preocupações relacionadas com a privacidade e a segurança, uma vez que estes dispositivos são capazes de monitorizar e gravar constantemente as interacções dos utilizadores. Este facto levanta questões sobre a possibilidade de utilização indevida ou de acesso não autorizado a informações sensíveis.