O que é um golpe familiar de clone de voz AI? Como identificá-lo

Ligações rápidas

⭐ Como funciona um esquema de clonagem de voz com IA?

⭐ Por que os golpes de clonagem de voz de IA são tão eficazes

⭐ Principais sinais de um golpe de clone de voz de IA

⭐ O que fazer se você suspeitar de um golpe de clone de voz de IA

⭐ A prevenção é a melhor defesa contra golpes de clonagem de voz de IA

Principais conclusões

Utilizando tecnologia avançada de inteligência artificial, as fraudes de clonagem de voz desenvolveram um método para reproduzir fielmente padrões de fala humana com notável autenticidade, explorando vulnerabilidades emocionais e criando um senso de urgência em suas vítimas.

Os burlões são conhecidos por utilizar informações obtidas em várias plataformas de redes sociais para criar situações plausíveis e tirar partido de relações existentes, tornando assim as suas burlas mais convincentes para as potenciais vítimas.

Cuidado com potenciais esquemas de imitação de voz gerados por IA e tenha cuidado ao receber chamadas telefónicas ou mensagens de texto não solicitadas que afirmem ser de uma fonte de confiança. Nos casos em que não tenha a certeza da legitimidade de tais comunicações, é aconselhável terminar a chamada e confirmar independentemente quaisquer supostas situações de emergência antes de tomar outras medidas.

Uma mensagem de voz urgente sua chega aos seus pais a altas horas da noite, provocando uma sensação de angústia ao transmitir uma situação infeliz. Revela que a sua carteira foi desviada, o que o deixou retido num local inconveniente, necessitando de assistência financeira imediata para o seu repatriamento imediato.

A representação áudio da comunicação parece ser extraordinariamente realista e corresponde inequivocamente às características vocais únicas da sua descendência - no entanto, não é genuína. Em vez disso, é uma réplica gerada por inteligência artificial, e eles tornaram-se involuntariamente o objetivo de um esquema fraudulento que ostenta níveis de eficácia inovadores e intensamente desconcertantes.

Como funciona um esquema de clonagem de voz por IA?

A clonagem de voz pode criar réplicas digitais incrivelmente realistas da voz de uma pessoa. Esta técnica, comummente designada por deepfake de áudio , é criada com ferramentas de clonagem de voz de IA como o ElevenLabs (veja o exemplo de clone de voz de IA abaixo). Combinada com IA generativa e síntese de voz, a voz clonada pode replicar emoções, nuances, entoação e até medo.

Como ponto de referência, pode referir-se a forma como Christian Cawley se exprime durante a sua participação no podcast The Really Useful.

Para gerar uma réplica de uma voz com inteligência artificial, é normalmente necessária uma quantidade relativamente minúscula de dados de áudio - muitas vezes não excedendo sessenta segundos de duração. Essas amostras podem frequentemente ser obtidas através da extração de conteúdo online acessível ao público, como vídeos de redes sociais, o que pode tornar certos indivíduos, incluindo bloggers de vídeo e influenciadores, mais susceptíveis devido ao facto de as suas gravações vocais apresentarem uma qualidade de som superior e serem facilmente obtidas.

Depois de obterem uma amostra de voz através de meios ilícitos, os autores de fraudes utilizam tecnologia de conversão de texto em voz ou de conversão de voz em texto em tempo real para gerar chamadas telefónicas e comunicações de voz enganosas.

Empregando uma combinação de tácticas de engenharia social, os burlões são capazes de criar uma narrativa convincente com base em informações recolhidas da presença online da vítima. Podem construir uma história que envolva uma situação de emergência, como hospitalização ou prisão, ou mesmo cenários mais extremos, como roubo ou rapto. Utilizando uma tecnologia avançada de conversão de voz em texto, são capazes de se fazer passar por uma figura de autoridade de confiança e manipular um familiar preocupado para que este forneça informações financeiras sensíveis sob o pretexto de ajudar o seu ente querido supostamente em dificuldades.

A profunda autenticidade dos tons vocais e dos sentimentos, juntamente com a rapidez e a natureza premente do apelo, têm o potencial de ofuscar o ceticismo, resultando em escolhas impulsivas para divulgar recursos financeiros ou revelar dados confidenciais.

Porque é que os esquemas de clonagem de voz por IA são tão eficazes

O esquema de clonagem de voz por IA capitaliza a força das relações pessoais, atacando os indivíduos através das suas ligações emocionais com os outros. Esta técnica tira partido da vulnerabilidade que surge quando um indivíduo recebe uma chamada de socorro supostamente de um ente querido, levando-o a agir impulsivamente devido a uma emoção exacerbada. Na sua essência, esta estratégia reflecte as utilizadas nas burlas “quid pro”; no entanto, o seu impacto é significativamente amplificado em virtude da familiaridade da mensagem vocal, que exacerba ainda mais o sentimento de urgência e confusão do destinatário.

As pessoas cujos entes queridos mantêm uma presença online extensa ou viajam frequentemente podem ser especialmente susceptíveis a estas burlas devido à credibilidade que estas circunstâncias conferem à história fraudulenta. Os burlões normalmente recolhem e exploram informações pessoais recolhidas de antemão nos perfis das redes sociais publicamente acessíveis dos seus alvos, tornando assim a sua fraude ainda mais persuasiva.

Sinais chave de um esquema de clonagem de voz com IA

Apesar da natureza avançada da tecnologia de clonagem de voz baseada em IA, ainda é possível identificar potenciais actividades fraudulentas reconhecendo certos sinais de aviso ou “bandeiras vermelhas”. Estes podem incluir inconsistências na utilização da linguagem, erros de gramática e uma falta geral de coerência na comunicação. Em alguns casos, a utilização de informações pessoais, como nomes, moradas e outros detalhes de identificação, também pode levantar suspeitas. Mantendo-se vigilantes e conscientes destes indicadores comuns de engano, as pessoas podem proteger-se melhor de serem vítimas de burlas de clones de voz com IA.

A urgência implícita na burla pode criar uma sensação de imediatismo e levar os destinatários a agir sem ponderar devidamente a situação, uma vez que são levados a acreditar que haverá consequências terríveis se não cumprirem o pedido fraudulento.

É importante manter-se vigilante contra as burlas, uma vez que os autores podem não ter um conhecimento completo das circunstâncias pessoais ou do historial de um indivíduo ou entidade em particular. Como tal, é essencial estar atento a quaisquer discrepâncias nas informações apresentadas por indivíduos ou organizações que possam indicar intenções fraudulentas.

Os pedidos de transferências internacionais de dinheiro ou os pagamentos efectuados a carteiras digitais obscuras não são invulgares nestas circunstâncias.

Tendo em conta os desafios envolvidos numa situação tão infeliz, pode revelar-se uma tarefa formidável. No entanto, tendo em conta estas considerações, é possível evitar ser vítima de esquemas fraudulentos.

O que fazer se suspeitar de um esquema de clonagem de voz por IA

Quando receber comunicações de pessoas queridas que estão a passar por uma situação difícil, é essencial manter a compostura. Os burlões exploram muitas vezes as emoções exacerbadas, como a ansiedade e o sentimentalismo, para benefício pessoal, aumentando assim a suscetibilidade da pessoa às suas manobras astutas.

Se receber uma chamada telefónica

Se houver a mínima dúvida sobre a legitimidade de uma chamada telefónica, é imperativo terminar a ligação sem hesitação. Evite revelar dados pessoais ou entrar em conversação com os suspeitos de fraude. Para verificar a veracidade de uma suposta situação de emergência, contacte o destinatário pretendido através de um meio de comunicação fiável.

Além disso, é importante notar que continuar a comunicar com estes indivíduos pode resultar na potencial captura da assinatura vocal de alguém, o que pode levar à sua replicação não autorizada ou utilização para fins maliciosos.

Se receber uma mensagem de voz

É altamente recomendável que preserve todas as mensagens de correio de voz recebidas de potenciais burlões, guardando-as no seu dispositivo móvel ou computador. Utilizando tecnologia avançada de inteligência artificial conhecida como ferramentas de classificação de voz, estas gravações podem ser analisadas para discernir se provêm de vozes humanas genuínas ou de vozes sintéticas criadas através da automatização. Esta análise funciona de forma semelhante aos sistemas de deteção de plágio baseados em texto, em que o ficheiro de áudio é introduzido no algoritmo para efeitos de identificação.

A avaliação da autenticidade de amostras vocais pode ser efectuada através de vários métodos, sendo um desses instrumentos eficazes o Classificador de Fala fornecido pela ElevenLabs. Como fornecedor líder de serviços de replicação de inteligência artificial, a ElevenLabs oferece um meio fiável de discernir se uma amostra de voz foi submetida a duplicação digital. Para utilizar esta ferramenta na identificação de uma imitação gerada por IA, siga estes passos:

⭐ Aceder ao ElevenLabs Speech Classifier .

Forneça-me um ficheiro de áudio que contenha uma mensagem de voz e, em seguida, seleccione a opção “Identificar voz artificial” depois de o carregar, clicando no botão “Carregar amostra”.

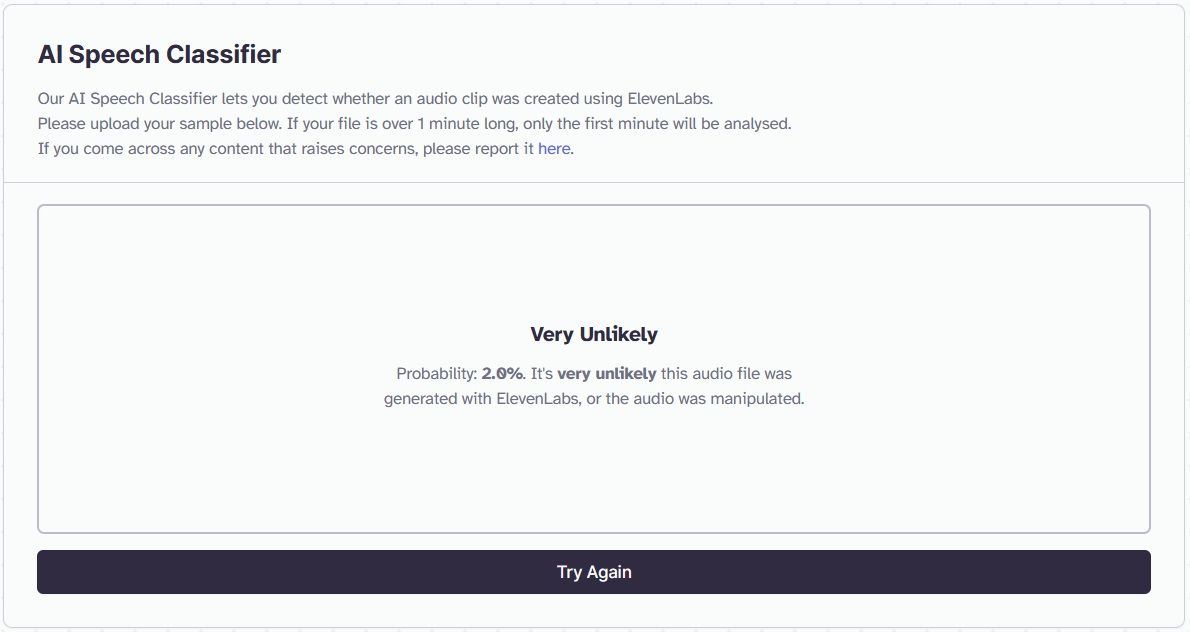

No exemplo fornecido, um indivíduo transmitiu uma comunicação angustiante que foi posteriormente captada e submetida ao sistema de classificação para análise. É evidente que ao conteúdo foi atribuída uma probabilidade modesta de 2%, correspondente à possibilidade de estar sujeito a manipulação.

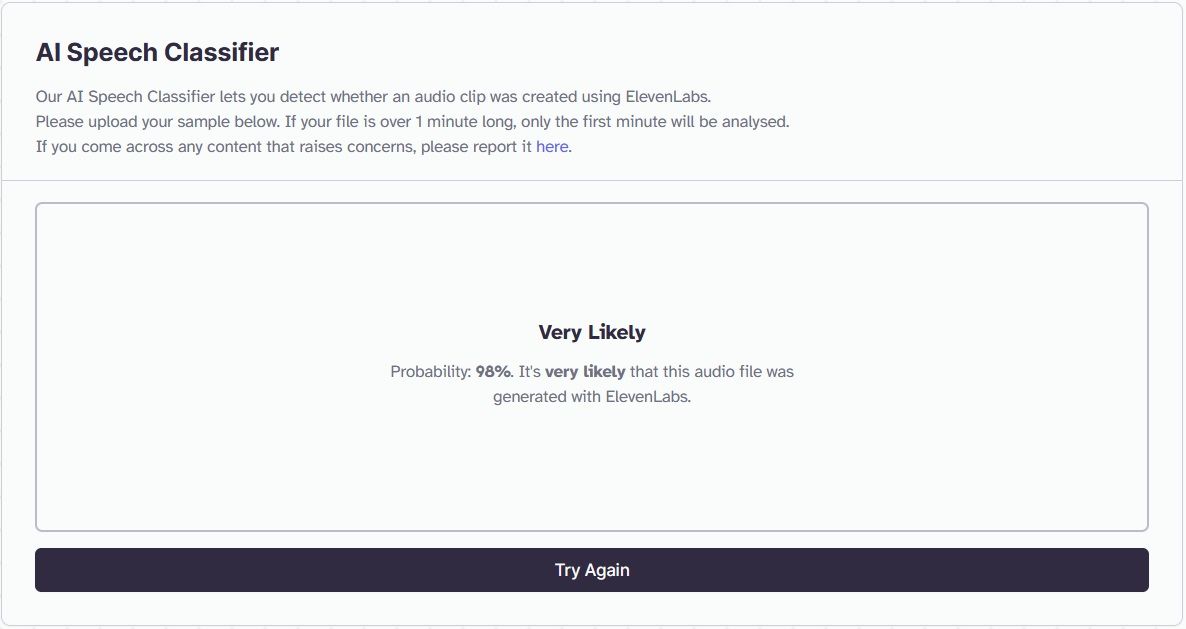

Neste caso, uma comunicação desconcertante foi gerada através da utilização de um dispositivo de imitação de voz de inteligência artificial. Embora as vozes possam parecer idênticas à perceção auditiva, a tecnologia registou uma probabilidade notavelmente elevada de 98% de que a comunicação provém de uma fonte artificial.

Embora este sistema de classificação possa não fornecer certezas absolutas, pode oferecer indicações que sugerem a presença de um padrão vocal duplicado. É altamente recomendável entrar em contacto com o seu conhecido através de um canal de comunicação estabelecido para validar estas descobertas.

A prevenção é a melhor defesa contra esquemas de clonagem de voz por IA

Por vezes, um meio eficaz de combater esquemas fraudulentos avançados pode envolver a utilização de métodos relativamente simples.

Considere a implementação de um código de acesso personalizado partilhado exclusivamente entre pessoas próximas, como familiares e amigos.Este código discreto pode servir de verificação incontestável quando confrontado com pedidos urgentes de fontes fiáveis.

Em última análise, a manutenção da confidencialidade dos dados pessoais nas plataformas de redes sociais constitui uma medida importante de proteção contra actividades fraudulentas que podem explorar essas informações para fabricar contas fictícias. É aconselhável usar de discrição ao partilhar detalhes sensíveis em linha, aderindo ao princípio de que o que se destina a audiências limitadas não deve ser exposto a pontos de vista públicos mais amplos.