5 najlepszych generatorów obrazów AI typu open source

Postępy w dziedzinie sztucznej inteligencji doprowadziły do powstania wielu modeli generowania tekstu na obraz, do których można uzyskać łatwy dostęp. Chociaż uzyskanie pożądanych obrazów za pośrednictwem platform internetowych jest proste, wykorzystanie generatorów tekstu na obraz typu open source zapewnia większą elastyczność w całym procesie tworzenia.

W Internecie można znaleźć kilka swobodnie dostępnych i opartych na sztucznej inteligencji syntezatorów tekstu na obraz, z których każdy koncentruje się na określonej kategorii wizualizacji. W związku z tym, po dokładnym zapoznaniu się z tymi opcjami, stworzyliśmy listę najlepszych generatorów tekstu na obraz opartych na sztucznej inteligencji typu open source, które mogą być obecnie wykorzystywane przez użytkowników.

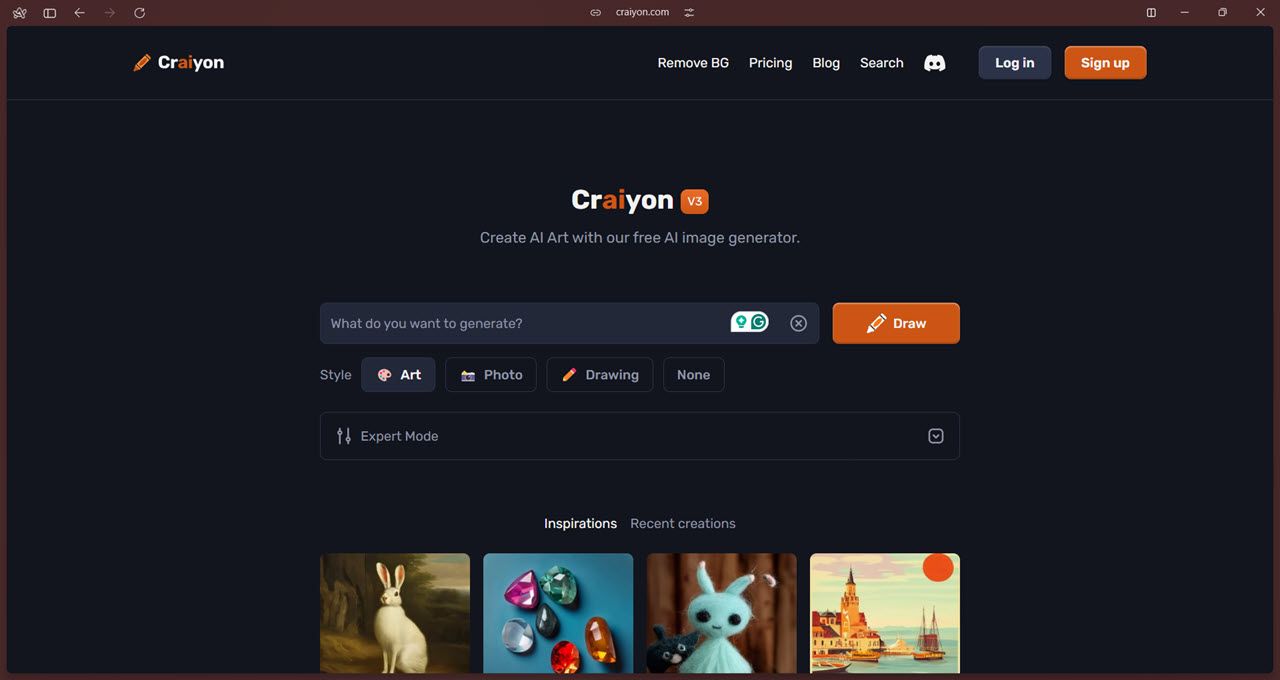

1 Craiyon

Craiyon to jeden z najłatwiej dostępnych generatorów obrazów AI o otwartym kodzie źródłowym. Jest on oparty na DALL-E Mini i choć można sklonować repozytorium Github i zainstalować model lokalnie na komputerze, Craiyon wydaje się porzucić to podejście na rzecz swojej strony internetowej.

Oficjalne repozytorium Github nie było aktualizowane od czerwca 2022 roku, ale najnowszy model jest nadal dostępny za darmo na oficjalnej stronie Craiyon . Nie ma też aplikacji na Androida ani iOS.

Pod względem funkcjonalności ten generator obrazów AI zapewnia standardowe funkcje, których można się spodziewać po wprowadzeniu monitu o wygenerowanie obrazu. Dodatkowo, użytkownicy mają możliwość zwiększenia rozdzielczości generowanych obrazów poprzez wykorzystanie funkcji skalowania w górę. Do wyboru są trzy charakterystyczne style artystyczne w postaci “Art”, “Photo” i “Drawing”. Alternatywnie, wybór opcji “Brak” pozwala samemu modelowi określić styl.

W trybie eksperta włączenie negatywnych słów kluczowych umożliwia modelowi unikanie określonych jednostek. Włączenie przewidywania podpowiedzi ułatwione przez ChatGPT zwiększa biegłość użytkownika w tworzeniu kompleksowych i rozbudowanych podpowiedzi. Co więcej, funkcja usuwania tła oparta na sztucznej inteligencji przyspiesza proces usuwania niechcianych tła z mediów wizualnych poprzez automatyzację.

Craion to narzędzie do generowania obrazów AI o prostej funkcjonalności. Chociaż może brakować zaawansowanych funkcji i skomplikowanych szczegółów, jego prostota sprawia, że jest odpowiedni dla użytkowników, którzy szukają podstawowego, ale funkcjonalnego rozwiązania, nie wymagając wysokiego poziomu realizmu w generowanych obrazach.

Platforma oferuje hojną politykę użytkowania, umożliwiając osobom fizycznym dostęp do jej usług bez ponoszenia żadnych kosztów.Do darmowych użytkowników mają jednak zastosowanie pewne ograniczenia, takie jak ograniczenie liczby obrazów, które mogą być przetwarzane w ciągu sześćdziesięciu sekund. Aby odblokować dodatkowe funkcje, w tym doświadczenie wolne od reklam, przyspieszone czasy przetwarzania i możliwość bezpiecznego przechowywania wyników obrazu, można zdecydować się na uaktualnienie do planów członkostwa Supporter lub Professional. Plany te są dostępne dla płatności miesięcznych z opcjami rozliczeń rocznych i zapewniają różne poziomy dostosowania i wsparcia technicznego w zależności od wybranego pakietu. Co więcej, dostosowane rozwiązanie znane jako plan Custom zapewnia dużą elastyczność, oferując spersonalizowane modele uczenia maszynowego, płynne możliwości integracji, priorytetową obsługę klienta i ekskluzywne zasoby serwerowe.

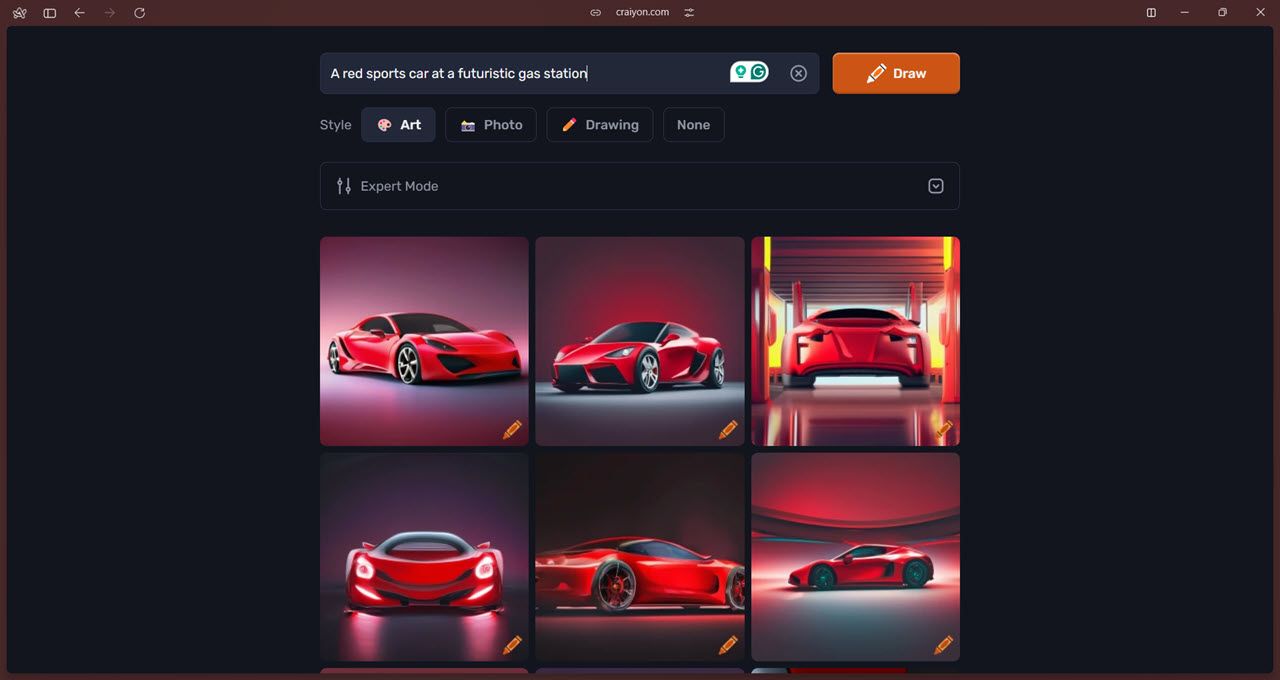

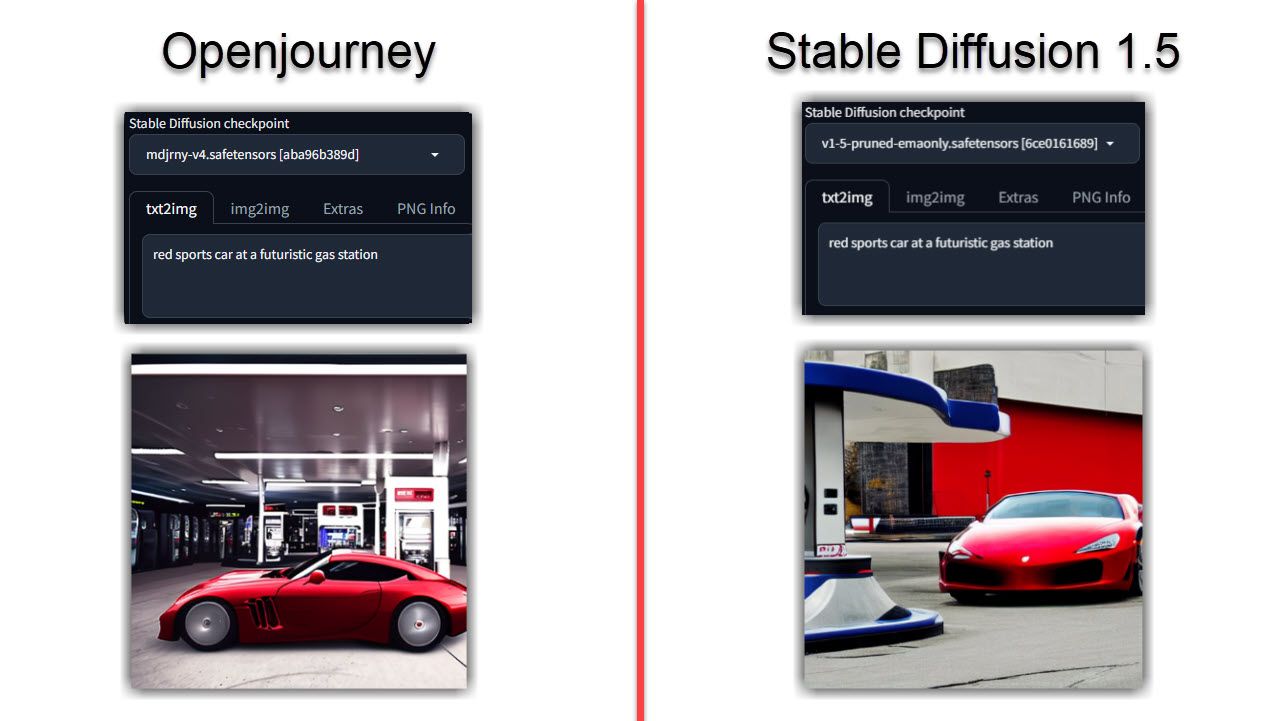

2 Stable Diffusion 1.5

Stable Diffusion to wysoce ceniony model generowania tekstu na obraz o otwartym kodzie źródłowym, który zyskał znaczną popularność od czasu jego wydania w 2022 roku. Oprócz tego, że jest niezależnym modelem, służy jako podstawa dla kilku innych modeli generowania obrazu, takich jak trzy wyżej wymienione przykłady. Od momentu wprowadzenia tego innowacyjnego podejścia do syntezy obrazu, doczekało się ono wielu udanych wdrożeń.

Oszczędzę ci zbyt technicznych szczegółów dotyczących działania tego modelu (które możesz sprawdzić w ich oficjalnym repozytorium Github ), ale model ten jest łatwy do zainstalowania nawet dla zupełnie początkujących i działa dobrze, o ile masz dedykowany procesor graficzny z co najmniej 4 GB pamięci. Możesz również uzyskać dostęp do Stable Diffusion online, a jeśli chcesz uruchomić Stable Diffusion na komputerze Mac, mamy dla Ciebie rozwiązanie.

Istnieje kilka punktów kontrolnych (można je nazwać wersjami) dostępnych dla Stable Diffusion. Podczas gdy testowaliśmy wersję 1.5, wersja 2.1 jest również aktywnie rozwijana i jest bardziej precyzyjna.

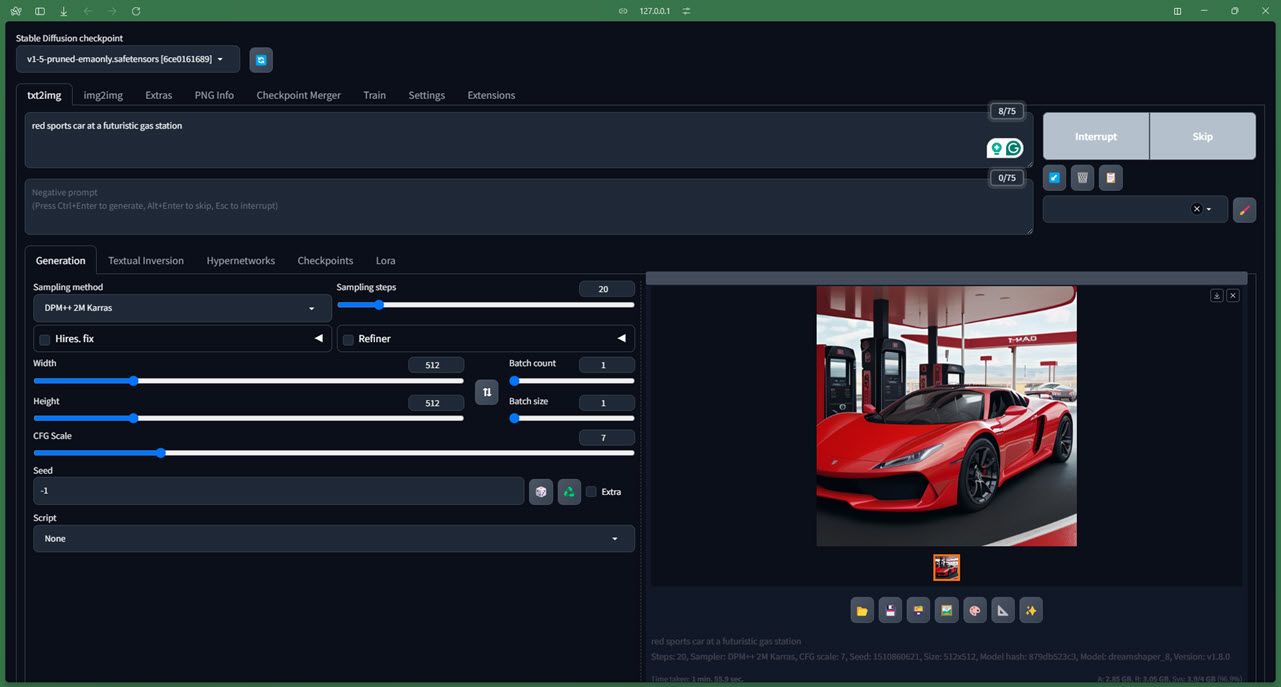

Yadullah Abidi/All Things N/DreamShaper

Yadullah Abidi/All Things N/DreamShaper

Uruchomienie modelu jest również dość proste. Przetestowaliśmy go za pomocą interfejsu użytkownika AUTOMATIC1111 Stable Diffusion , a wszystkie elementy sterujące i parametry działają dobrze. Jest również dość odporny na NSFW dzięki bazie danych LAION-5B, na której model został przeszkolony (choć nie jest doskonały). Choć sam czas generowania będzie się różnić w zależności od posiadanego sprzętu, można oczekiwać, że obrazy będą szczegółowe i realistyczne nawet przy podstawowych podpowiedziach.

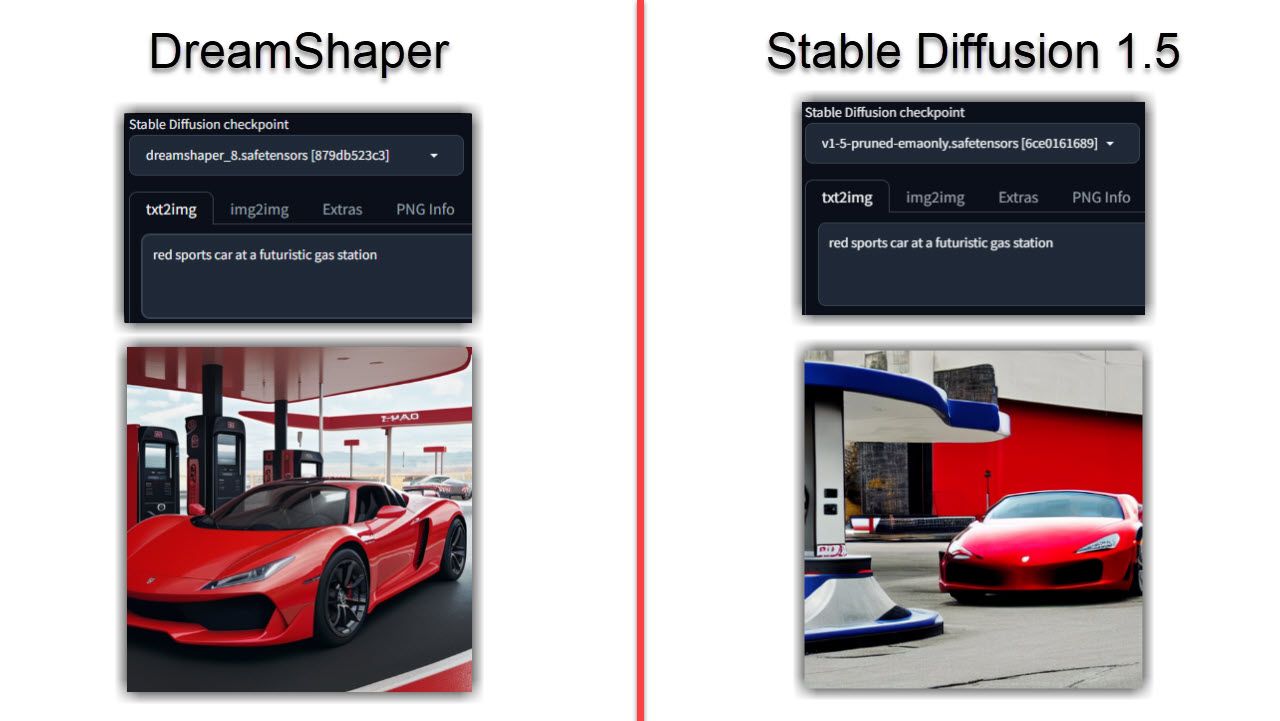

3 DreamShaper

DreamShaper to nowatorski model generowania obrazu, który opiera się na zasadach stabilnej dyfuzji.Zaprojektowane jako wszechstronna i przystępna alternatywa dla MidJourney, to innowacyjne narzędzie może pochwalić się wyjątkową biegłością w tworzeniu wysoce realistycznych fotografii, jednocześnie wykazując niezwykłą zdolność adaptacji w generowaniu anime i artystycznych stylów malarskich poprzez drobne korekty.

Model jest bardziej wydajny niż Stable Diffusion, pozwalając użytkownikom na większą swobodę w zakresie ostatecznego wyniku, od ulepszeń oświetlenia po luźniejsze ograniczenia NSFW. Uruchamianie modelu jest również łatwe, dzięki wstępnie wytrenowanej wersji do pobrania dostępnej online do lokalnego dostępu oraz wielu stronom internetowym, w tym Sinkin.ai , RandomSeed i Mage.space (wymaga podstawowej subskrypcji), które umożliwiają uruchamianie modelu z akceleracją GPU.

W porównaniu do Stable Diffusion, oczywiste jest, że obrazy generowane przez DreamShaper wykazują wyższy stopień realizmu, zawiłości i oświetlenia. Pomimo zastosowania identycznych parametrów wejściowych, DreamShaper konsekwentnie przewyższa swój odpowiednik pod względem wierności wizualnej i ogólnej jakości.

Jedną ze znaczących różnic między Stable Diffusion a innymi modelami generatywnymi jest ich zdolność do tworzenia realistycznych reprezentacji obiektów ludzkich, takich jak portrety lub postacie. Chociaż niezaprzeczalnie imponujące jest to, że modele te mogą tworzyć bardzo szczegółowe i dokładne obrazy, mogą one nadal pozostawać w tyle w porównaniu z tradycyjnymi formami sztuki, które opierają się na bardziej subiektywnych interpretacjach i kreatywności. W rzeczywistości można argumentować, że istotą tego, co czyni dzieło sztuki wyjątkowym i wartościowym, są właśnie jego niedoskonałości i indywidualność. Dlatego też, chociaż obrazy generowane przez sztuczną inteligencję mogą być technicznie sprawne, to ostatecznie może im brakować emocjonalnej głębi i osobistego charakteru, który odróżnia naprawdę wielkie dzieła sztuki od zwykłych imitacji.

Do uruchomienia tego konkretnego modelu niekoniecznie potrzebny jest rozbudowany system obliczeniowy. W rzeczywistości moja karta graficzna NVIDIA GeForce GTX 1650Ti z 4 GB pamięci wideo poradziła sobie z wykonaniem tego modelu znakomicie. Chociaż proces generowania trwał nieco dłużej, nie wydaje się, aby miało to zauważalny wpływ na wynikowe wyniki. Należy jednak zauważyć, że większa ilość pamięci wideo może być niezbędna do skutecznego zarządzania wymagającymi wymaganiami DreamShaper XL, który jest zbudowany na fundamencie modelu Stable Diffusion XL.

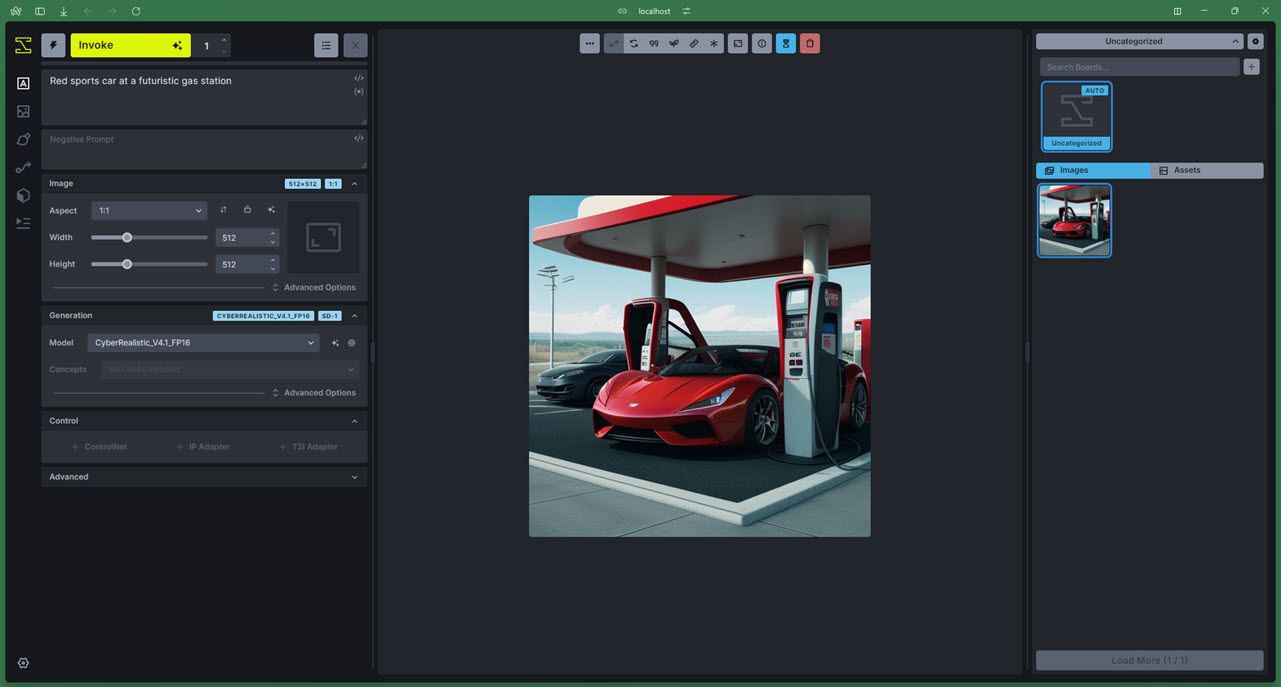

4 InvokeAI

Invoke AI to zaawansowany model generowania obrazu, który wykorzystuje zaawansowany algorytm Stable Diffusion do tworzenia atrakcyjnych wizualnie obrazów.Model ten oferuje dwie wersje - standardową i XL - z których obie zostały zaprojektowane z myślą o wydajnym dostarczaniu wysokiej jakości wyników. Ponadto Invoke AI posiada przyjazny dla użytkownika interfejs sieciowy i wiersza poleceń, eliminując potrzebę poruszania się po złożonych interfejsach, takich jak te znalezione w innych modelach AI.

Centralnym elementem naszej oferty jest umożliwienie użytkownikom generowania atrakcyjnych wizualnie treści pochodzących z ich własnej wiedzy, dostosowując proces do indywidualnych preferencji. W tym względzie wykorzystujemy potężne możliwości InvokeAI, najwyższej klasy modelu sztucznej inteligencji o otwartym kodzie źródłowym, zaprojektowanego specjalnie do tworzenia obrazów na zamówienie poprzez jego płynną integrację z własnymi zasobami.

Jego oficjalne repozytorium Github wymienia dwie metody instalacji: instalację za pomocą instalatora InvokeAI lub użycie PyPI, jeśli czujesz się komfortowo z terminalem i Pythonem i potrzebujesz większej kontroli nad pakietami zainstalowanymi z modelem.

Aby wykorzystać dodatkowe funkcje zapewniane przez InvokeAI, muszą być spełnione pewne wymagania wstępne w zakresie specyfikacji systemu. W szczególności wymagany jest dedykowany procesor graficzny z minimum 4 GB pamięci, przy czym w przypadku większego wariantu sugerowane jest 6-8 GB. Zarówno karty graficzne AMD, jak i Nvidia podlegają tym samym ograniczeniom pamięci VRAM. Co więcej, co najmniej 12 GB pamięci RAM i 12 GB dostępnego miejsca na dysku twardym będzie konieczne, aby pomieścić model sieci neuronowej, a także wszelkie powiązane zależności i pliki instalacyjne Python.

Yadullah Abidi/All Things N/InvokeAI

Yadullah Abidi/All Things N/InvokeAI

Chociaż nie jest to zalecane w dokumentacji ze względu na niewystarczającą ilość pamięci wideo, przetestowany przez nas proces instalacji z procesorami graficznymi Nvidia z serii GTX 10 i 16 zakończył się powodzeniem. Należy jednak pamiętać, że wydajność może się różnić w zależności od indywidualnych specyfikacji systemu. Ponadto chcielibyśmy poinformować użytkowników korzystających z układów GPU niższej klasy, że mogą oni doświadczyć nieco dłuższego czasu oczekiwania przed wyświetleniem efektów wizualnych. Wreszcie, w przypadku osób korzystających z systemów operacyjnych Windows należy pamiętać, że obecnie obsługiwane są tylko procesory graficzne Nvidia, podczas gdy procesory graficzne AMD pozostają nieobsługiwane.

Obecna implementacja platformy InvokeAI skłania się raczej ku tworzeniu artystycznych niż fotorealistycznych obrazów. Można to jednak zmienić, trenując model przy użyciu niestandardowego zestawu danych. Takie podejście zapewni lepsze wyniki podczas generowania realistycznych obrazów, szczególnie w takich dziedzinach jak projektowanie produktów, architektura i środowiska detaliczne.Należy zauważyć, że podczas gdy InvokeAI służy jako skuteczny silnik generowania obrazu, osiągnięcie optymalnych wyników może wymagać wykorzystania zewnętrznych modeli dostępnych za pośrednictwem wbudowanego Menedżera modeli w interfejsie użytkownika.

5 Openjourney

Openjourney to model generowania obrazów AI, który wykorzystuje technologię Stable Diffusion i działa jako platforma open-source. Nazwa “Openjourney” odzwierciedla fakt, że model został przeszkolony przy użyciu obrazów Midjourney, aby odtworzyć jego charakterystyczny styl wizualny w generowanych obrazach.

PromptHero , firma stojąca za Openjourney, pozwala przetestować model wraz z innymi modelami, w tym Stable Diffusion (wersje 1.5 i 2), DreamShaper i Realistic Vision. Rejestrując się, otrzymujesz 25 darmowych kredytów (jeden kredyt za każdy wygenerowany obraz), po czym musisz zasubskrybować poziom subskrypcji Pro, który kosztuje 9 USD miesięcznie i daje dostęp do 300 kredytów każdego miesiąca oraz innych ekskluzywnych funkcji.

Jeśli jednak chcesz uruchomić go lokalnie i za darmo, możesz pobrać plik modelu z HuggingFace i uruchomić go za pomocą interfejsu internetowego Stable Diffusion. Openjourney jest również drugim najczęściej pobieranym modelem generowania obrazów AI na HuggingFace, zaraz za Stable Diffusion.

Na stronie internetowej Openjourney nie podano wyraźnie, jakie wymagania sprzętowe są niezbędne do pobrania i wdrożenia modelu AI w trybie offline. Jest jednak prawdopodobne, że wymagania te będą porównywalne do tych wymaganych przez Stable Diffusion. Aby pomyślnie uruchomić model, należy mieć dostęp do dedykowanego procesora graficznego (GPU) wyposażonego w co najmniej 4 gigabajty pamięci wideo (VRAM), 16 GB pamięci RAM i około 12 do 15 gigabajtów dostępnej pojemności pamięci na urządzeniu, aby pomieścić model i powiązane z nim komponenty.

Yadullah Abidi/All Things N/OpenJourney

Yadullah Abidi/All Things N/OpenJourney

Openjourney generuje obrazy, które zachowują równowagę między realizmem a artyzmem, z wyjątkiem wszelkich konkretnych żądań. Dla tych, którzy szukają wszechstronnego modelu ucieleśniającego cechy zarówno fotorealizmu, jak i sztuki, unikając jednocześnie płacenia za subskrypcję, Openjourney prezentuje się jako bardzo odpowiednia opcja.