Google PaLM 2 vs. OpenAI GPT-4: Jaka jest różnica?

Google zaprezentowało kolejną generację swojego Pathways Language Model (PaLM 2) 10 maja 2023 r. na Google I/O Jego nowy duży model językowy (LLM) może pochwalić się wieloma ulepszeniami w stosunku do swojego poprzednika (PaLM) i może wreszcie być gotowy do zmierzenia się ze swoim największym rywalem, GPT-4 OpenAI.

Rzeczywiście, zakres, w jakim Google poczyniło postępy, pozostaje kwestią kontemplacji. Czy PaLM 2 rzeczywiście może okazać się kluczowym czynnikiem, który Google sobie wyobraża? Co więcej, biorąc pod uwagę mnogość porównywalnych kompetencji dostępnych na rynku, co odróżnia PaLM 2 od GPT-4 OpenAI?

PaLM 2 vs. GPT-4: Przegląd wydajności

PaLM 2 może pochwalić się wieloma innowacyjnymi funkcjami, które odróżniają go od swojego poprzednika, w tym wszechstronnością oferowaną w mniejszych formatach dostosowanych do konkretnych zadań wymagających mniej zasobów obliczeniowych niż GPT-4.

Każdy z wyżej wymienionych wymiarów ma swoje odpowiedniki znane jako Gecko, Otter, Bison i Unicorn, gdzie Gecko reprezentuje najbardziej filigranową iterację, po której następują Otter, Bison i ostatecznie Unicorn, największy z nich wszystkich.

Google twierdzi, że poprawił swoje umiejętności rozumowania w porównaniu do GPT-4 zarówno w WinoGrande, jak i DROP, osiągając marginalne zwycięstwo w ARC-C. Ponadto zaobserwowano znaczne postępy we wszystkich obszarach związanych z PaLM i SOTA.

PaLM 2 jest również lepszy w matematyce, zgodnie z 91-stronicowym dokumentem badawczym Google PaLM 2 [PDF]. Jednak sposób, w jaki Google i OpenAI ustrukturyzowały swoje wyniki testów, utrudnia bezpośrednie porównanie obu modeli. Google pominęło również niektóre porównania, prawdopodobnie dlatego, że PaLM 2 nie wypadł tak dobrze jak GPT-4.

MMLU, HellaSwag i ARC-E. Wyniki pokazały, że GPT-4 osiągnął lepsze wyniki niż PaLM 2 we wszystkich przypadkach z wyjątkiem jednego, w którym osiągnęły równe wyniki. W szczególności w MMLU GPT-4 uzyskał wynik 86,4%, podczas gdy PaLM 2 osiągnął 81%. Podobnie, biorąc pod uwagę model HellaSwag, GPT-4 zarejestrował imponujący wynik 95,3%, podczas gdy wydajność PaLM 2 była nieco niższa i wyniosła 86,8%. Wreszcie, w modelu ARC-E, oba modele osiągnęły

Największym modelem w rodzinie PaLM 2 jest PaLM 2-L. Chociaż nie znamy jego dokładnego rozmiaru, wiemy, że jest znacznie mniejszy niż największy model PaLM, ale wykorzystuje więcej obliczeń treningowych. Według Google , PaLM ma 540 miliardów parametrów, więc “znacznie mniejszy” powinien umieścić PaLM 2 w dowolnym miejscu od 10 miliardów do 300 miliardów parametrów.Należy pamiętać, że liczby te są jedynie założeniami opartymi na tym, co Google powiedział w dokumencie PaLM 2.

W świetle faktu, że jeśli wspomniana liczba mieści się w okolicach 100 miliardów lub mniej, jest wysoce prawdopodobne, że PaLM 2 będzie wykazywał mniej parametrów w porównaniu do GPT-3. Warto zauważyć, że potencjalny model z ograniczeniami skali może konkurować z GPT-4 i przewyższać go w niektórych zadaniach. I odwrotnie, GPT-3.5 był początkowo bezkonkurencyjny pod względem wydajności, nawet przewyższając PaLM, ale PaLM 2 wykazał godny podziwu powrót.

PaLM 2 oferuje znaczącą przewagę nad GPT-4 pod względem wszechstronności pod względem dostępnych rozmiarów. Pozwala to na wykorzystanie różnych wersji modelu, takich jak Gecko, na urządzeniach mobilnych, nawet gdy nie ma połączenia z Internetem, zapewniając w ten sposób wbudowane możliwości sztucznej inteligencji, które nie były jeszcze widoczne w GPT-4. Możliwość przetwarzania na urządzeniu dodatkowo zwiększa dostępność i praktyczność PaLM 2 w porównaniu do GPT-4.

Różnice w danych treningowych GPT-4 i PaLM 2

Firma Google nie ujawniła wielkości zbioru danych treningowych wykorzystanych w PaLM 2, ale z ich artykułu badawczego wynika, że ten nowy duży model językowy został przeszkolony na znacznie obszerniejszym zbiorze danych niż jego poprzednik. Podobnie, Open

Aby osiągnąć głębsze zrozumienie pojęć matematycznych, logicznych i naukowych, Google położył nacisk na te obszary w zestawie danych szkoleniowych dla PaLM 2. Jak stwierdzono w ich artykule badawczym, korpus wstępnego szkolenia PaLM 2 obejmuje różne źródła, takie jak strony internetowe, literatura, język programowania, teksty matematyczne i transkrypcje rozmów, co skutkuje ulepszeniami w stosunku do oryginalnego modelu pod wieloma względami.

Biorąc pod uwagę rozległą biegłość językową obejmującą ponad 100 ram językowych, oczekuje się, że PaLM 2 wykaże wyjątkowe zdolności konwersacyjne, dzięki ulepszonemu zrozumieniu kontekstowemu i płynnym tłumaczeniom. Zmniejszone wykorzystanie danych podczas szkolenia rzekomo skutkuje zmniejszonym generowaniem szkodliwych treści poprzez omijanie witryn zawierających nienawistny dyskurs lub szkodliwe zachowanie. W szczególności, znaczące repozytoria tekstowe, takie jak Reddit, są wykluczone z procesu uczenia się, co skutkuje wynikiem charakteryzującym się podwyższonym stopniem przyzwoitości i grzeczności.

Jeśli chodzi o dane treningowe GPT-4, OpenAI poinformowało nas, że wytrenowało model przy użyciu publicznie dostępnych danych i danych, które licencjonowało. Strona badawcza GPT-4 stwierdza: “Dane są korpusem danych w skali internetowej, w tym poprawnymi i niepoprawnymi rozwiązaniami problemów matematycznych, słabym i silnym rozumowaniem, wewnętrznie sprzecznymi i spójnymi stwierdzeniami oraz reprezentującymi wiele różnych ideologii i pomysłów”.

Dzięki wykorzystaniu uczenia ze wzmocnieniem i uwzględnieniu wkładu człowieka, OpenAI udoskonaliła wydajność GPT-4, aby zapewnić, że generowane przez nią odpowiedzi są ściślej powiązane z zamierzonym celem danego zapytania. Proces ten pomaga odfiltrować wszelkie obce lub nieistotne dane wyjściowe generowane przez system, ostatecznie zapewniając użytkownikom dokładniejsze i bardziej satysfakcjonujące odpowiedzi na ich zapytania.

Należy zauważyć, że konkretne dane szkoleniowe wykorzystywane przez każdy model pozostają nieznane; można jednak wywnioskować, że zamierzony cel ich odpowiednich szkoleń znacznie się różnił. Ostateczny wynik takich rozbieżności stanie się widoczny dopiero po wdrożeniu obu modeli w rzeczywistych warunkach operacyjnych.

Biorąc pod uwagę znaczną ilość danych treningowych wykorzystywanych przez GPT-4, jest on dobrze przygotowany do skuteczniejszego uchwycenia subtelności języka niż jego poprzednicy, generując w ten sposób wyższą jakość wyników. Niemniej jednak tak szerokie wykorzystanie wymaga nałożenia na model rygorystycznych ograniczeń, aby zapobiec wszelkim niepożądanym zachowaniom, co nie ma zastosowania w przypadku Google, biorąc pod uwagę ich decyzję o wykluczeniu szkodliwych treści z procesu szkolenia.

Chatboty i usługi PaLM 2 i GPT-4

Korzystając z odpowiednich chatbotów każdego modelu językowego, użytkownicy mogą uzyskać dostęp do obu za pośrednictwem dwóch oddzielnych portali. Jednak dostęp do GPT-4 jest ograniczony do subskrybentów usługi premium, ChatGPT Plus, podczas gdy ci, którzy nie chcą płacić, mogą nadal wchodzić w interakcje z GPT-3. Z drugiej strony, PaLM 2 Bard jest bezpłatny i dostępny na całym świecie w ponad 180 krajach.

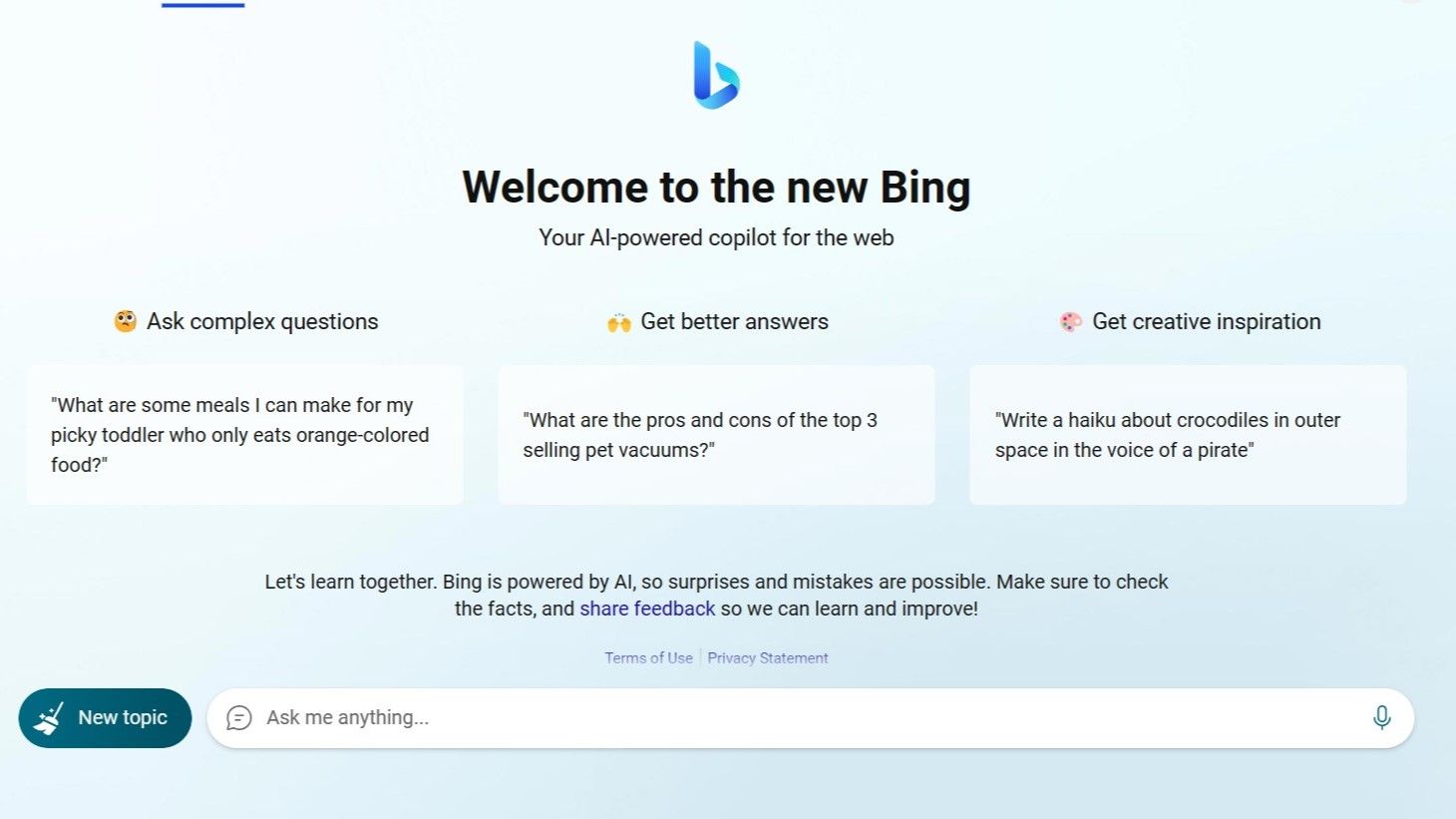

Chociaż może być prawdą, że dostęp do GPT-4 jest bezpłatny, należy pamiętać, że Bing AI Chat firmy Microsoft wykorzystuje tę technologię i jest swobodnie dostępny dla wszystkich. W rzeczywistości jest on dogodnie zlokalizowany obok wyszukiwarki Bing, która jest znaczącym konkurentem Google w tej samej domenie.

Podczas ostatniej iteracji Google I/O w 2023 roku ujawniono, że znaczące postępy zarówno w PaLM 2, jak i we włączeniu generatywnej sztucznej inteligencji mają znacznie poprawić ogólne wrażenia użytkownika w ekosystemie Google Workspace. Ta innowacyjna integracja obejmuje wiele usług świadczonych przez technologicznego behemota, takich jak Dokumenty Google, Arkusze, Prezentacje, Gmail i inne.Co więcej, warto zauważyć, że Google zweryfikował, że PaLM 2 został obecnie płynnie zasymilowany z ponad dwudziestoma pięcioma różnymi aplikacjami w całym portfolio produktów, obejmującym popularny mobilny system operacyjny Android i platformę udostępniania wideo YouTube.

Microsoft włączył możliwości sztucznej inteligencji do swojego pakietu aplikacji Microsoft Office, a także licznych usług. Obecnie użytkownicy mają okazję być świadkami rywalizacji pomiędzy technologiami AI oferowanymi przez dwie konkurujące ze sobą firmy walczące o dominację w tej dziedzinie.

W wyniku wczesnego wydania i starannych wysiłków mających na celu uniknięcie błędów popełnionych przez jego poprzednika, GPT-4 stał się dominującym Large Language Model (LLM) wśród zewnętrznych programistów, startupów i tych, którzy chcą zintegrować zaawansowane rozwiązanie AI ze swoimi usługami. Aby zilustrować ten punkt, skompilowałem kolekcję aplikacji wykorzystujących GPT-4, które można przejrzeć w dogodnym dla siebie czasie.

Należy zauważyć, że podczas gdy programiści mogą eksperymentować z PaLM 2 lub go adoptować, Google będzie musiało ciężko pracować, aby konkurować z OpenAI w tym zakresie. Jedną z przewag PaLM 2 nad GPT-4 jest jego dostępność jako platformy open-source, co może prowadzić do szerszego zastosowania w porównaniu z zastrzeżonym płatnym API.

Biorąc wszystko pod uwagę, w tej chwili Bard zasilany przez PaLM 2 wydaje się być lepszym wyborem, jeśli chodzi o badania, ponieważ lepiej odpowiada na pytania z odpowiednimi informacjami i uzyskuje dostęp do najnowszych informacji w Internecie na dowolny temat. Zgodnie z najnowszą aktualizacją Bard , dostarczoną 19 września 2023 r., Bard używa obecnie swojego “najbardziej wydajnego modelu” z obsługą kolejnych 40 języków, dogłębną pomocą w kodowaniu, możliwością przedstawiania różnych perspektyw na dany temat oraz ogólną poprawą jakości i dokładności.

Chociaż możliwe jest porównywanie odpowiedzi Bard za pomocą zewnętrznych wyszukiwarek, takich jak Google, system nadal pozostaje w tyle za konkurencją pod względem szybkiego generowania odpowiedzi w porównaniu do ChatGPT opartego na GPT-4 lub Bing Chat Microsoftu.

Czy PaLM 2 może zmierzyć się z GPT-4?

PaLM 2, będąc stosunkowo nowym rozwiązaniem, musi jeszcze wykazać swoją zdolność do konkurowania z GPT-4. Niemniej jednak, w oparciu o ambitne plany Google i silne wysiłki promocyjne, istnieją przesłanki, że PaLM 2 może stanowić znaczące wyzwanie dla GPT-4. Ponadto Google aktywnie rozwija multimodalny model sztucznej inteligencji o nazwie Gemini, co dodatkowo wywiera presję na OpenAI, aby przyspieszyło swoją grę.

Podczas gdy GPT-4 pozostaje potężny, PaLM 2 może pochwalić się znaczną przewagą dzięki wykorzystaniu wielu mniejszych modeli. W szczególności komponent Gecko w PaLM 2 działa z niezwykłą wydajnością, umożliwiając działanie na urządzeniach mobilnych nawet w trybie offline. Ta wszechstronność umożliwia PaLM 2 obsługę szerszej gamy urządzeń i aplikacji, które mogą napotkać wyzwania w dostępie do GPT-4.

Wyścig sztucznej inteligencji nabiera tempa

Zaprezentowanie PaLM2 zaostrzyło konkurencję wśród twórców sztucznej inteligencji, a niektórzy uważają go za potężnego rywala, który może rzucić wyzwanie GPT. Ponadto Google podobno przygotowuje kolejny multimodalny model sztucznej inteligencji o nazwie Gemini, co dodatkowo demonstruje jego zaangażowanie w rozwój tej dziedziny.