Sztuczna inteligencja nadchodzi po dane z mediów społecznościowych: Czy można coś z tym zrobić?

Kluczowe wnioski

Podczas gdy rośnie zaniepokojenie prywatnością informacji o użytkownikach na platformach mediów społecznościowych, doniesiono, że niektóre z tych platform sprzedały dostęp do danych użytkowników firmom zajmującym się sztuczną inteligencją (AI) w celu szkolenia ich generatywnych modeli AI. Rodzi to pytania dotyczące etycznych implikacji i potencjalnych konsekwencji takich działań.

Wyżej wymienione platformy, takie jak Meta, Reddit, Tumblr i WordPress.com, są znane z uczestnictwa w umowach obejmujących licencjonowanie danych do celów szkoleniowych sztucznej inteligencji.

Użytkownicy mogą podjąć kilka skromnych działań w celu ochrony swoich informacji, modyfikując preferencje prywatności, odmawiając udostępniania i zachowując ostrożność podczas publikowania treści w Internecie.

W ostatnim czasie korporacje zajmujące się mediami społecznościowymi badają nowe metody wykorzystywania informacji o użytkownikach poprzez zawieranie umów z firmami zajmującymi się sztuczną inteligencją. Pojawia się jednak pytanie, jakie środki mogą podjąć zwykłe osoby, aby chronić swoje dane osobowe i cyfrowe dzieła przed wykorzystaniem w takich transakcjach.

Platformy mediów społecznościowych zawierają umowy z firmami zajmującymi się sztuczną inteligencją

Wykorzystanie informacji z mediów społecznościowych do szkolenia modeli sztucznej inteligencji wywołało znaczną debatę, ale wydaje się, że korporacje mediów społecznościowych nie chcą rezygnować z danych użytkowników.

Meta zintegrowała dane z mediów społecznościowych ze swoimi funkcjami generatywnej sztucznej inteligencji, które zostały wprowadzone podczas wydarzenia Meta Connect. Funkcje te obejmują Meta AI i możliwości, takie jak generowanie emoji opartych na sztucznej inteligencji dla platform takich jak WhatsApp.

Jak stwierdził Mike Clark, dyrektor ds. zarządzania produktami w Meta, w poście Meta Newsroom :

Modele sztucznej inteligencji wykorzystane w funkcjach zaprezentowanych podczas naszego ostatniego wydarzenia, znanego jako Connect, zostały przeszkolone przy użyciu publicznie dostępnych treści z Instagrama i Facebooka, w tym zdjęć i towarzyszących im podpisów.

Trend ten nie wydaje się zwalniać w Według Reuters , Reddit zawarł umowę z Google, aby udostępnić zawartość platformy mediów społecznościowych do szkolenia modeli sztucznej inteligencji.

Zgłoszenie S-1 Reddit dotyczące IPO, złożone 22 lutego 2024 r., potwierdza, że firma bada umowy licencyjne. Zgłoszenie stwierdza:

Wykorzystanie danych Reddit okazało się niezbędne dla rozwoju współczesnych technologii sztucznej inteligencji, w tym dużych modeli językowych (LLM).W związku z tym przewidujemy, że obszerne repozytorium informacji i wiedzy konwersacyjnej Reddit pozostanie instrumentalne w udoskonalaniu i zwiększaniu możliwości tych zaawansowanych systemów lingwistycznych.

Reddit zainicjował program, który umożliwia podmiotom zewnętrznym uzyskanie pozwolenia na dostęp, analizę i prezentację zarówno przeszłych, jak i bieżących danych z jego platformy, w celu wykorzystania tych informacji do ulepszenia dużych modeli językowych (LLM).

I chociaż Meta i Reddit to jedne z największych nazwisk w mediach społecznościowych, nie są to jedyne platformy zaangażowane w wykorzystywanie danych z mediów społecznościowych do trenowania sztucznej inteligencji. Według raportu 404 Media , Tumblr i WordPress.com przygotowują się do sprzedaży danych użytkowników Midjourney i OpenAI.

Czy można powstrzymać platformy przed sprzedażą danych z mediów społecznościowych w celu szkolenia sztucznej inteligencji?

Korzystanie z platform takich jak Facebook, Instagram, Reddit, Tumblr i WordPress.com może skutkować włączeniem publicznie dostępnych treści w proces tworzenia modeli językowych (LLM).

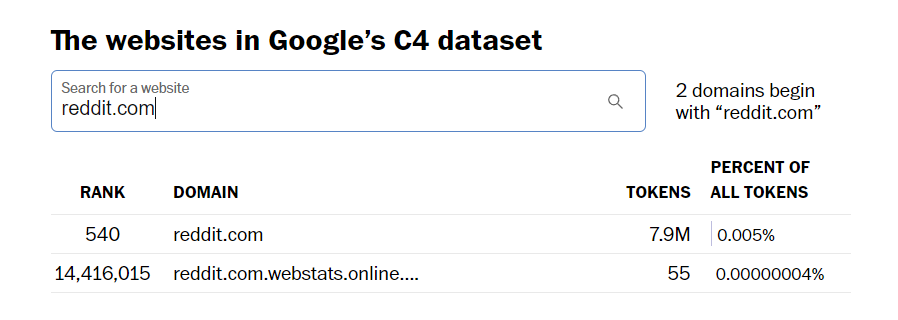

Na przykład, jeśli użyjesz narzędzia wyszukiwania Washington Post , aby zobaczyć, jakie witryny zostały uwzględnione w zbiorze danych Google C4, który został wykorzystany jako część szkolenia Barda, zobaczysz, że Reddit.com stanowi 7,9 miliona tokenów.

Zbiór danych obejmuje znaczny zakres źródeł treści, w tym Tumblr.com ze znaczną reprezentacją około 1,6 miliona tokenów, a także mniejsze witryny, takie jak moja własna wykorzystująca WordPress.com, które wnoszą minimalny wkład z zaledwie około 14 000 tokenów. Warto zauważyć, że nawet te skromne osobiste blogi są objęte zakresem zbioru danych.

Pojawiające się umowy między firmami zajmującymi się sztuczną inteligencją a podmiotami sieci społecznościowych wiążą się z aktywnym marketingiem takich danych, w przeciwieństwie do biernego pozyskiwania ich ze źródeł internetowych.

Ale jeśli chodzi o przyszłe przetwarzanie, co można z tym zrobić? Meta wprowadziła formularz dotyczący praw podmiotu danych generatywnej sztucznej inteligencji , który pozwala sprzeciwić się lub ograniczyć przetwarzanie danych osobowych od stron trzecich w celu szkolenia modeli generatywnej sztucznej inteligencji Meta.

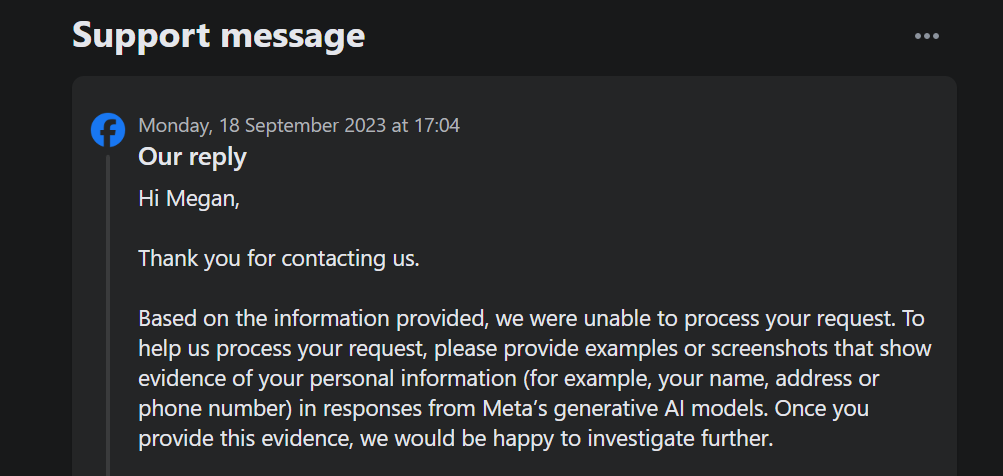

Warto zauważyć, że ta opcja nie pozwala na wniesienie sprzeciwu wobec przetwarzania danych użytkownika przez Meta w celu szkolenia systemów sztucznej inteligencji. Dodatkowo, podczas próby złożenia sprzeciwu za pośrednictwem dostarczonego formularza, okazało się, że dowód wykorzystania danych osobowych w wynikach sztucznej inteligencji Meta był wymagany w ramach procesu zgłoszenia do pomocy technicznej.

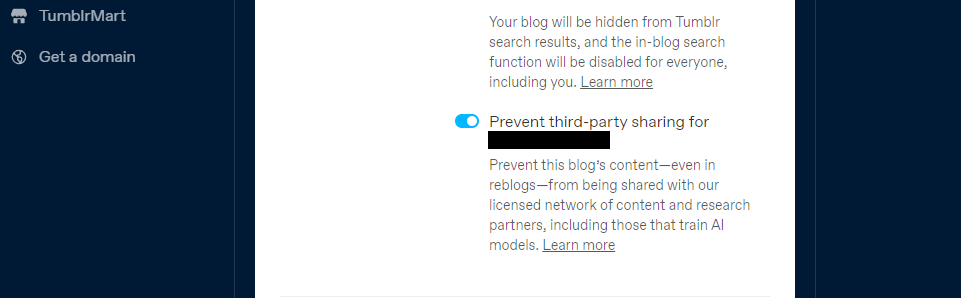

Tumblr oferuje rozwiązanie, które umożliwia użytkownikom odrzucenie rozpowszechniania ich publicznych postów na blogu podmiotom zewnętrznym poprzez konfigurację konta. Aby uzyskać dostęp do tej funkcji, przejdź do strony swojego profilu i przewiń w dół, aż znajdziesz opcje “Widoczność”. Następnie należy wybrać opcję, która zapobiega nieautoryzowanemu udostępnianiu bloga osobom trzecim.

W przypadku korzystania z platform takich jak Instagram, jedną z możliwych strategii jest zmiana ustawień prywatności konta w celu ograniczenia dostępu. Chociaż środek ten nie daje absolutnej pewności, że informacje nie zostaną wykorzystane, biorąc pod uwagę powszechność praktyk gromadzenia danych ukierunkowanych na publicznie dostępne treści, przejście na konto prywatne może służyć jako potężny środek odstraszający.

Alternatywnie, użytkownik ma możliwość skonfigurowania swojego konta na Twitterze jako prywatnego. Należy jednak pamiętać, że środek ten nie zapewnia całkowitej ochrony prywatności danych.

Wspólne oświadczenie różnych krajowych komisarzy ds. informacji i ekspertów z całego świata zasugerowało również pewne działania dla osób, które chcą zminimalizować ryzyko prywatności związane ze skrobaniem danych przez firmy zajmujące się sztuczną inteligencją. Porady obejmują:

Prosimy o zapoznanie się z regulaminem oraz polityką prywatności tej witryny, aby zrozumieć jej praktyki dotyczące udostępniania danych osobowych.

Udostępniając dane osobowe w Internecie, należy zachować ostrożność i powściągliwość, szczególnie w przypadku ujawniania danych wrażliwych.

⭐ Zarządzanie ustawieniami prywatności.

Rozważając treści, które decydujemy się udostępnić w Internecie, ważne jest, aby zachować długoterminową perspektywę i dokładnie rozważyć potencjalne konsekwencje takich ujawnień zarówno w najbliższej, jak i odległej przyszłości.

Jeśli podejrzewasz, że Twoje dane osobowe zostały wyodrębnione bez odpowiedniej autoryzacji z platformy lub witryny społecznościowej, zaleca się skontaktowanie się z odpowiednim dostawcą usług w celu uzyskania wyjaśnień. W przypadku niezadowolenia z ich odpowiedzi, należy rozważyć złożenie skargi do odpowiedniej agencji ochrony danych.

Masz możliwość usunięcia określonych danych, do których potencjalnie mogą mieć dostęp podmioty zewnętrzne, chociaż informacje opublikowane publicznie na Twoim profilu mogły już zostać wyodrębnione przez innych.

Niestety, zakres, w jakim zwykli użytkownicy mogą chronić swoje dane przed korporacjami AI, jest ograniczony.Ostateczny nadzór i uprawnienia w tej kwestii mogą wymagać interwencji organów regulacyjnych.