Czym jest oszustwo AI Voice Clone Family? Jak je wykryć

Szybkie linki

⭐ Jak działa oszustwo związane z klonowaniem głosu AI?

⭐ Dlaczego oszustwa związane z klonowaniem głosu AI są tak skuteczne

⭐ Kluczowe oznaki oszustwa związanego z klonowaniem głosu AI

⭐ Co zrobić, jeśli podejrzewasz oszustwo związane z klonowaniem głosu AI

⭐ Zapobieganie jest najlepszą obroną przed oszustwami związanymi z klonowaniem głosu AI

Kluczowe wnioski

Wykorzystując zaawansowaną technologię sztucznej inteligencji, oszustwa związane z klonowaniem głosu opracowały metodę wiernego odtwarzania ludzkich wzorców mowy z niezwykłą autentycznością, wykorzystując emocjonalne słabości i tworząc poczucie pilności u swoich ofiar.

Oszuści są znani z wykorzystywania informacji uzyskanych z różnych platform mediów społecznościowych w celu stworzenia wiarygodnych sytuacji i wykorzystania istniejących relacji, dzięki czemu ich oszustwa są bardziej przekonujące dla potencjalnych ofiar.

Należy uważać na potencjalne schematy podszywania się pod głos generowany przez sztuczną inteligencję i zachować ostrożność podczas odbierania niechcianych połączeń telefonicznych lub wiadomości tekstowych, które rzekomo pochodzą z zaufanego źródła. W przypadkach, gdy nie masz pewności co do legalności takiej komunikacji, zaleca się zakończenie połączenia i niezależne potwierdzenie wszelkich rzekomych sytuacji awaryjnych przed podjęciem dalszych działań.

Pilna wiadomość głosowa od ciebie dociera do twoich rodziców w późnych godzinach wieczornych, wywołując poczucie niepokoju, gdy przekazujesz niefortunną sytuację. Ujawniasz, że Twój portfel został przywłaszczony, przez co utknąłeś w niewygodnym miejscu i potrzebujesz szybkiej pomocy finansowej w celu natychmiastowej repatriacji.

Reprezentacja dźwiękowa komunikacji wydaje się być niezwykle realistyczna i jednoznacznie odpowiada unikalnym cechom wokalnym ich potomstwa - jednak nie jest autentyczna. Stanowi raczej replikę wygenerowaną przez sztuczną inteligencję, a oni nieświadomie stali się celem oszukańczego schematu, który szczyci się zarówno innowacyjnym, jak i intensywnie niepokojącym poziomem skuteczności.

Jak działa oszustwo związane z klonowaniem głosu AI?

Klonowanie głosu może tworzyć niezwykle realistyczne cyfrowe repliki głosu danej osoby. Technika ta, powszechnie nazywana audio deepfake , jest tworzona za pomocą narzędzi do klonowania głosu AI, takich jak ElevenLabs (sprawdź przykład klonowania głosu AI poniżej). W połączeniu z generatywną sztuczną inteligencją i syntezą głosu, sklonowany głos może replikować emocje, niuanse, intonację, a nawet strach.

Jako punkt odniesienia można odnieść się do sposobu, w jaki Christian Cawley wyraża siebie podczas swojego występu w The Really Useful Podcast.

Aby wygenerować replikę głosu sztucznej inteligencji, zazwyczaj potrzebna jest stosunkowo niewielka ilość danych audio - często nieprzekraczająca sześćdziesięciu sekund. Takie próbki można często uzyskać, wyodrębniając je z publicznie dostępnych treści online, takich jak filmy z mediów społecznościowych, co może sprawić, że niektóre osoby, w tym blogerzy wideo i influencerzy, będą bardziej podatne na ataki ze względu na fakt, że ich nagrania wokalne wykazują doskonałą jakość dźwięku i są łatwo dostępne.

Gdy oszuści uzyskają próbkę głosu w nielegalny sposób, wykorzystują technologię zamiany tekstu na mowę lub konwersję mowy na tekst w czasie rzeczywistym w celu wygenerowania oszukańczych połączeń telefonicznych i komunikacji głosowej.

Stosując kombinację taktyk socjotechnicznych, oszuści są w stanie stworzyć przekonującą narrację opartą na informacjach uzyskanych z obecności ofiary w Internecie. Mogą stworzyć historię dotyczącą sytuacji awaryjnej, takiej jak hospitalizacja lub aresztowanie, a nawet bardziej ekstremalnych scenariuszy, takich jak kradzież lub porwanie. Wykorzystując zaawansowaną technologię zamiany mowy na tekst, są oni w stanie udawać zaufane autorytety i zmanipulować zaniepokojonego krewnego do rozstania się z poufnymi informacjami finansowymi pod pozorem pomocy rzekomo strapionej ukochanej osobie.

Głęboka autentyczność tonów głosu i sentymentów, w połączeniu z nagłym i naglącym charakterem prośby, może przyćmić sceptycyzm, powodując impulsywne decyzje o ujawnieniu zasobów finansowych lub ujawnieniu poufnych danych.

Dlaczego oszustwa związane z klonowaniem głosu AI są tak skuteczne

Oszustwo związane z klonowaniem głosu AI wykorzystuje siłę osobistych relacji, żerując na jednostkach poprzez ich emocjonalne powiązania z innymi. Technika ta wykorzystuje wrażliwość, która pojawia się, gdy dana osoba otrzymuje telefon w niebezpieczeństwie rzekomo od ukochanej osoby, powodując impulsywne działanie z powodu podwyższonych emocji. Zasadniczo strategia ta odzwierciedla te stosowane w oszustwach typu “quid pro”; jednak jej wpływ jest znacznie wzmocniony dzięki znajomości komunikatu głosowego, co dodatkowo pogarsza poczucie pilności i dezorientacji odbiorcy.

Osoby, których bliscy utrzymują rozległą obecność w Internecie lub często podróżują, mogą być szczególnie podatne na takie oszustwa ze względu na wiarygodność, jaką te okoliczności nadają oszukańczej opowieści. Oszuści zazwyczaj gromadzą i wykorzystują dane osobowe zebrane z publicznie dostępnych profili w mediach społecznościowych, dzięki czemu ich oszustwo jest jeszcze bardziej przekonujące.

Kluczowe oznaki oszustwa związanego z klonowaniem głosu AI

Pomimo zaawansowanego charakteru technologii klonowania głosu opartej na sztucznej inteligencji, nadal możliwe jest zidentyfikowanie potencjalnej oszukańczej działalności poprzez rozpoznanie pewnych znaków ostrzegawczych lub “czerwonych flag”. Mogą one obejmować niespójności w używaniu języka, błędy gramatyczne i ogólny brak spójności w komunikacji. W niektórych przypadkach użycie danych osobowych, takich jak nazwiska, adresy i inne dane identyfikacyjne, może również wzbudzić podejrzenia. Zachowując czujność i świadomość tych typowych wskaźników oszustwa, osoby mogą lepiej chronić się przed padnięciem ofiarą oszustw związanych z klonowaniem głosowym AI.

Pilność sugerowana przez oszustwo może stworzyć poczucie natychmiastowości i skłonić odbiorców do podjęcia działań bez odpowiedniego rozważenia sytuacji, ponieważ są oni przekonani, że jeśli nie zastosują się do oszukańczej prośby, spotkają ich tragiczne konsekwencje.

Ważne jest, aby zachować czujność wobec oszustw, ponieważ sprawcy mogą nie mieć pełnej wiedzy na temat osobistej sytuacji lub historii z konkretną osobą lub podmiotem. W związku z tym ważne jest, aby być świadomym wszelkich rozbieżności w informacjach przedstawianych przez osoby lub organizacje, które mogą potencjalnie wskazywać na nieuczciwe zamiary.

Prośby o międzynarodowe przelewy pieniężne lub płatności dokonywane na niejasne portfele cyfrowe nie są rzadkością w takich okolicznościach.

Biorąc pod uwagę wyzwania związane z poruszaniem się w tak niefortunnej sytuacji, może się to okazać trudnym zadaniem. Jednak biorąc pod uwagę te kwestie, można potencjalnie uniknąć stania się ofiarą nieuczciwych schematów.

Co zrobić, jeśli podejrzewasz oszustwo związane z klonowaniem głosu AI

Podczas otrzymywania wiadomości od ukochanych osób doświadczających zamieszania, ważne jest, aby zachować spokój. Oszuści często wykorzystują podwyższone emocje, takie jak niepokój i sentymentalizm, dla osobistych korzyści, zwiększając w ten sposób podatność na ich przebiegłe manewry.

W przypadku odebrania połączenia telefonicznego

Jeśli istnieją najmniejsze wątpliwości co do legalności przychodzącego połączenia telefonicznego, konieczne jest zakończenie połączenia bez wahania. Powstrzymaj się od ujawniania jakichkolwiek danych osobowych lub wchodzenia w rozmowę z podejrzanymi oszustami. Aby zweryfikować prawdziwość domniemanej sytuacji awaryjnej, skontaktuj się z odbiorcą za pośrednictwem zaufanych środków komunikacji.

Ponadto należy pamiętać, że kontynuowanie komunikacji z tymi osobami może skutkować potencjalnym przechwyceniem podpisu głosowego, co może prowadzić do jego nieautoryzowanej replikacji lub wykorzystania do złośliwych celów.

W przypadku otrzymania wiadomości głosowej

Zdecydowanie zaleca się zachowanie wszelkich wiadomości poczty głosowej otrzymanych od potencjalnych oszustów poprzez zapisanie ich na urządzeniu mobilnym lub komputerze. Wykorzystując zaawansowaną technologię sztucznej inteligencji znaną jako narzędzia do klasyfikacji mowy, nagrania te mogą być następnie analizowane w celu rozpoznania, czy pochodzą z prawdziwych ludzkich głosów, czy syntetycznych stworzonych przez automatyzację. Taka analiza działa podobnie do opartych na tekście systemów wykrywania plagiatu, w których plik audio jest wprowadzany do algorytmu w celu identyfikacji.

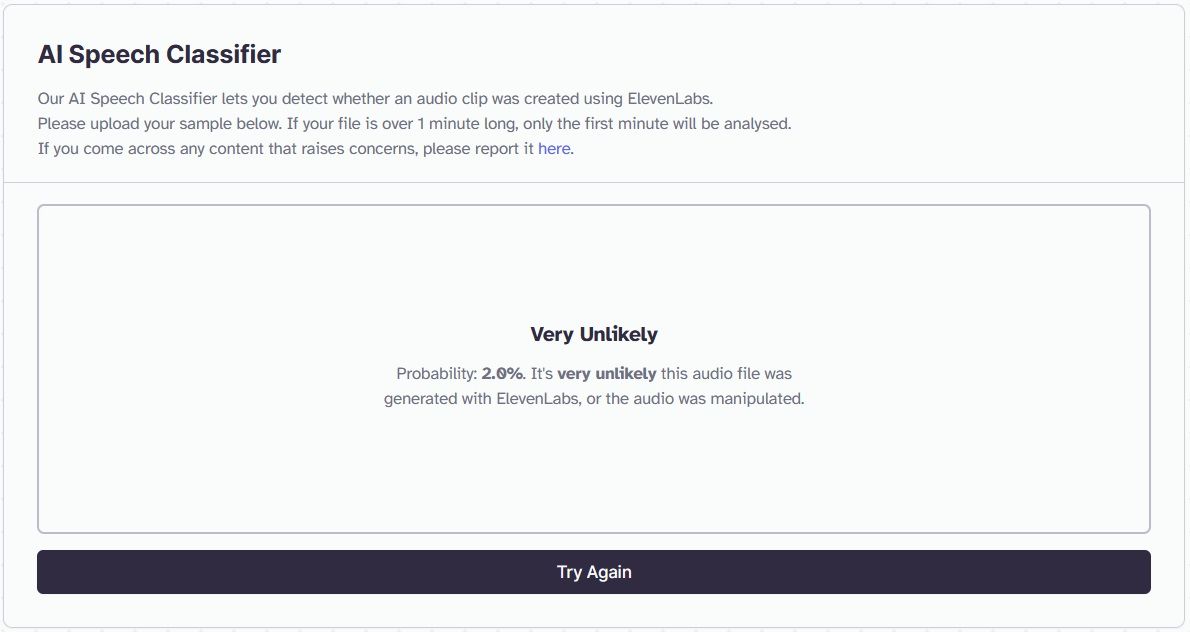

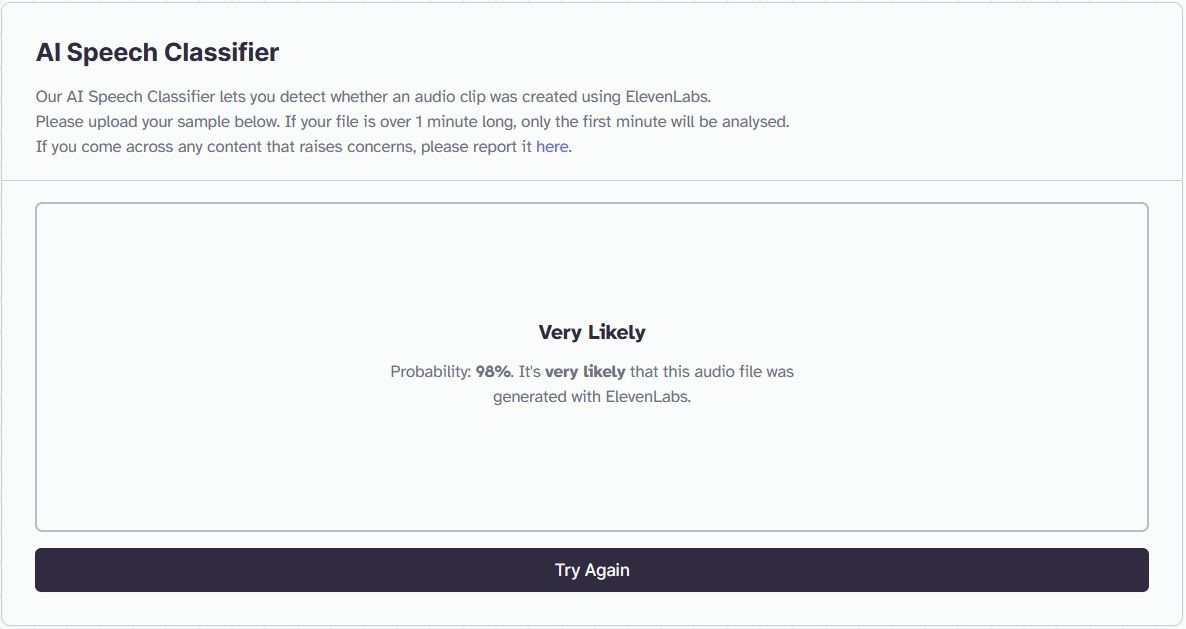

Oceny autentyczności próbek wokalnych można dokonać za pomocą różnych metod, a jednym z takich skutecznych instrumentów jest Speech Classifier dostarczany przez ElevenLabs. Jako wiodący dostawca usług replikacji sztucznej inteligencji, ElevenLabs oferuje niezawodny sposób rozpoznania, czy próbka głosu została poddana cyfrowej duplikacji. Aby wykorzystać to narzędzie do identyfikacji podszywania się pod sztuczną inteligencję, wykonaj następujące kroki:

⭐ Przejdź do strony ElevenLabs Speech Classifier .

Uprzejmie proszę o dostarczenie pliku audio zawierającego wiadomość głosową, a następnie wybranie opcji “Identyfikuj sztuczny głos” po przesłaniu go, klikając przycisk oznaczony “Prześlij próbkę”.

W podanym przypadku osoba przekazała niepokojący komunikat, który został następnie przechwycony i przesłany do systemu klasyfikacji w celu analizy. Jest oczywiste, że treści przypisano umiarkowane prawdopodobieństwo 2%, odpowiadające możliwości manipulacji.

W tym przypadku niepokojąca komunikacja została wygenerowana przy użyciu urządzenia naśladującego głos sztucznej inteligencji. Chociaż głosy mogą wydawać się identyczne w percepcji słuchowej, technologia zarejestrowała niezwykle wysokie prawdopodobieństwo 98%, że komunikacja pochodzi ze sztucznego źródła.

Chociaż ten system klasyfikacji może nie zapewniać absolutnej pewności, może oferować wskazówki sugerujące obecność zduplikowanego wzorca wokalnego. Zdecydowanie zaleca się skontaktowanie się ze znajomym za pośrednictwem ustalonego kanału komunikacji w celu potwierdzenia tych ustaleń.

Zapobieganie jest najlepszą obroną przed oszustwami związanymi z klonowaniem głosu AI

Czasami skutecznym sposobem walki z zaawansowanymi oszustwami może być wykorzystanie stosunkowo prostych metod.

Rozważ wdrożenie spersonalizowanego kodu dostępu udostępnianego wyłącznie bliskim znajomym, takim jak członkowie rodziny i przyjaciele.Ten dyskretny kod może służyć jako niepodważalna weryfikacja w obliczu pilnych zapytań z zaufanych źródeł.

Ostatecznie zachowanie poufności danych osobowych na platformach społecznościowych stanowi istotny środek ochrony przed nieuczciwymi działaniami, które mogą wykorzystywać takie informacje do tworzenia fikcyjnych kont. Zaleca się zachowanie dyskrecji podczas udostępniania wrażliwych danych online, przestrzegając zasady, że to, co jest przeznaczone dla ograniczonej liczby odbiorców, nie powinno być narażone na szerszy publiczny punkt widzenia.