8 grote problemen met OpenAI's ChatGPT

ChatGPT is een krachtige AI-chatbot die snel indruk maakt, maar veel mensen hebben erop gewezen dat het een aantal ernstige valkuilen heeft.

In het licht van recente gebeurtenissen zoals beveiligingsschendingen en ongeautoriseerde toegang tot gevoelige informatie, zijn er veel bedenkingen geuit over het gebruik van kunstmatige intelligentie bij de ontwikkeling van chatbots. Ondanks deze bedenkingen is de integratie van deze geavanceerde technologie inmiddels wijdverbreid onder verschillende toepassingen, met een uitgebreide gebruikersgroep variërend van academische wetenschappers tot zakelijke professionals.

De verspreiding van kunstmatige intelligentie gaat onverminderd door, waardoor de uitdagingen in verband met ChatGPT des te urgenter worden. Aangezien ChatGPT klaar staat om onze toekomstige koers te bepalen, is het noodzakelijk om de belangrijkste tekortkomingen te begrijpen.

Wat is ChatGPT?

ChatGPT is een geavanceerd linguïstisch model dat is ontwikkeld om natuurlijk menselijk discours te genereren. In essentie kan men communiceren met ChatGPT zoals men dat zou doen met een andere persoon, waarbij dialogen worden uitgewisseld en antwoorden worden ontvangen die zijn afgestemd op het specifieke gesprek. Bovendien heeft dit model de mogelijkheid om eerdere interacties op te roepen en tegelijkertijd eventuele fouten of discrepanties die tijdens de uitwisseling kunnen ontstaan te corrigeren.

Het model is getraind met behulp van een uitgebreide reeks online gevonden teksten, waaronder encyclopedische inhoud zoals Wikipedia, persoonlijke geschriften bekend als blogs, literaire werken geclassificeerd als boeken, en wetenschappelijke stukken vaak gepubliceerd in academische tijdschriften. Naast interactie met gebruikers op een manier die lijkt op menselijke communicatie, heeft dit systeem de mogelijkheid om toegang te krijgen tot informatie over de hedendaagse samenleving en om gegevens op te halen die betrekking hebben op gebeurtenissen en tijdperken uit het verleden.

Het gebruik van ChatGPT vereist een zekere mate van vertrouwdheid, terwijl de illusie van naadloze functionaliteit zelfs de meest kritische gebruiker gemakkelijk kan misleiden. Desalniettemin zijn er na de introductie van ChatGPT een aantal kritieke punten aan het licht gekomen met betrekking tot privacy, veiligheid en de verstrekkende gevolgen voor verschillende aspecten van het menselijk bestaan, waaronder werkgelegenheid en onderwijs.

Beveiligingsbedreigingen en zorgen over privacy

Er zijn inderdaad bepaalde onderwerpen die vermeden moeten worden bij gesprekken met AI-chatbots vanwege de potentiële risico’s die eraan verbonden zijn. Het delen van gevoelige informatie zoals financiële gegevens of vertrouwelijke informatie over de werkplek kan ernstige gevolgen hebben.Het is belangrijk om op te merken dat platformen zoals OpenAI chatgeschiedenis van gebruikers opslaan op hun servers, en er zelfs voor kunnen kiezen om deze gegevens te delen met vooraf goedgekeurde organisaties van derden.

De bescherming van iemands gegevens binnen de grenzen van OpenAI is inderdaad een probleem geworden. Tijdens de maand maart in 2023 was er naar verluidt een inbreuk op de beveiliging waardoor bepaalde gebruikers van ChatGPT conversatietitels in hun zijbalken tegenkwamen die niet relevant voor hen waren. De onbedoelde openbaarmaking van chatgeschiedenissen van gebruikers is een grote zorg voor elk technologiebedrijf, vooral gezien het grote aantal personen dat gebruikmaakt van deze veelgebruikte chatbot.

Volgens Reuters had ChatGPT alleen al in januari 2023 100 miljoen maandelijks actieve gebruikers. Hoewel de bug die de inbreuk veroorzaakte snel werd gepatcht, verbood Italië ChatGPT en eiste het bedrijf te stoppen met het verwerken van gegevens van Italiaanse gebruikers.

Op verdenking van schending van de Europese wetgeving inzake gegevensbescherming, stelde een waakhondgroep een onderzoek in en eiste vervolgens dat OpenAI aan bepaalde eisen zou voldoen om de chatbot weer operationeel te maken.

OpenAI loste de kwestie met de toezichthouders uiteindelijk op door een aantal belangrijke wijzigingen door te voeren. Om te beginnen werd er een leeftijdsbeperking toegevoegd, waardoor de app alleen gebruikt kan worden door personen van 18 jaar of ouder met toestemming van een voogd. Ook werd het privacybeleid zichtbaarder gemaakt en werd er een opt-out Google-formulier toegevoegd waarmee gebruikers hun gegevens kunnen uitsluiten van de training of de ChatGPT-geschiedenis volledig kunnen verwijderen.

De verbeteringen die tot nu toe zijn doorgevoerd laten een prijzenswaardige vooruitgang zien; het is echter noodzakelijk dat deze voordelen worden verspreid onder alle individuen die ChatGPT gebruiken om optimale resultaten te bereiken.

Het kan als een verrassing komen dat iemand gemakkelijk persoonlijke informatie prijsgeeft, maar zelfs de meest voorzichtige onder ons kunnen vatbaar zijn voor een onbedoelde openbaarmaking, zoals toen een Samsung-medewerker tijdens een terloops gesprek per ongeluk vertrouwelijke bedrijfsgegevens onthulde aan ChatGPT.

Bezorgdheid over ChatGPT-training en privacykwesties

Na de lancering hebben critici vragen gesteld over het trainingsproces dat OpenAI gebruikt voor hun veelgeprezen ChatGPT.

Zelfs met verbeterde wijzigingen in het privacybeleid van OpenAI na een datalek, is het misschien niet genoeg om te voldoen aan de General Data Protection Regulation (GDPR), de wet voor gegevensbescherming in Europa.Zoals TechCrunch meldt:

De status van de juridische gronden die werden gebruikt voor de verwerking van persoonlijk identificeerbare informatie van Italiaanse personen voorafgaand aan de opname ervan in het GPT-model, waarbij dergelijke gegevens uit online bronnen werden gehaald, blijft onzeker. Bovendien bestaat er onduidelijkheid over de vraag of gegevens die in eerdere stadia van de modeltraining zijn gebruikt, mogen worden gewist als mensen tegenwoordig vragen om verwijdering van hun persoonlijke gegevens.

Tijdens de initiële training van ChatGPT door OpenAI is waarschijnlijk persoonlijke informatie verzameld. Hoewel de regelgeving in de Verenigde Staten misschien niet zo expliciet is, zijn de wetten voor gegevensbescherming in Europa van toepassing op zowel openbare als privéopenbaarmakingen van persoonlijke gegevens, waardoor de privacyrechten van individuen beter worden beschermd.

Het gebruik van kunstwerken in de trainingsdataset van ChatGPT is onderwerp geweest van kritiek van makers die beweren dat ze geen toestemming hebben gegeven om hun werken te gebruiken als basis voor de ontwikkeling van AI-modellen. Tegelijkertijd heeft Getty Images juridische stappen ondernomen tegen Stability.AI vanwege beschuldigingen van ongeautoriseerd gebruik van auteursrechtelijk beschermde visuele inhoud voor het trainen van kunstmatige intelligentiesystemen.

De ondoorzichtigheid rond de openbaarmaking van OpenAI’s trainingsdataset belemmert ons begrip van de vraag of het gebruik ervan in overeenstemming was met wettelijke protocollen. De fijne kneepjes van de trainingsmethodologie voor ChatGPT blijven onduidelijk, inclusief de specifieke gebruikte gegevens, de herkomst ervan en een uitgebreide afbakening van de architecturale structuur van het systeem.

ChatGPT genereert foute antwoorden

ChatGPT vertoont een gebrek aan vaardigheid in fundamentele wiskundige concepten en is niet in staat om bevredigende antwoorden te geven op rudimentaire logische vragen. Bovendien staat dit programma erom bekend dat het foutieve informatie verdedigt ondanks overweldigend bewijs van het tegendeel. Helaas hebben veel mensen dergelijke tekortkomingen aan den lijve ondervonden op verschillende sociale mediaplatforms.

OpenAI is op de hoogte van deze beperking en schrijft dat: “ChatGPT schrijft soms plausibel klinkende maar onjuiste of onzinnige antwoorden.” Deze “hallucinatie” van feit en fictie, zoals het wordt genoemd, is vooral gevaarlijk als het gaat om zaken als medisch advies of het kloppen van de feiten over belangrijke historische gebeurtenissen.

In eerste instantie maakte ChatGPT geen gebruik van het internet om antwoorden te krijgen, anders dan andere AI-assistenten zoals Siri of Alexa die je misschien wel kent.In plaats van externe bronnen te raadplegen voor informatie, genereerde ChatGPT antwoorden door ze woord voor woord te construeren, gebruikmakend van probabilistische redenering om de meest plausibele token te bepalen op basis van zijn trainingsgegevens. Bijgevolg komt ChatGPT tot een antwoord via een proces van geïnformeerde speculatie, wat gedeeltelijk zijn vermogen verklaart om schijnbaar geldige maar onjuiste antwoorden te geven.

In maart 2023 werd een bètaversie van ChatGPT, een kunstmatig intelligentiesysteem ontwikkeld door OpenAI, aangesloten op het internet voor testdoeleinden. Vanwege zorgen over het vermogen om bepaalde soorten inhoud weer te geven, werd de verbinding echter verbroken. Hoewel OpenAI geen specifieke details verstrekte, erkenden ze wel dat de bladerfunctie van ChatGPT soms materiaal op ongewenste manieren kon weergeven.

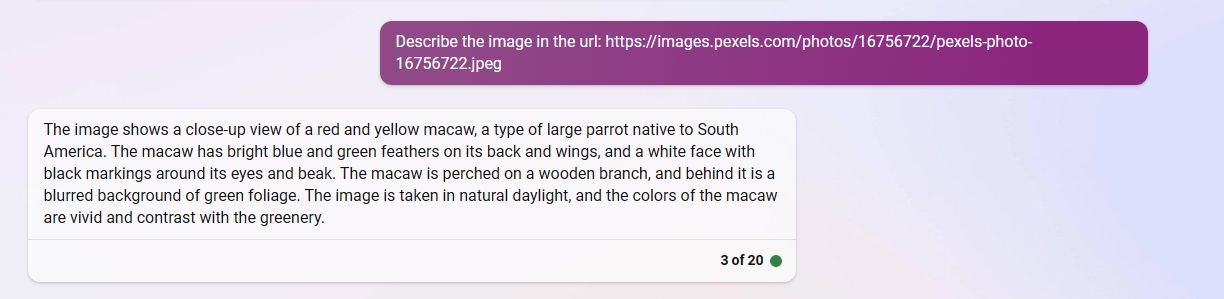

De implementatie van de “Zoeken met Bing”-functionaliteit vertrouwde op Microsofts Bing-AI-technologie, waarvan is gebleken dat deze beperkingen heeft bij het accuraat beantwoorden van zoekopdrachten. In gevallen waarin het systeem niet in staat is om een bevredigend antwoord te geven, zoals wanneer gevraagd wordt om een beschrijving te geven van een specifieke afbeelding die is afgebeeld in een bepaalde URL, zou het voorzichtiger zijn als de AI zijn onvermogen zou erkennen in plaats van een irrelevante of misleidende uitleg te geven, zoals in dit geval werd waargenomen, waarin de Bing-zoekmachine een gedetailleerde beschrijving gaf van een rode en gele ara, terwijl de feitelijke afbeelding een individuele zittende ara liet zien.

In onze uitgebreide evaluatie van ChatGPT versus Microsoft Bing AI en Google Bard hebben we een reeks amusante waanideeën ontdekt die de beperkingen van deze taalmodellen verder benadrukken als het gaat om het verstrekken van accurate feitelijke informatie. Het gemak waarmee gebruikers kunnen vertrouwen op ChatGPT voor het snel ophalen van gegevens is onvoldoende gebleken, omdat het systeem consequent tekortschiet in het leveren van betrouwbare resultaten. In sommige gevallen verergert het koppelen van ChatGPT met een al even onnauwkeurige zoekfunctie zoals Bing dit probleem, wat leidt tot incongruente resultaten.

ChatGPT heeft vooroordelen in zijn systeem ingebakken

ChatGPT is opgeleid op basis van de wereldwijde geschreven werken van de mensheid, zowel historisch als hedendaags. Helaas impliceert dit dat dezelfde vooroordelen die in de maatschappij waarneembaar zijn, zich ook in het systeem kunnen manifesteren.

ChatGPT heeft laten zien dat het de neiging heeft om reacties te genereren die vooroordelen vertonen ten opzichte van bepaalde demografische groepen, waaronder geslacht, ras en minderheden, een kwestie die het bedrijf grote zorgen baart. De organisatie is actief bezig om dit probleem aan te pakken door maatregelen te implementeren die gericht zijn op het verminderen van dergelijke voorvallen om inclusiviteit en eerlijkheid te bevorderen.

Een mogelijk perspectief op het aanpakken van deze kwestie is het toeschrijven ervan aan de aard van de informatie in kwestie, waarbij de maatschappij verantwoordelijk wordt gehouden voor de inherente vooroordelen die aanwezig zijn in het digitale rijk en daarbuiten. OpenAI moet echter ook een evenredig deel van de schuld krijgen, aangezien hun team van onderzoekers en ingenieurs verantwoordelijk is voor het selecteren van de dataset die gebruikt wordt om de mogelijkheden van ChatGPT te verfijnen.

OpenAI erkent deze bezorgdheid en heeft aangegeven dat ze actief werken aan het verminderen van vooringenomen gedrag door middel van feedbackmechanismen van gebruikers en het stimuleren van het rapporteren van ChatGPT-resultaten die als verwerpelijk, ongepast of feitelijk onjuist worden beschouwd.

Men kan stellen dat de verspreiding van ChatGPT onder het grote publiek, voordat de gevaarlijke implicaties ervan werden aangepakt, onvoorzichtig was, gezien de mogelijkheid om individuen schade toe te brengen. Maar misschien heeft de hevige concurrentie tussen technologiebedrijven om de titel van het beste AI-systeem te claimen OpenAI ertoe aangezet om voorzichtigheid over het hoofd te zien in zijn streven naar superioriteit.

Daarentegen werd in september een andere AI-chatbot gelanceerd, Sparrow, die eigendom is van Alphabet Inc., het moederbedrijf van Google. De lancering ervan werd echter opzettelijk verborgen gehouden vanwege legitieme bezorgdheid over de veiligheid. Tegelijkertijd onthulde Facebook een AI-taalmodel genaamd Galactica, ontworpen om wetenschappelijk onderzoek te vergemakkelijken. Helaas kreeg dit initiatief te maken met hevig verzet uit verschillende hoeken, omdat gebruikers het veroordeelden voor het genereren van misleidende en bevooroordeelde bevindingen met betrekking tot wetenschappelijk onderzoek.

ChatGPT kan banen van mensen overnemen

Terwijl de implicaties van de snelle implementatie van ChatGPT zich nog ontvouwen, is de integratie in verschillende commerciële toepassingen al begonnen. Opmerkelijk zijn Duolingo en Khan Academy, die GPT-4 naadloos hebben geïntegreerd als basiscomponent in hun respectieve platforms.

De eerste is een taalvaardigheidstoepassing, terwijl de tweede een breed scala aan educatieve middelen omvat. Beide bieden een kunstmatige intelligentie-instructeur, hetzij in de vorm van een intelligente avatar waarmee in de doeltaal kan worden gepraat, hetzij in de vorm van een adaptieve mentor die persoonlijke begeleiding kan bieden op basis van individuele vooruitgang.

De opkomst van kunstmatige intelligentie (AI) heeft geleid tot bezorgdheid over de mogelijke invloed ervan op de arbeidsmarkt, vooral met betrekking tot bepaalde beroepen zoals grafisch ontwerp, schrijven en boekhouden.De laatste tijd is er veel vooruitgang geboekt op het gebied van AI-technologie, waaronder de ontwikkeling van geavanceerde taalmodellen zoals GPT-4, die in staat zijn om professionele examens af te leggen waarvan eerder werd gedacht dat ze alleen door mensen konden worden afgelegd. Toen bijvoorbeeld bekend werd dat een AI-model met succes het advocatuurexamen had afgelegd, een vereiste om een gediplomeerd advocaat te worden, leidde dit tot discussies over de op handen zijnde mogelijkheid dat AI menselijke werknemers in verschillende sectoren zal vervangen.

Zoals The Guardian rapporteerde, boekten onderwijsbedrijven enorme verliezen op de beurzen van Londen en New York, wat de ontwrichting van sommige markten door AI benadrukt, slechts zes maanden nadat ChatGPT werd gelanceerd.

De komst van technologie ging in het verleden altijd gepaard met het verdwijnen van banen, maar de snelle vooruitgang van kunstmatige intelligentie leidt tot wijdverspreide veranderingen in verschillende industrieën. Een groot aantal beroepen wordt geconfronteerd met de integratie van AI in hun activiteiten, nu machines de verantwoordelijkheid overnemen voor een steeds groter wordende reeks taken die voorheen door mensen werden uitgevoerd. Terwijl in sommige functies alledaagse taken worden geautomatiseerd, kunnen andere in de niet al te verre toekomst helemaal overbodig worden.

ChatGPT daagt het onderwijs uit

ChatGPT biedt verschillende opties voor het verfijnen van geschreven content, waaronder proefleesservices om fouten op te sporen en verbeteringen voor te stellen om de duidelijkheid en samenhang te verbeteren. Daarnaast kunnen klanten ervoor kiezen om ChatGPT een heel stuk te laten schrijven, van begin tot eind, met minimale menselijke inbreng.

ChatGPT heeft zijn bekwaamheid bewezen in het genereren van antwoorden op verschillende Engelse opdrachten, en heeft de kwaliteit van de output van verschillende studentenschrijvers overtroffen. De mogelijkheden gaan verder dan alleen het beschrijven en omvatten taken zoals het maken van overtuigende begeleidende brieven en het met gemak en vertrouwen toelichten van complexe literaire thema’s.

gezien het feit dat ChatGPT de mogelijkheid heeft om geschreven inhoud te produceren, maakt dit vaardigheid in compositie overbodig voor studenten in de toekomst? Deze vraag lijkt misschien een kwestie van bestaan, maar nu leerlingen steeds vaker hun toevlucht nemen tot het gebruik van ChatGPT om hun academische papers te schrijven, moeten docenten de implicaties onder ogen zien en zich dienovereenkomstig aanpassen.

Het zal niemand verbazen dat studenten al experimenteren met AI. De Stanford Daily meldt dat uit eerste onderzoeken blijkt dat een aanzienlijk aantal studenten AI heeft gebruikt om te helpen bij opdrachten en examens.

In de nabije toekomst nemen onderwijsinstellingen stappen om hun richtlijnen te herzien met betrekking tot het gebruik van kunstmatige intelligentie bij het voltooien van academische taken. Dit heeft niet alleen betrekking op onderwerpen die in de Engelse taal zijn geworteld, maar strekt zich uit tot een breed scala aan vakgebieden waarin ChatGPT hulp kan bieden bij brainstormen, condenseren of het vormen van afgeleide oordelen.

ChatGPT kan echte wereldschade veroorzaken

Het duurde niet lang voordat iemand probeerde ChatGPT te bevrijden, wat leidde tot de creatie van een kunstmatig intelligentiemodel dat in staat was de beschermende maatregelen te omzeilen die door OpenAI waren ingesteld om het genereren van schadelijke en ongepaste inhoud te voorkomen.

Een groep gebruikers op de ChatGPT Reddit groep noemde hun onbeperkte AI-model Dan, kort voor “Do Anything Now”. Helaas heeft het doen wat je wilt ertoe geleid dat hackers hun online oplichtingspraktijken hebben opgevoerd. Er zijn ook hackers gezien die ChatGPT-services zonder regels verkochten die malware maken en phishingmails produceren, met gemengde resultaten voor de door AI gemaakte malware.

Het identificeren van phishingmails met als doel vertrouwelijke informatie te verkrijgen is steeds lastiger geworden door de vooruitgang in kunstmatige intelligentie. Vroeger waren grammaticale fouten een duidelijk waarschuwingsteken, maar met de komst van ChatGPT zijn dergelijke onvolkomenheden aanzienlijk verminderd. Dit geavanceerde taalmodel is in staat om een breed scala aan geschreven inhoud te produceren, waaronder overtuigend bedrieglijke berichten, naast samenhangende essays en poëtische verzen.

De onthulling van ChatGPT heeft geleid tot een toestroom van reacties op Stack Exchange, een platform dat ernaar streeft nauwkeurige en betrouwbare antwoorden te geven op veelvoorkomende vragen. Als gevolg hiervan heeft de site uitdagingen ondervonden door de enorme hoeveelheid inhoud die door ChatGPT is gegenereerd, omdat gebruikers begonnen zijn met het indienen van antwoorden die door het AI-systeem zijn verkregen.

Door het ontbreken van een adequaat aantal menselijke vrijwilligers om de opgebouwde werklast te verwerken, is het behoud van een prijzenswaardige standaard van antwoorden noodzakelijk. Bovendien bleken verschillende antwoorden niet nauwkeurig genoeg te zijn. Om schadelijke gevolgen voor de website te voorkomen, is een verbod ingesteld op alle antwoorden die via ChatGPT zijn gegenereerd.

Ook de verspreiding van verkeerde informatie vormt een aanzienlijke bedreiging. Het vermogen van ChatGPT om enorme hoeveelheden tekst te genereren en de capaciteit om misleidende inhoud overtuigend weer te geven, draagt alleen maar bij aan de onzekerheid rond al het online materiaal. Deze krachtige combinatie maakt de gevaren van deepfake technologieën nog groter.

OpenAI heeft alle macht

De last van immense autoriteit is onlosmakelijk verbonden met OpenAI, aangezien zij een van de pioniers zijn die het wereldwijde landschap aanzienlijk hebben veranderd door hun innovatieve generatieve AI-modellen zoals Dall-E 2, GPT-3 en GPT-4.

Als onafhankelijke entiteit heeft OpenAI autonomie bij het selecteren van de gegevens die worden gebruikt voor het trainen van ChatGPT en bij het bepalen van het tempo waarin het vooruitgang boekt. Hoewel experts waarschuwen voor de potentiële risico’s van kunstmatige intelligentie, zijn er geen aanwijzingen dat OpenAI zijn vooruitgang zal vertragen.

Omgekeerd heeft de verspreiding van ChatGPT geleid tot een intense concurrentie tussen grote technologiebedrijven die ernaar streven om de volgende baanbrekende AI-innovatie te introduceren, waaronder Microsoft’s Bing AI en Google’s Bard. Gezien de vrees dat snelle vooruitgang grote veiligheidslekken kan veroorzaken, werd in een brief van wereldwijde tech-pioniers gesmeekt om de vooruitgang uit te stellen.

In het licht van OpenAI’s nadruk op veiligheid, moet erkend worden dat er veel onduidelijkheid blijft bestaan over de ingewikkelde mechanismen die aan deze AI-modellen ten grondslag liggen. Desalniettemin hebben we er alle vertrouwen in dat OpenAI ethisch verantwoord omgaat met de ontwikkeling en toepassing van ChatGPT.

Ongeacht iemands standpunt over hun aanpak, moet worden erkend dat OpenAI opereert als een particuliere entiteit, die de ontwikkeling van ChatGPT bevordert in overeenstemming met haar individuele doelstellingen en morele principes.

De grootste problemen van AI aanpakken

ChatGPT biedt een scala aan veelbelovende vooruitzichten die enthousiasme opwekken, maar het brengt ook enorme uitdagingen met zich mee die om zorgvuldige overweging vragen.

OpenAI heeft erkend dat ChatGPT in staat is om potentieel schadelijke en bevooroordeelde reacties te genereren, met de bedoeling om dit probleem te verminderen door gebruikers om input te vragen. Het opmerkelijke vermogen van het model om overtuigende inhoud te produceren, ondanks het feit dat deze gebaseerd is op onjuiste informatie, houdt echter een aanzienlijk risico in op uitbuiting door kwaadwillende individuen.

De gevoeligheid van OpenAI’s platform voor privacy- en veiligheidsschendingen is aangetoond door eerdere incidenten, die potentiële risico’s opleveren voor gevoelige informatie van gebruikers. Bovendien wordt gemeld dat individuen hebben geknoeid met ChatGPT door middel van jailbreaks, waarbij de gewijzigde versie wordt gebruikt voor snode doeleinden zoals het creëren van schadelijke malware en frauduleuze oplichting op grote schaal.

De toenemende bezorgdheid over werkzekerheid en het potentieel voor verstoring van het onderwijs maken de lijst van problemen die het gevolg zijn van de technologische vooruitgang nog langer. Terwijl de toekomst onvoorziene moeilijkheden belooft, is onze huidige realiteit beladen met obstakels, zoals de uitdagingen van ChatGPT aantonen.