Google PaLM 2 vs. OpenAI GPT-4: wat is het verschil?

Google heeft op 10 mei 2023 tijdens Google I/O de volgende generatie van zijn Pathways Language Model (PaLM 2) onthuld. Zijn nieuwe grote taalmodel (LLM) is veel beter dan zijn voorganger (PaLM) en is misschien eindelijk klaar om het op te nemen tegen zijn grootste rivaal, OpenAI’s GPT-4.

Het is inderdaad nog maar de vraag in hoeverre Google vooruitgang heeft geboekt. Kan PaLM 2 inderdaad de cruciale factor blijken te zijn die Google voor ogen heeft? Wat onderscheidt PaLM 2 van OpenAI’s GPT-4, gezien het grote aantal vergelijkbare competenties dat op de markt beschikbaar is?

PaLM 2 vs. GPT-4: Overzicht van prestaties

PaLM 2 heeft een groot aantal innovatieve functies die het onderscheiden van zijn voorloper, waaronder de veelzijdigheid van kleinere formaten die zijn afgestemd op specifieke taken waarvoor minder rekenkracht nodig is dan bij GPT-4.

Elk van de bovengenoemde afmetingen heeft zijn corresponderende verkleinde tegenhangers die bekend staan als gekko, otter, bizon en eenhoorn, waarbij gekko de meest kleine iteratie vertegenwoordigt, gevolgd door otter, bizon en uiteindelijk eenhoorn, de grootste van allemaal.

Google beweert dat het zijn redeneervaardigheden heeft verbeterd in vergelijking met die van GPT-4 in zowel WinoGrande als DROP, waarbij het een marginale overwinning behaalde in ARC-C. Verder zijn er aanzienlijke verbeteringen waargenomen op alle gebieden met betrekking tot PaLM en SOTA.

PaLM 2 is ook beter in wiskunde, volgens het 91 pagina’s tellende PaLM 2-onderzoeksartikel [PDF] van Google. De manier waarop Google en OpenAI hun testresultaten hebben gestructureerd, maakt het echter moeilijk om de twee modellen rechtstreeks te vergelijken. Google heeft ook enkele vergelijkingen weggelaten, waarschijnlijk omdat PaLM 2 lang niet zo goed presteerde als GPT-4.

MMLU, HellaSwag en ARC-E. Uit de resultaten bleek dat GPT-4 het in alle gevallen beter deed dan PaLM 2, behalve in één geval waarin ze even goed scoorden. In MMLU behaalde GPT-4 een score van 86,4%, terwijl PaLM 2 81% behaalde. Ook bij het HellaSwag-model behaalde GPT-4 een indrukwekkende score van 95,3%, terwijl de prestaties van PaLM 2 met 86,8% iets lager waren. Tot slot presteerden beide modellen in het ARC-E model

Het grootste model in de PaLM 2-familie is PaLM 2-L. Hoewel we niet precies weten hoe groot dit model is, weten we wel dat het aanzienlijk kleiner is dan het grootste PaLM-model, maar dat het meer trainingsgegevens gebruikt. Volgens Google heeft PaLM 540 miljard parameters, dus met “aanzienlijk kleiner” zou PaLM 2 ergens tussen de 10 miljard en 300 miljard parameters moeten liggen.Bedenk wel dat deze getallen slechts aannames zijn, gebaseerd op wat Google heeft gezegd in het PaLM 2-paper.

In het licht van het feit dat als het genoemde getal in de buurt van 100 miljard of minder valt, is het zeer waarschijnlijk dat PaLM 2 minder parameters zal vertonen in vergelijking met GPT-3. Het idee dat een potentieel model met schaalbeperkingen in staat is om met GPT-4 te concurreren en GPT-4 in bepaalde taken te overtreffen, is inderdaad opmerkelijk. Omgekeerd was GPT-3.5 aanvankelijk ongeëvenaard in prestaties en overtrof zelfs PaLM, maar PaLM 2 heeft een bewonderenswaardige comeback laten zien.

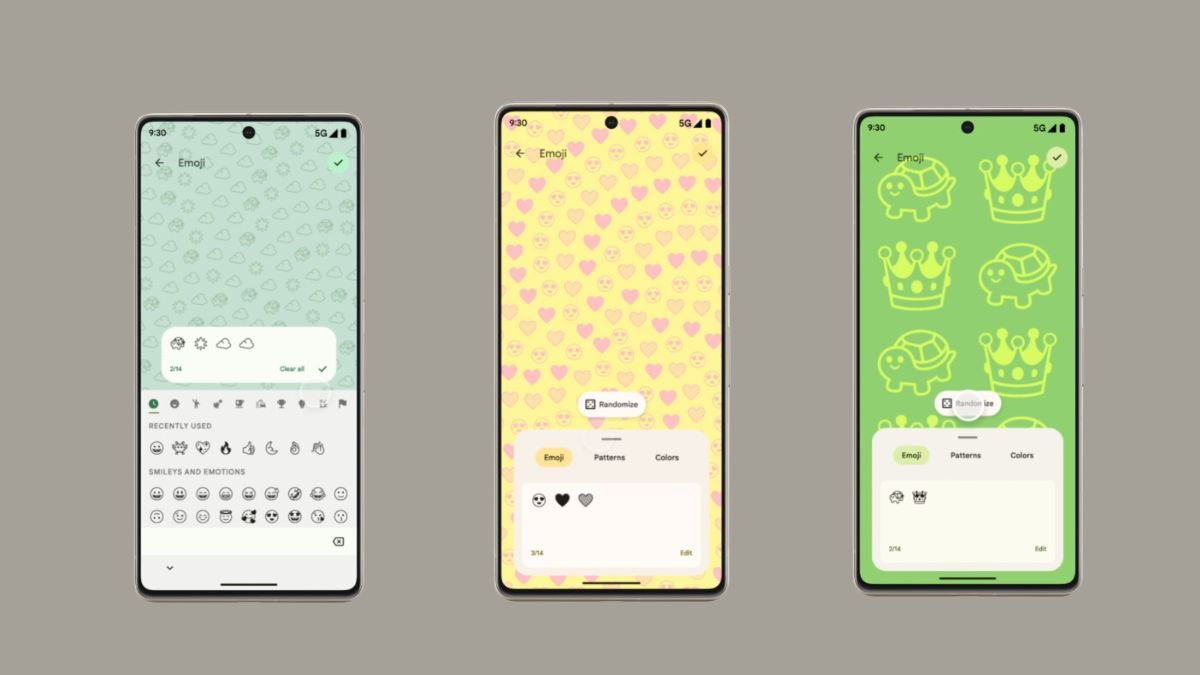

PaLM 2 biedt een opmerkelijk voordeel ten opzichte van GPT-4 wat betreft de veelzijdigheid van de beschikbare maten. Hierdoor kunnen verschillende versies van het model, zoals Gecko, worden gebruikt op mobiele apparaten, zelfs als er geen internetverbinding aanwezig is, waardoor er mogelijkheden voor kunstmatige intelligentie aan boord zijn die GPT-4 nog niet heeft. De mogelijkheid tot verwerking op het apparaat vergroot de toegankelijkheid en bruikbaarheid van PaLM 2 ten opzichte van GPT-4.

Verschillen in GPT-4 en PaLM 2 Training Data

Google heeft de omvang van de gebruikte training dataset voor PaLM 2 niet bekendgemaakt, maar uit hun onderzoek blijkt duidelijk dat dit nieuwe grote taalmodel is getraind op een aanzienlijk uitgebreidere dataset dan zijn voorganger. Op dezelfde manier heeft Google

Om een beter begrip te krijgen van wiskundige, logische en wetenschappelijke concepten, heeft Google de nadruk gelegd op deze gebieden binnen de trainingsdataset voor PaLM 2. Zoals vermeld in hun onderzoeksdocument, bestaat het voortrainingscorpus van PaLM 2 uit verschillende bronnen, zoals websites, literatuur, programmeertaal, wiskundige teksten en transcripties van gesprekken, wat resulteert in verbeteringen ten opzichte van het oorspronkelijke model in tal van opzichten.

Gezien de uitgebreide taalvaardigheid van PaLM 2, die meer dan 100 taalkundige kaders omvat, wordt verwacht dat PaLM 2 uitzonderlijke conversatievaardigheden zal vertonen, dankzij het verbeterde contextuele begrip en de naadloze vertalingen. Het verminderde gebruik van gegevens tijdens de training resulteert naar verluidt in een verminderde generatie van schadelijke inhoud, door het omzeilen van sites met haatdragend discours of schadelijk gedrag. Met name substantiële tekstgebaseerde opslagplaatsen zoals Reddit worden uitgesloten van het leerproces, wat resulteert in een resultaat dat wordt gekenmerkt door een verhoogde mate van fatsoen en beleefdheid.

Wat betreft de trainingsgegevens van GPT-4 heeft OpenAI ons verteld dat het model is getraind met behulp van openbaar beschikbare gegevens en gegevens waarvoor het een licentie heeft. GPT-4’s onderzoekspagina stelt: “De data is een corpus van gegevens op webschaal, inclusief correcte en incorrecte oplossingen voor wiskundige problemen, zwakke en sterke redeneringen, zelftegenstrijdige en consistente uitspraken, en vertegenwoordigt een grote verscheidenheid aan ideologieën en ideeën.”

Door gebruik te maken van versterkend leren en menselijke input te integreren, heeft OpenAI de prestaties van GPT-4 verfijnd om ervoor te zorgen dat de gegenereerde antwoorden beter overeenkomen met het beoogde doel achter een bepaalde vraag. Dit proces helpt om alle externe of irrelevante output uit het systeem te filteren, waardoor gebruikers uiteindelijk een nauwkeuriger en bevredigender antwoord op hun vragen krijgen.

Het is belangrijk om op te merken dat de specifieke trainingsgegevens die door elk model zijn gebruikt onbekend blijven; er kan echter wel worden afgeleid dat het beoogde doel achter hun respectieve trainingen aanzienlijk verschilde. Het uiteindelijke resultaat van dergelijke discrepanties zal pas duidelijk worden wanneer beide modellen worden ingezet in een daadwerkelijke operationele omgeving.

Gezien de grote hoeveelheid trainingsgegevens die GPT-4 gebruikt, is het in een goede positie om de subtiliteiten van taal beter te begrijpen dan zijn voorgangers, waardoor het een betere kwaliteit output genereert. Niettemin vereist een dergelijk uitgebreid gebruik strenge beperkingen voor het model om ongewenst gedrag te voorkomen, wat niet van toepassing is op Google gezien hun beslissing om schadelijke inhoud uit te sluiten van het trainingsproces.

PaLM 2 en GPT-4 Chatbots en services

Door gebruik te maken van de respectievelijke chatbots van elk taalmodel, kunnen gebruikers toegang krijgen tot beide via twee afzonderlijke portals. De toegang tot GPT-4 is echter beperkt tot abonnees van de premiumservice ChatGPT Plus, terwijl degenen die niet willen betalen nog steeds kunnen communiceren met GPT-3. Aan de andere kant is de Bard van PaLM 2 gratis en wereldwijd toegankelijk in meer dan 180 landen.

Het mag dan waar zijn dat GPT-4 gratis toegankelijk is, je moet niet vergeten dat Microsofts Bing AI Chat deze technologie gebruikt en voor iedereen gratis toegankelijk is. Het bevindt zich zelfs naast Bing Search, een opvallende concurrent van Google in hetzelfde domein.

Tijdens de recente editie van Google I/O in 2023 werd onthuld dat significante verbeteringen in zowel PaLM 2 als de integratie van generatieve AI de algehele gebruikerservaring binnen het Google Workspace ecosysteem aanzienlijk zullen verbeteren. Deze innovatieve integratie strekt zich uit tot een groot aantal services van de techreus, zoals Google Docs, Sheets, Slides en Gmail.Verder is het vermeldenswaard dat Google heeft geverifieerd dat PaLM 2 momenteel naadloos is geïntegreerd in meer dan vijfentwintig verschillende toepassingen in zijn productportfolio, waaronder het populaire mobiele besturingssysteem Android en het videodeelplatform YouTube.

Microsoft heeft AI-mogelijkheden geïntegreerd in de Microsoft Office-suite van toepassingen en in talloze diensten. Op dit moment hebben gebruikers de mogelijkheid om getuige te zijn van een competitie tussen AI-technologieën die worden aangeboden door twee concurrerende bedrijven die strijden om de dominantie op dit gebied.

Als gevolg van de vroege release en de ijverige inspanningen om de misstappen van zijn voorganger te vermijden, is GPT-4 het overheersende Large Language Model (LLM) geworden onder externe ontwikkelaars, startups en degenen die een geavanceerde AI-oplossing willen integreren in hun diensten. Om dit punt te illustreren, heb ik een verzameling applicaties samengesteld die gebruik maken van GPT-4 die je op je gemak kunt bekijken.

Hoewel ontwikkelaars kunnen experimenteren met PaLM 2 of deze kunnen overnemen, zal Google hard moeten werken om in dit opzicht te concurreren met OpenAI. Een voordeel van PaLM 2 ten opzichte van GPT-4 is de beschikbaarheid als open-source platform, wat zou kunnen leiden tot een bredere acceptatie in vergelijking met een propriëtaire betaalde API.

Alles bij elkaar genomen lijkt de door PaLM 2 aangedreven Bard op dit moment de betere keuze als het gaat om onderzoek, omdat hij beter is in het beantwoorden van vragen met relevante informatie en toegang heeft tot de nieuwste informatie op internet over een bepaald onderwerp. Volgens Bard’s laatste update , geleverd op 19 september 2023, gebruikt Bard nu zijn “meest capabele model tot nu toe” met ondersteuning voor nog eens 40 talen, diepgaande codeerhulp, de mogelijkheid om verschillende perspectieven op een bepaald onderwerp te presenteren en algemene kwaliteits- en nauwkeurigheidsverbeteringen.

Hoewel het mogelijk is om de antwoorden van Bard te vergelijken met externe zoekmachines zoals Google, loopt het systeem nog steeds achter op zijn concurrenten als het gaat om het snel genereren van antwoorden in vergelijking met het op GPT-4 gebaseerde ChatGPT of Microsofts Bing Chat.

Kan PaLM 2 GPT-4 aan?

PaLM 2 is een relatief recente ontwikkeling en moet nog bewijzen dat het de concurrentie met GPT-4 aankan. Toch zijn er, op basis van de ambitieuze plannen en sterke promotie-inspanningen van Google, aanwijzingen dat PaLM 2 een belangrijke uitdaging kan vormen voor GPT-4. Daarnaast is Google actief bezig met de ontwikkeling van een multimodaal AI-model met de naam Gemini, wat de druk op OpenAI nog verder opvoert.

GPT-4 blijft formidabel, maar PaLM 2 heeft een aanzienlijk voordeel door het gebruik van meerdere kleinere modellen. Met name de Gecko-component van PaLM 2 werkt opmerkelijk efficiënt en kan zelfs offline op mobiele apparaten worden gebruikt. Dankzij deze veelzijdigheid is PaLM 2 geschikt voor een breder scala aan apparaten en toepassingen die problemen kunnen ondervinden bij de toegang tot GPT-4.

De AI-race wordt steeds heviger

De onthulling van PaLM2 heeft de concurrentie onder ontwikkelaars van kunstmatige intelligentie verhevigd. Daarnaast bereidt Google naar verluidt een ander multimodaal AI-model voor met de naam Gemini, waarmee het zijn toewijding aan de vooruitgang van het vakgebied verder laat zien.