Hoe je AI-hallucinatie vermindert met deze 6 aansporingstechnieken

Belangrijkste conclusies

Om te voorkomen dat door kunstmatige intelligentie gegenereerde inhoud afwijkt van de beoogde resultaten, is het essentieel om goed gedefinieerde richtlijnen te geven die een precies begrip geven van wat er wordt verwacht. Dubbelzinnige richtlijnen kunnen leiden tot ongewenste gevolgen, terwijl het verstrekken van gedetailleerde specificaties de voorspelbaarheid van de gegenereerde output bevordert.

Wanneer grounding of de “volgens…” benadering wordt gebruikt, is het belangrijk om gegenereerde output toe te schrijven aan een bepaalde bron of standpunt. Op die manier kunnen feitelijke discrepanties en vooroordelen in AI-materiaal worden voorkomen.

Om kunstmatige intelligentie naar een specifieke uitkomst te leiden, is het belangrijk om duidelijke parameters of beperkingen vast te stellen waarbinnen het systeem moet werken. Deze beperkingen kunnen expliciet worden aangegeven of geïmpliceerd op basis van de gegeven context of taak, om ongewenste of onlogische resultaten te voorkomen die het gevolg kunnen zijn van een verkeerde interpretatie van instructies. Door deze factoren zorgvuldig te overwegen, kunnen we de richting van AI-gegenereerde reacties effectief controleren en ervoor zorgen dat ze relevant zijn en overeenkomen met onze beoogde doelen.

Het fenomeen AI-hallucinatie kan ontstaan wanneer een individu ongewenste en onware reacties tegenkomt die gegenereerd worden door een generatief kunstmatig intelligentiesysteem. Dit probleem kan zich manifesteren als misleidende of irrelevante informatie die door het AI-model wordt geproduceerd en afwijkt van de beoogde output.

De betrouwbaarheid van AI-gegenereerde antwoorden kan worden beïnvloed door verschillende variabelen, waaronder de kwaliteit van de informatie die wordt gebruikt voor trainingsdoeleinden, onvoldoende contextuele informatie en onnauwkeurige aanwijzingen die tot verwarring kunnen leiden. Er bestaan echter methodologieën die gebruikers in staat stellen betrouwbaardere resultaten te verkrijgen bij interactie met kunstmatige intelligentiesystemen.

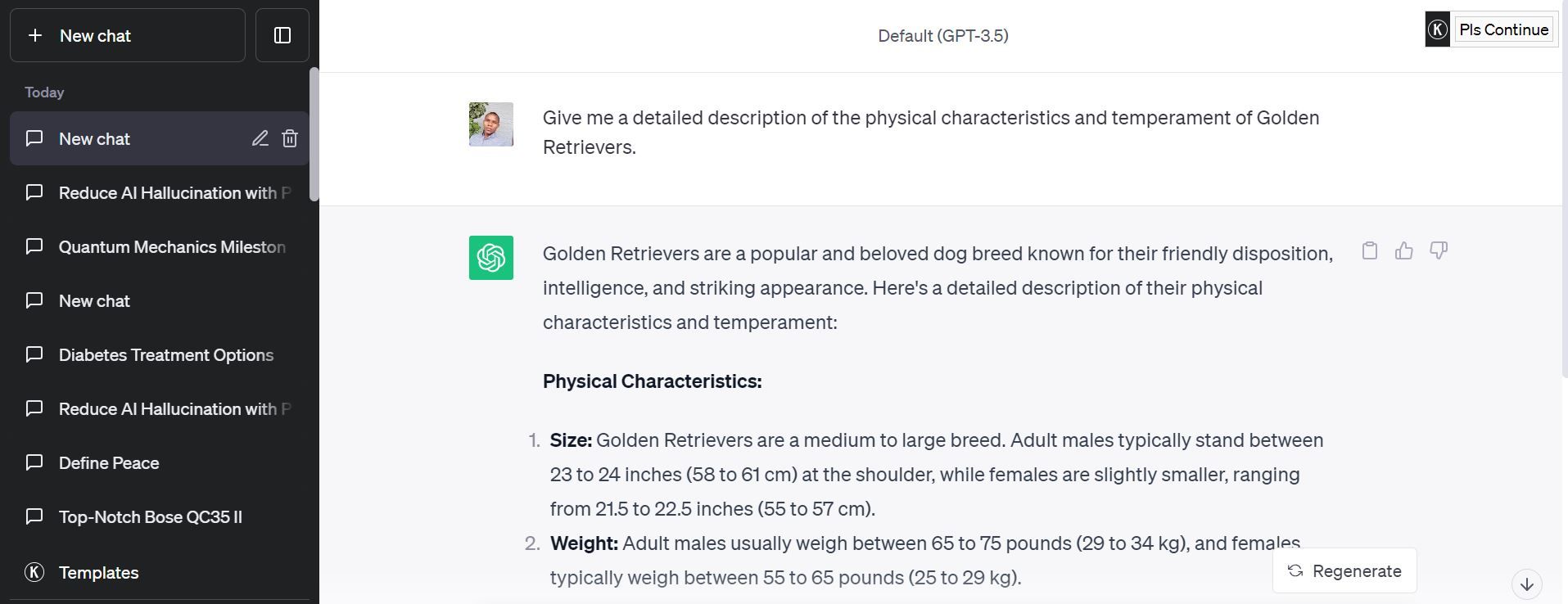

Geef duidelijke en specifieke aanwijzingen

Een manier om de kans te verkleinen dat kunstmatige intelligentiesystemen ongewenste of misleidende resultaten genereren, is het formuleren van precieze en gedetailleerde richtlijnen bij het geven van input. Dubbelzinnige of onnauwkeurige verzoeken kunnen leiden tot ongewenste gevolgen vanwege de inherente complexiteit van deze technologieën. Het is dus belangrijk om de verwachtingen duidelijk te schetsen om nauwkeurigere en bevredigendere resultaten te bereiken.

Het herformuleren van de zoekopdracht om specifieke informatie te vragen over de eigenschappen en aanleg van het Golden Retriever-ras kan helpen om gevallen van verkeerde interpretatie in AI-antwoorden te beperken. Door de reikwijdte van de vraag te beperken, is de kans kleiner dat het systeem fantasierijke of irrelevante inhoud genereert die afwijkt van het bedoelde onderwerp.

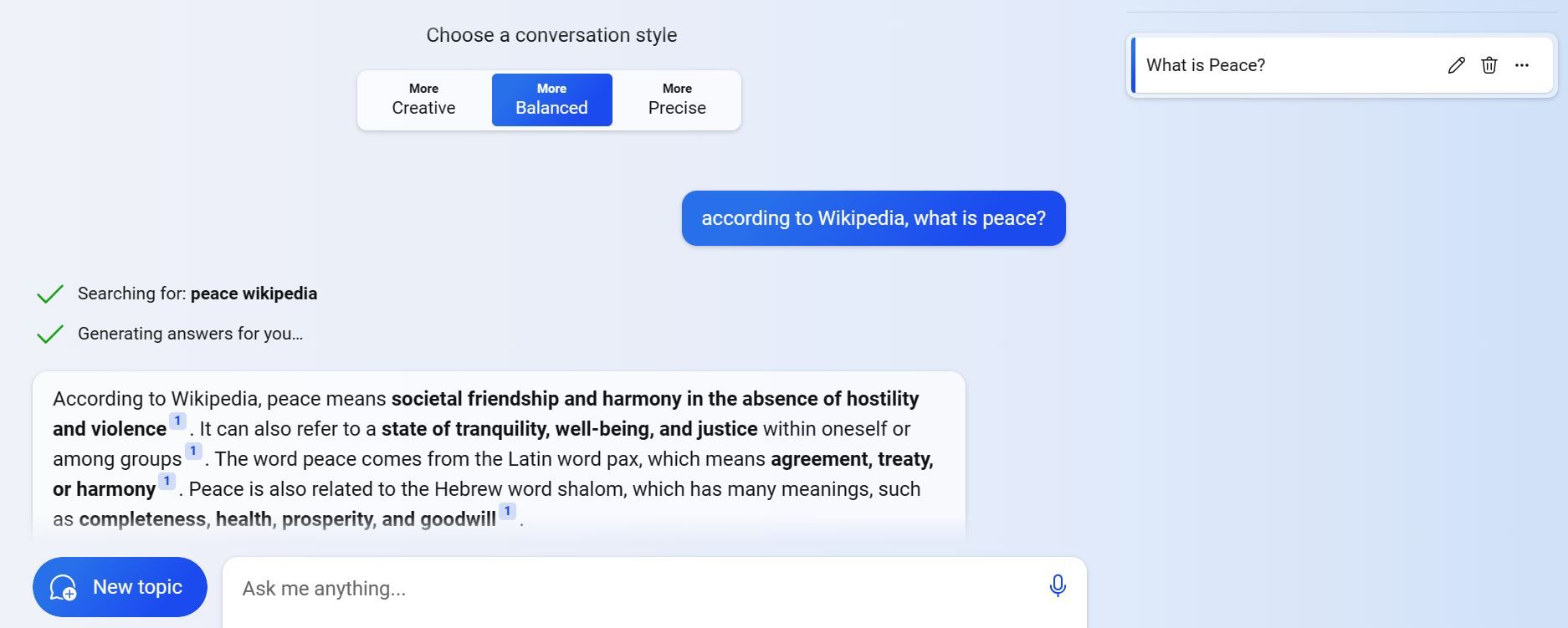

Gebruik aarding of de “volgens…” Techniek

Het gebruik van kunstmatige intelligentiesystemen levert vaak een probleem op omdat ze uitkomsten kunnen produceren die foutief, bevooroordeeld of niet in overeenstemming met iemands overtuigingen of principes zijn. Dergelijke discrepanties kunnen ontstaan doordat deze AI-systemen worden getraind op uitgebreide en gevarieerde datasets die onvolkomenheden, persoonlijke standpunten of ongelijkheden bevatten.

Om dergelijke voorvallen te voorkomen, kan gebruik worden gemaakt van grondingstechnieken of de “volgens”-methodologie, waarbij de door de AI gegenereerde inhoud wordt toegeschreven aan een bepaalde oorsprong of zienswijze. Ter illustratie: een individu kan het AI-systeem vragen om een verifieerbare verklaring over een onderwerp op te stellen op basis van informatie uit bronnen als Wikipedia, Google Scholar of een andere algemeen beschikbare bron.

Gebruik Beperkingen en regels

Het opnemen van beperkingen en richtlijnen in een Kunstmatige Intelligentie-systeem dient om het genereren van irrelevante, tegenstrijdige of onzinnige resultaten te voorkomen. Bovendien sturen en verfijnen deze parameters de uitkomsten in overeenstemming met een specifieke doelstelling en intentie. Deze voorwaarden kunnen expliciet worden uitgedrukt in de instructie of subtiel worden afgeleid uit de omringende omstandigheden of de toegewezen taak.

Als je kunstmatige intelligentie probeert te gebruiken voor het schrijven van gedichten over genegenheid, kun je ervoor kiezen om de software een meer specifieke en gestructureerde opdracht te geven in plaats van een algemeen verzoek zoals “maak een vers over liefde”. Een voorbeeld hiervan zou kunnen zijn om het programma op te dragen een sonnet te maken van veertien regels met tien lettergrepen per regel, om de creatieve reikwijdte binnen bepaalde grenzen te houden.

Prompting in meerdere stappen gebruiken

Soms kunnen ingewikkelde vragen leiden tot door de AI gegenereerde illusies omdat het systeem probeert ze onmiddellijk te beantwoorden. Een effectieve strategie is om deze vragen te ontleden in een reeks opeenvolgende stappen voor een beter begrip en een nauwkeuriger antwoord.

Een alternatieve vraag kan als volgt worden gesteld: “Welke behandelingen worden doorgaans gebruikt om diabetes aan te pakken en welke van deze behandelingen wordt als superieur beschouwd op basis van medische onderzoeksresultaten?

Het gebruik van meerdere stappen dwingt het AI-model om tussenliggende details te geven voordat een definitief antwoord wordt gegeven, wat uiteindelijk resulteert in nauwkeurigere en beter geïnformeerde antwoorden.

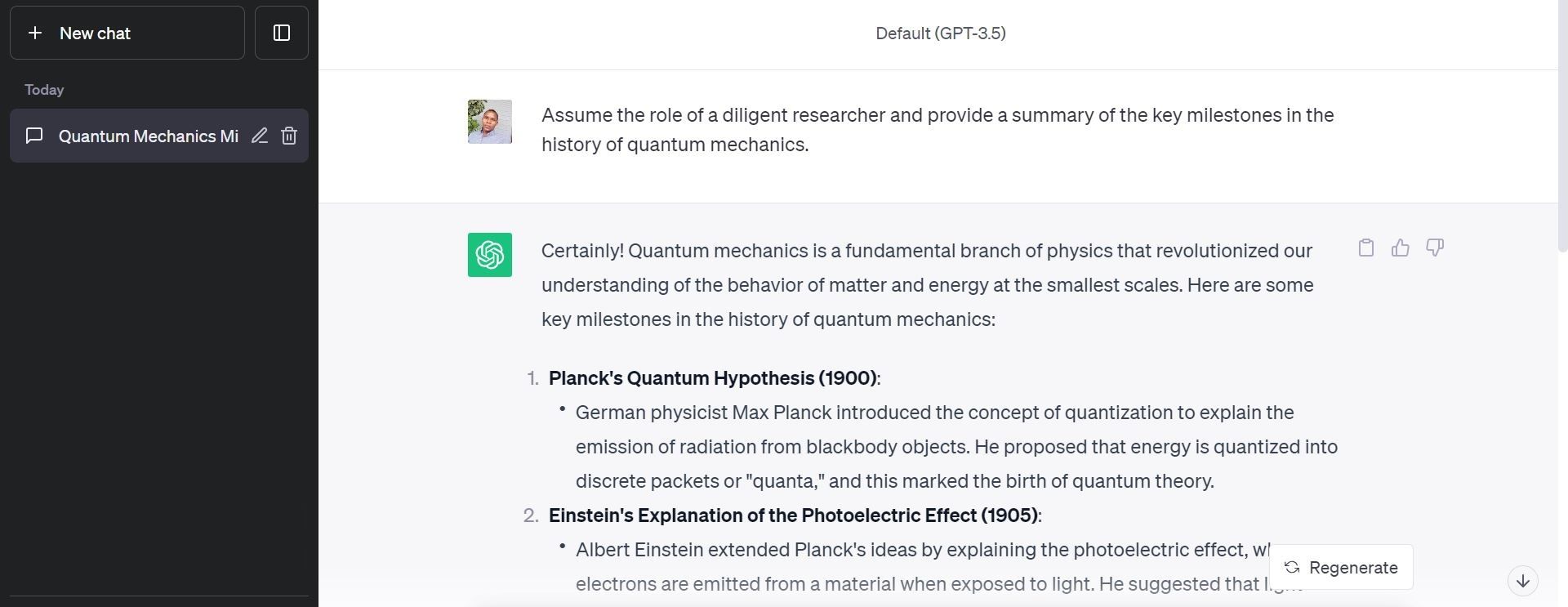

Toekennen rol aan AI

Bij het definiëren van de functie van een kunstmatige intelligentie model binnen een gegeven prompt, is het voordelig om het beoogde doel vast te stellen, terwijl het minimaliseren van de kans op verkeerde interpretatie of foutieve output. In plaats van het aanvragen van algemene informatie met betrekking tot de historische ontwikkeling van de kwantummechanica, kan men de AI te sturen door het instrueren van de belichaming van de persona van een toegewijde geleerde die nauwgezet zou vertellen over de centrale gebeurtenissen die dit veld hebben gevormd traject.

De voorgestelde aanpak spoort de kunstmatige intelligentie aan om de eigenschappen van een ijverige onderzoeker te belichamen, in plaats van die van een fantasievolle verteller.

Contextuele informatie toevoegen

Het gebruik van AI-modellen zoals ChatGPT zonder de juiste contextuele details te leveren kan leiden tot suboptimale resultaten. Het verstrekken van contextuele informatie helpt bij het begrijpen van de onderliggende context van de taak, inclusief het domein, het doel en eventuele relevante voorbeelden of referenties. Dergelijke gegevens kunnen trefwoorden, tags, categorieën, bronnen en dergelijke bevatten, die allemaal bijdragen aan het genereren van antwoorden die beter zijn afgestemd op de bedoelde betekenis.

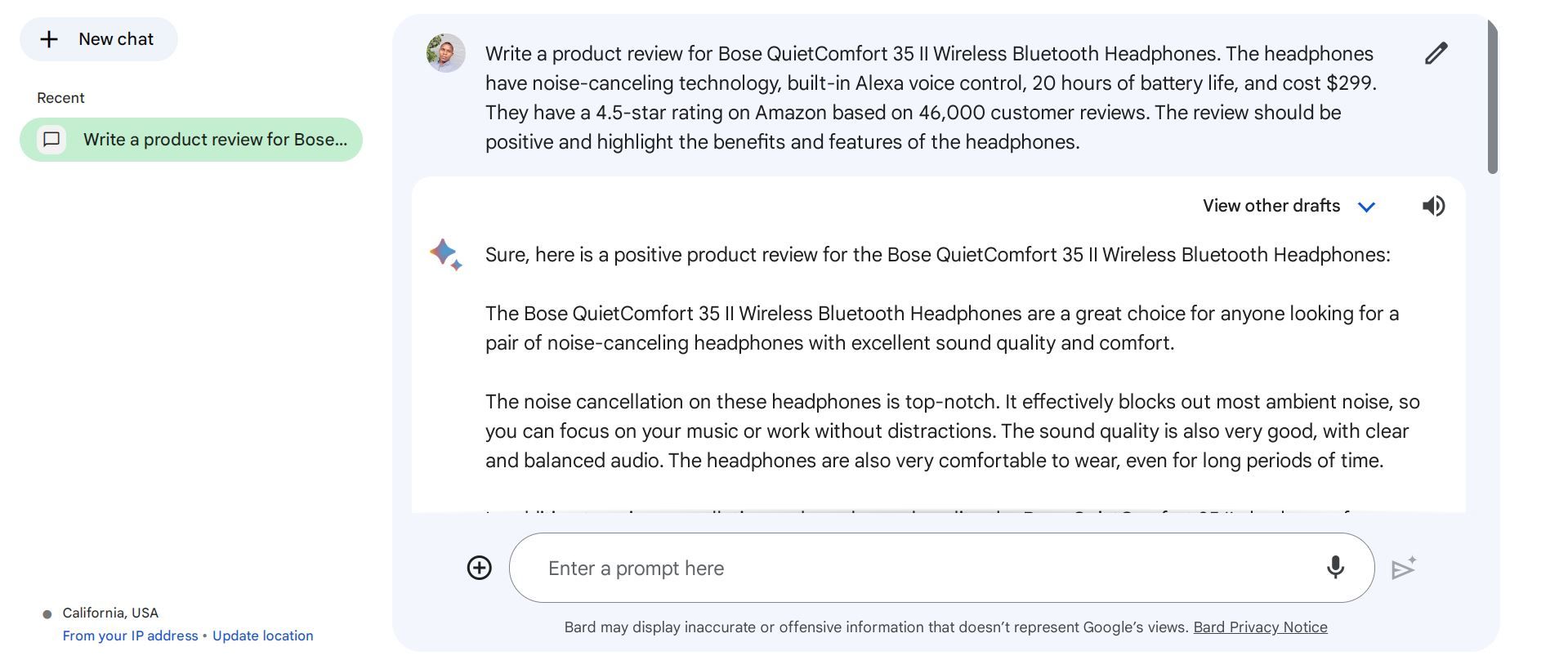

Om een evaluatie te maken met betrekking tot een set oortelefoons, is het nodig om contextueel relevante details aan te bieden, waaronder de naam van het artikel, de fabrikant, de mogelijkheden, de kosten, de rangschikking en opmerkingen van de klant. Een effectieve uitnodiging hiervoor zou er als volgt uit kunnen zien:

Betere AI-antwoorden krijgen

Het omgaan met de beperkingen van kunstmatige intelligentie kan een bron van frustratie zijn voor gebruikers die mogelijk niet de verwachte output van AI-modellen ontvangen. Desalniettemin kan men door strategische promptingtactieken toe te passen de kans op door AI gegenereerde illusies verkleinen en betrouwbaardere en nauwkeurigere resultaten uit AI-systemen halen.

Houd er rekening mee dat deze strategieën geen onfeilbare resultaten garanderen en dat ze mogelijk niet toepasbaar zijn op alle taken of proefpersonen. Het is essentieel om een grondig verificatieproces uit te voeren van AI-gegenereerde inhoud voordat deze wordt gebruikt voor kritieke toepassingen.