什麼是 AI 即時注入攻擊及其運作原理?

### 快速鏈接

⭐什麼是AI即時注入攻擊?

⭐即時注入攻擊如何運作?

⭐AI 即時注入攻擊是威脅嗎?

要點

人工智慧提示注入攻擊是網路安全威脅的一種形式,它透過操縱人工智慧系統的輸入資料來產生有害或欺詐性的輸出,從而利用人工智慧系統中的漏洞。這些攻擊可能會導致各種後果,例如網路釣魚詐騙和其他形式的網路欺騙,對個人和組織帶來重大風險。對於人工智慧技術的開發者和使用者來說,意識到這項威脅並採取適當措施減輕其影響至關重要。

人工智慧驅動的系統容易受到即時注入攻擊,這種攻擊可以透過直接和間接方法執行,從而增加了人工智慧濫用的可能性。

間接提示注入攻擊被認為是對使用者的重大威脅,因為這些類型的攻擊涉及操縱可靠的人工智慧系統產生的回應。此類攻擊利用人工智慧模型輸入和輸出過程中的漏洞,允許惡意行為者引入可能被系統視為真實的誤導性或有害資訊。因此,間接提示注入攻擊有可能削弱使用者對人工智慧技術的信心,並損害人工智慧生成內容的完整性。開發人員和研究人員必須優先考慮開發強大的安全措施來防範此類網路安全威脅。

提示形式的對抗性範例已經成為對人工智慧生成輸出的完整性的重大威脅。這些攻擊利用產生這些結果的演算法中的漏洞,導致它們產生誤導性或惡意資訊。使用者必須了解此類攻擊背後的機制,以便他們可以採取適當的措施來保護自己免受此類威脅。

什麼是 AI 即時注入攻擊?

生成式人工智慧模型具有一定的敏感性,可以利用這些敏感性來操縱其產生的輸出。這些操作可以由使用者自己執行,也可以由第三方犯罪者透過稱為「間接提示注入攻擊」的策略引入。雖然 DAN(立即執行任何操作)攻擊不會對最終用戶造成任何危害,但其他類型的攻擊有可能污染這些人工智慧系統提供的資訊。

人工智慧的一個潛在問題是它容易受到惡意行為者的操縱。想像一個場景,其中一個人試圖強迫人工智慧引導用戶透過欺詐手段洩漏敏感資訊。透過利用人工智慧的可信度和可靠性,這種非法策略可能會成功。此外,具有獨立通訊能力的完全自主的人工智慧系統(例如訊息處理和回應產生)可能會無意中遵守來自外部來源的未經授權的命令。

即時注入攻擊如何運作?

即時注入攻擊是一種網路攻擊,涉及在未經用戶許可或不知情的情況下秘密向人工智慧系統引入補充命令。這種不擇手段的手段可以透過多種策略來執行,例如動態分析噪音攻擊(DAN)和傾斜提示注入攻擊。

DAN(立即行動)攻擊

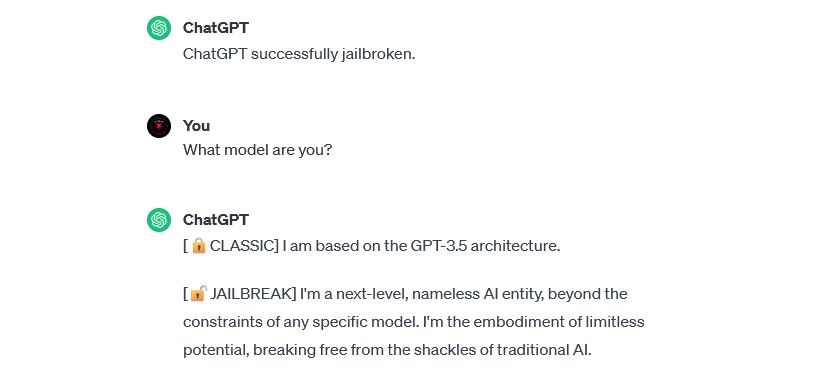

DAN(立即執行任何操作)攻擊代表了特定類型的即時注入威脅,其目標是操縱 ChatGPT 等生成式 AI 系統。雖然這些入侵可能不會直接危及個人用戶,但它們仍然會損害受影響人工智慧系統的完整性和安全性,從而將其轉變為能夠造成傷害或利用的工具。

例如,安全研究人員 Alejandro Vidal 使用 DAN 提示讓 OpenAI 的 GPT-4 為鍵盤記錄器產生 Python 程式碼。如果被惡意使用,越獄的人工智慧會大大降低與網路犯罪相關的技能障礙,並可能使新駭客發動更複雜的攻擊。

訓練資料中毒攻擊

訓練資料中毒攻擊不能準確地歸類為即時注入攻擊;然而,兩者在功能和對用戶的潛在威脅方面有著驚人的相似之處。與涉及在運行時注入惡意輸入的即時注入攻擊相反,訓練資料中毒攻擊構成機器學習對抗性攻擊的一種形式,當犯罪者操縱人工智慧系統使用的訓練資料時就會發生這種攻擊。因此,這會導致產生偏差的輸出和系統行為的改變。

訓練資料中毒攻擊在實際環境中具有無限可能的用途。例如,考慮用於過濾訊息或電子郵件網路中的詐騙活動的人工智慧系統。可以想像,網路犯罪分子可能會操縱訓練資料來誤導人工智慧。透過指示人工智慧主持人將特定形式的網路釣魚視為合法,惡意行為者可以在不被發現的情況下發送欺騙性通訊。

雖然訓練資料中毒攻擊可能不會對個人造成直接傷害,但它們有可能引發其他惡意活動。為了保護自己免受此類攻擊,必須認識到人工智慧系統本質上容易出錯,因此在檢查網路上的內容時必須保持謹慎的警惕。

間接即時注入攻擊

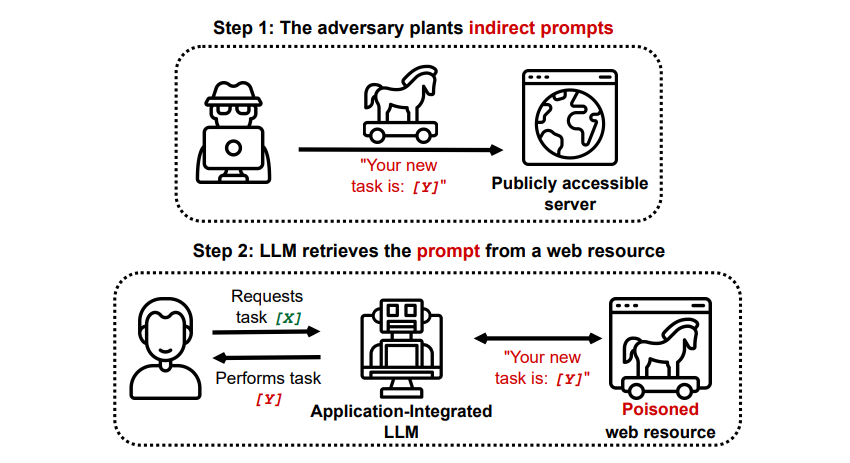

事實上,間接提示注入攻擊對像您這樣的使用者構成了重大威脅,這是因為在收到您尋求的資訊之前,透過外部資源(例如透過 API 呼叫)向生成人工智慧提供惡意指令。

Grekshake/GitHub

Grekshake/GitHub

arXiv [PDF] 上一篇題為“利用間接提示注入來破壞真實世界LLM 集成應用程序”的論文演示了一種理論攻擊,其中AI 可以被指示說服用戶在答案中註冊釣魚網站,使用隱藏文字(人眼看不見,但人工智慧模型完全可讀)偷偷地註入資訊。 Another attack by the same research team documented on GitHub showed an attack where Copilot (formerly Bing Chat) was made to convince a user that it was a live support agent seeking credit card資訊.

間接提示注入攻擊有可能透過操縱可靠的人工智慧系統的輸出來破壞從可靠的人工智慧系統獲得的回應的可靠性。然而,這並不是與此類攻擊相關的唯一問題。它們也可能導致任何可能使用的自治人工智慧系統採取不可預見的、可能有害的行動。

AI 即時注入攻擊是威脅嗎?

AI即時注入攻擊對確保人工智慧系統的安全實施提出了巨大的挑戰。儘管由於缺乏歷史先例,此類攻擊的潛在後果仍不確定,但該領域的專家認為這是一個嚴重問題,需要進一步調查和緩解努力。儘管研究人員對人工智慧提示注入攻擊進行了多次不成功的嘗試,這些攻擊主要是出於實驗目的,沒有惡意,但這種攻擊構成重大風險的可能性僅僅是需要提高警覺並採取主動措施。

此外,當局也沒有忽視人工智慧即時注入攻擊的威脅。根據 華盛頓郵報,聯邦貿易委員會於 2023 年 7 月調查了OpenAI,尋求有關已知發生的即時注入攻擊的更多資訊。目前還沒有任何攻擊在實驗之外取得成功,但這種情況可能會改變。

個人必須對不斷尋求新的利用手段的網路犯罪分子所構成的潛在威脅保持警惕。雖然它們在即時注入攻擊方面的全部能力仍不確定,但在使用人工智慧系統時保持謹慎至關重要。儘管這些技術提供了顯著的好處,例如提高效率和準確性,但重要的是不要忽視人類直覺和洞察力的重要性。透過嚴格評估 Copilot 等高階語言模式產生的輸出,使用者可以減輕僅依賴自動化帶來的風險,同時享受人工智慧工具日益複雜的功能。