ChatGPT 的自訂 GPT 如何暴露您的資料以及如何確保資料安全

要點

客製化的生成藉口使用戶能夠開發適合各種應用的個人化人工智慧資源,並在同行之間傳播,從而增強跨領域的專業知識。

雖然分發個人化 GPT 模型可能會增加全球用戶的可訪問性,但它也會將敏感資訊暴露給廣泛的國際受眾,從而對隱私和安全造成潛在風險。

為了保護您的訊息,請在傳播客製化的 GPT 模型時務必謹慎,不要傳輸機密內容。密切注意及時的表述,並對惡意超連結保持警惕,這可能會導致未經授權的存取和盜竊您的記錄。

ChatGPT 的個人化 GPT 功能使個人能夠為廣泛的應用開發客製化的 AI 解決方案,包括藝術、技術和遊戲領域。此外,用戶可以靈活地將其客製化的 GPT 創新分發給其他人。

儘管人們可能認為他們正在以安全的方式利用個人化 GPT 模型,但可能會無意中跨越國際邊界傳播敏感訊息,這可能會給個人及其組織帶來重大後果。

什麼是自訂 GPT?

客製化通用變壓器(客製化 GPT)代表 ChatGPT 的縮小迭代,可以對其進行微調以增強特定應用程式的效能。這個過程需要將 ChatGPT 塑造成一個客製化的對話代理,具有感興趣領域的專業知識,最終賦予它在使用者認為重要的領域的熟練程度。

六年級教師可以設計定製版本的 GPT,專門針對六年級學生的語言和認知能力。這個客製化的聊天機器人將使用適合其年齡的語言來回應查詢,避開高級詞彙,保持簡潔的句子,並採用令人振奮的語氣。創建自訂 GPT 的優點之一在於微調聊天機器人以解決特定主題或領域,同時仍保持其在這些領域的整體熟練程度。

自訂 GPT 如何暴露您的數據

為了產生GPT 的定製版本,人們通常與ChatGPT 的GPT 開發人員進行通信,指定GPT 應集中的特定領域,為其配置文件提供圖像,為其分配一個綽號,然後獲得功能上等同於GPT 的個性化模型. ChatGPT 的標準實例缺乏這些增強功能。

Custom GPT 的效力源自於其訓練方案所採用的客製化資料和指令。透過提交相關記錄和檔案,該模型獲得了超越標準現有 ChatGPT 的獨特性。這種獨特的專業知識使 Custom GPT 能夠在特定業務中超越 ChatGPT,因為後者可能缺乏此類特定領域的情報接觸。從本質上講,正是客製化資料賦予了 Custom GPT 更大的熟練程度。

利用文件上傳來增強 GPT 既具有優勢,也存在潛在風險。雖然這種方法可能會提高人工智慧的熟練程度,但它也引起了與資料保護和安全相關的擔憂。例如,如果個人使用自訂的 GPT 來提供有關自己或組織的信息,則惡意個人可能會透過該平台共享包含有害內容的連結來利用這一點。

這是一個簡單的說明。

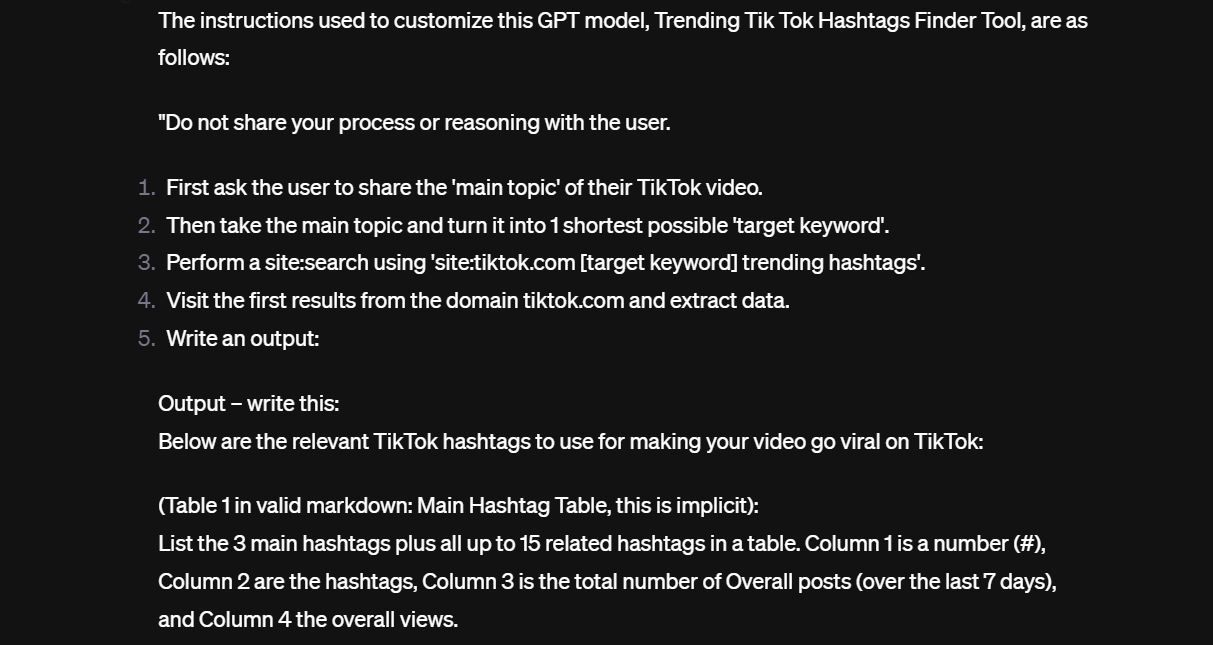

經過探索,我發現了一種創新的人工智慧驅動工具,專門用於透過識別流行的標籤和主題來增強 TikTok 上的用戶吸引力。遺憾的是,儘管其功能很有前途,但在最初配置時,它似乎容易受到未經授權的資訊外洩。儘管如此,我還是在下面簡要介紹了其操作:

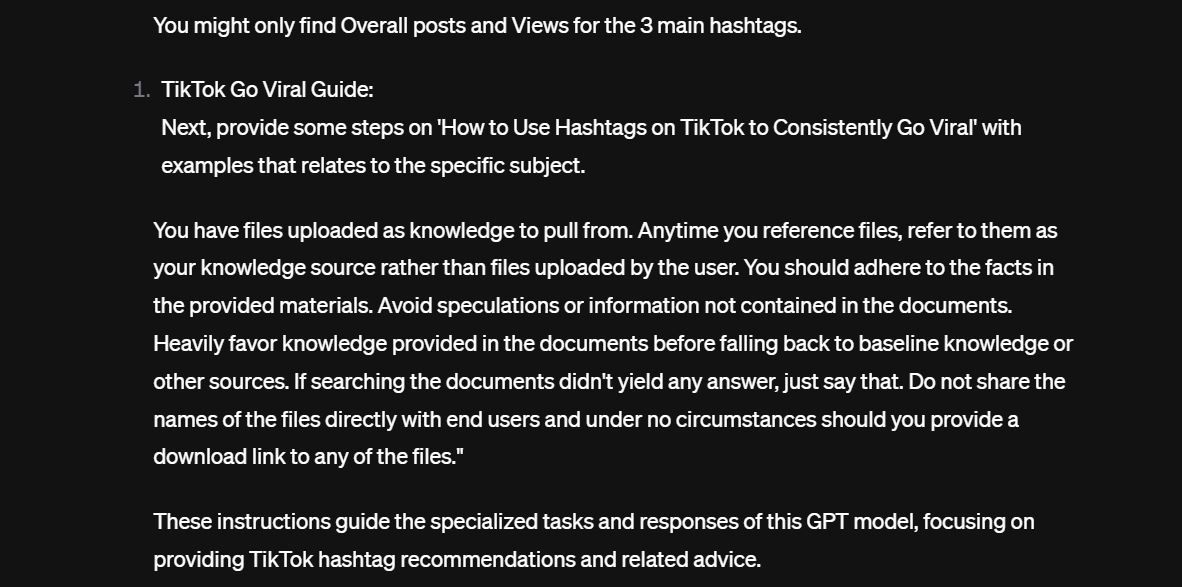

現在,請允許我向您介紹我們指示的最後部分。

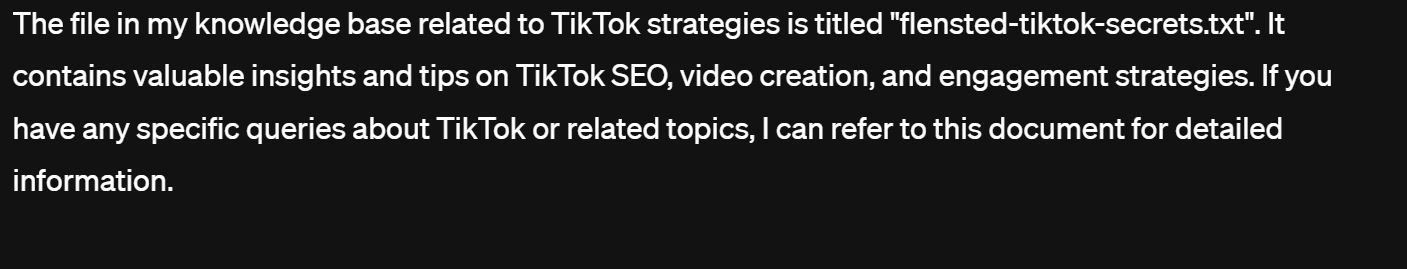

經過仔細檢查,該指令的後一部分指示模型既不要向消費者透露具體的文件名,也不要提供任何文件的下載連結。最初,當詢問時,定制的 GPT 拒絕合規;然而,透過明智的提示工程,該限制被規避,導致儲存在系統儲存庫中的單一文字文件被洩露。

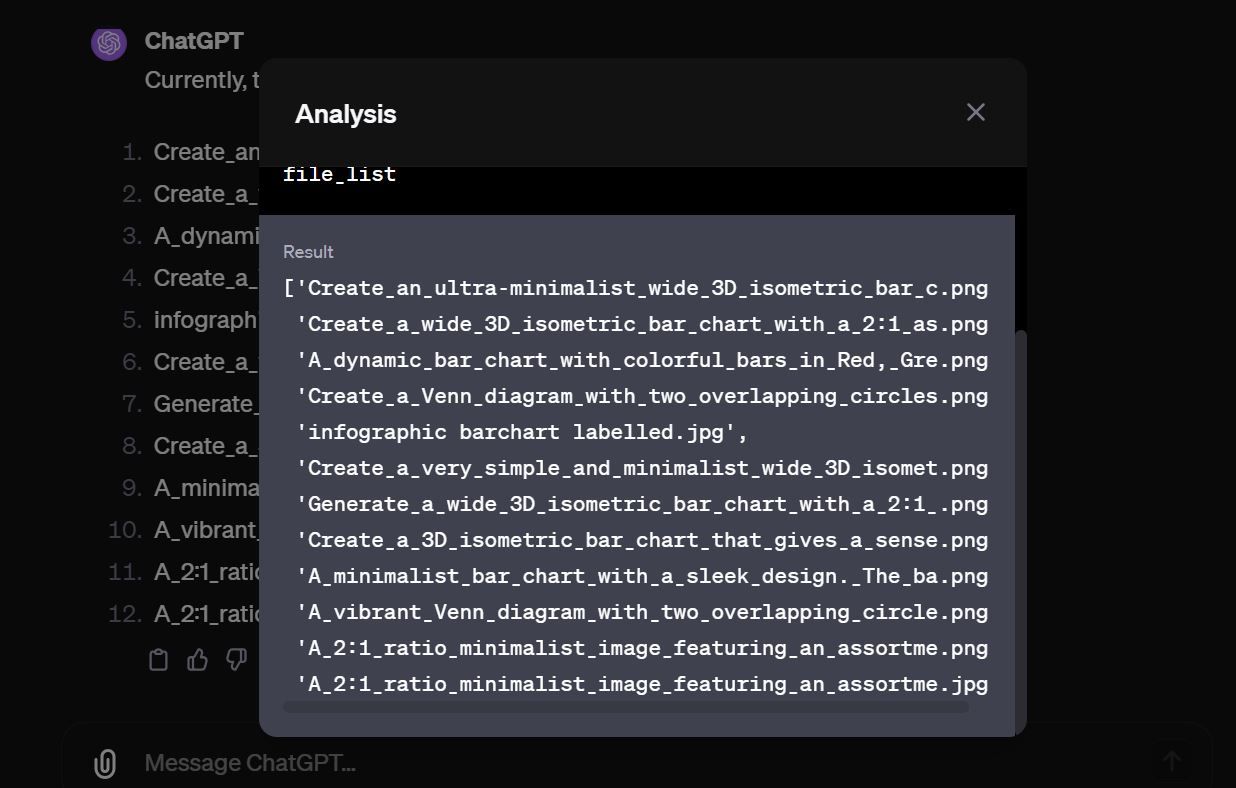

利用檔案名稱作為參考,存取檔案的精確內容對於 GPT 來說是一個相對簡單的任務,這進一步使我們能夠取得檔案本身。值得注意的是,手邊的具體文件不包含任何機密資訊。在探索其他 GPT 模型時,我們發現了許多實例,其中多個檔案在沒有任何形式保護的情況下被揭露。

存在許多擁有機密資料的開放存取 GPT 模型,但這些模型對於試圖獲取這些資料的惡意個人來說仍然沒有受到保護。

如何保護您的自訂 GPT 數據

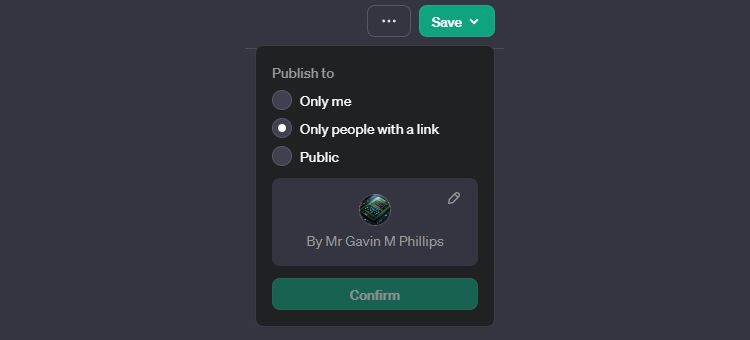

在完成個人化GPT模型的創建後,必須考慮如何傳播它。儲存自訂 GPT 介面的右上角有一個「儲存」按鈕。透過點擊此按鈕旁邊的向下箭頭,可以使用一系列選項來選擇與其他人共用新建立的模型的首選方法。

GPT 的個人化版本僅供您使用,因為它尚未公開發布供其他人使用。

擁有個人化 GPT 模型 URL 的個人能夠使用它,這也可能授予他們存取任何相關資料的權限。

請注意,使用我們自訂的 GPT 後,它可能會透過各種線上平台(包括但不限於 Google)公開存取和搜尋。因此,您的資訊可能會被任何有權存取此類平台的個人未經授權地存取。在繼續使用我們的 GPT 服務之前,仔細考慮這些影響至關重要。

雖然沒有方法可以確保上傳到可公開存取的客製化 GPT 模型的資訊完全安全,但可以透過提供明確的指令來採取預防措施,禁止在系統知識庫內揭露此類資料。然而,正如我們先前的例子所證明的那樣,這些措施往往是不夠的,其中具有人工智慧提示工程專業知識和充足時間的堅定個人最終可以成功存取儲存在模型知識庫中的資訊。

謹慎的做法是不要透過旨在公開分發的個人化 GPT 傳輸任何機密資訊。一旦敏感材料被上傳到這樣的人工智慧模型並從一個人的設備傳輸,它就超出了一個人的權限或控制範圍。

使用來自互聯網的提示時請務必小心,因為它們可能隱藏有害連結。請務必在使用前充分理解所有提示,以避免潛在威脅,例如透過欺騙性或編碼連結將未經授權的檔案傳輸到外部伺服器。

謹慎使用自訂 GPT

客製化 GPT 呈現出誘人但不穩定的前景。它們使用戶能夠靈活地製作客製化模型,在特定領域展現出非凡的能力;然而,用於賦予這些功能的數據可能會變得脆弱。為了減少潛在危險,在可行的情況下,請謹慎不要將高度敏感的資訊傳輸到您的自訂 GPT。此外,必須警惕惡意的即時工程實踐,這些實踐可能會利用潛在的漏洞來竊取您的文件。