Meta는 오픈 소스 대규모 언어 모델(LLM)인 Llama 2를 만들었습니다. 이 특정 LLM은 성능 면에서 GPT-3.5 및 PaLM과 같은 특정 폐쇄형 모델을 능가한다는 의견도 있을 정도로 뛰어난 성능을 갖춘 것으로 평가받고 있습니다. 사전 학습되고 미세 조정된 세 가지 생성 텍스트 모델로 구성된 Llama 2에는 70억, 130억, 700억 개의 파라미터 구성을 위한 옵션이 포함되어 있습니다.

스트림릿과 라마 2를 활용하여 챗봇을 구축하여 라마 2의 대화형 기능에 대해 알아보세요.

라마 2 이해하기: 기능 및 장점

대규모 언어 모델로서의 기능 측면에서 라마 2와 이전 버전인 라마 1의 중요한 차이점은 무엇일까요?

이 모델의 확장된 아키텍처는 340억 개에서 무려 700억 개에 이르는 엄청난 수의 파라미터를 수용합니다. 이러한 전례 없는 규모 덕분에 이 모델은 소규모 모델에서는 식별할 수 없는 언어 요소 간의 매우 복잡한 상호 관계를 식별할 수 있습니다.

인간 피드백을 통한 강화 학습(RLHF)은 대화형 애플리케이션의 성능을 향상시켜 복잡한 대화 중에도 자연스럽고 일관된 응답을 생성할 수 있도록 개선된 것으로 나타났습니다.

“그룹화된 쿼리 주의”라는 새로운 방법의 도입으로 추론 프로세스가 가속화되어 챗봇 및 가상 비서와 같은 보다 실용적인 애플리케이션을 개발할 수 있게 되었습니다.

현재 모델은 이전 버전에 비해 메모리 사용량과 계산 리소스 측면에서 효율성이 향상되어 특정 작업에 더욱 효과적인 도구가 되었습니다.

라마 2는 오픈 소스 및 비상업적 라이선스를 채택하여 연구자 및 개발자가 아무런 제약 없이 소스 코드를 활용하고 변경할 수 있습니다.

Llama 2의 발전으로 모든 영역에서 뛰어난 성능을 발휘하여 챗봇 개발, 가상 비서 구현, 자연어 이해 등 다양한 목적에 탁월한 리소스로 자리매김하고 있습니다.

챗봇 개발을 위한 원활한 환경 구축

애플리케이션 구축을 시작하기 위해서는 현재 프로젝트와 시스템의 기존 프로젝트를 분리할 수 있는 개발 환경을 구축하는 것이 필수적입니다.

먼저 Pipenv 라이브러리를 활용하여 가상 환경을 설정하는 방법은 다음과 같습니다:

pipenv shell

대화형 에이전트를 구축하기 위해서는 필수 소프트웨어 패키지와 프레임워크를 배포하는 것이 필수적입니다.

pipenv install streamlit replicate

Streamlit은 머신러닝 및 데이터 과학 프로젝트의 개발을 가속화하기 위한 대화형 웹 애플리케이션을 생성하도록 설계된 다목적 오픈 소스 플랫폼입니다.

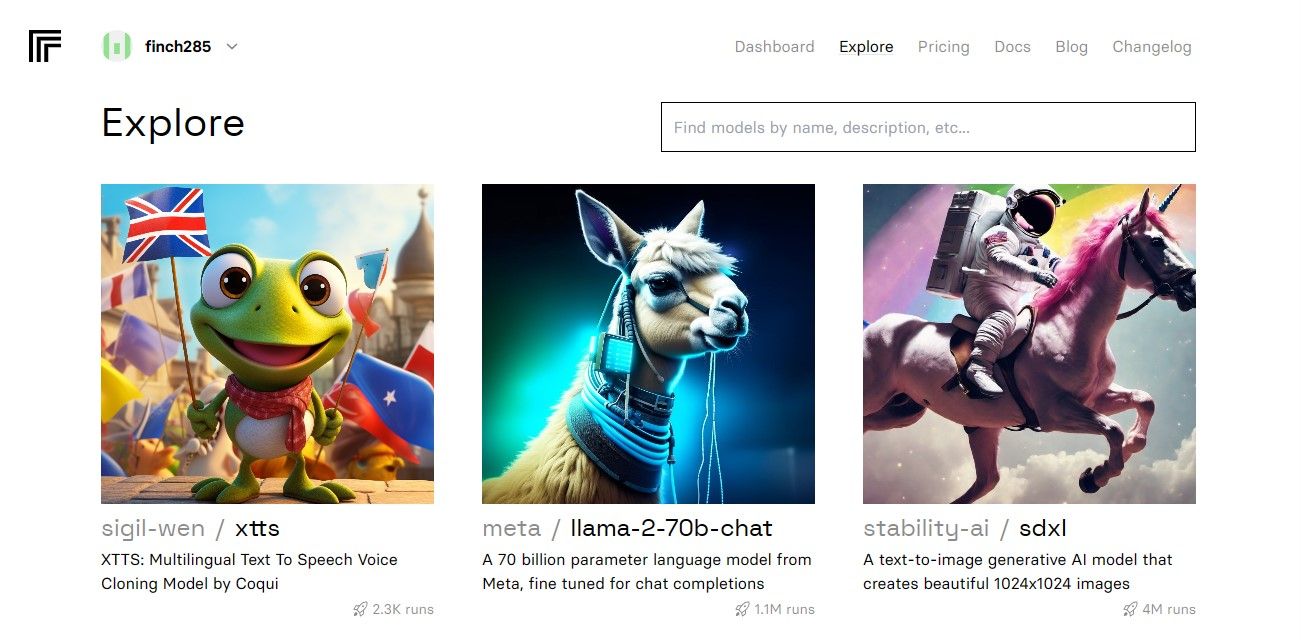

광범위한 오픈 소스 머신 러닝 모델에 쉽게 액세스할 수 있는 클라우드 기반 플랫폼으로, 다양한 애플리케이션에서 구현 및 활용이 가능합니다.

복제본에서 라마 2 API 토큰 받기

복제본 토큰 키를 받으려면 먼저 GitHub 계정을 사용하여 복제본 에 계정을 등록해야 합니다.

복제 GitHub 계정 을 통해서만 로그인할 수 있습니다.

제어판에 들어가면 ‘탐색’ 탭으로 이동하여 검색창에 이름을 입력하여 Llama 2 챗봇에 대한 쿼리를 실행합니다. 그러면 지정된 범위 내에서 Llama 2 모델의 성능을 확인할 수 있습니다.

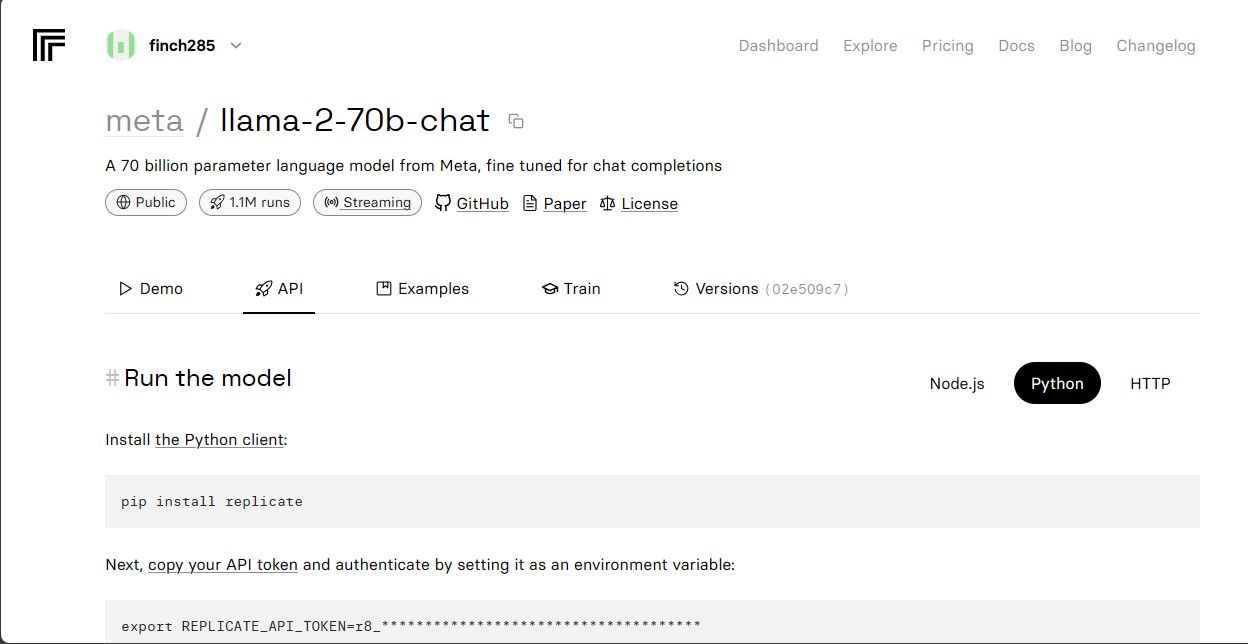

챗봇 모델의 인터페이스에서 해당 링크를 클릭하여 Llama 2 API 엔드포인트로 이동하세요. 탐색 바에서 원하는 챗봇 모델과 연결된 “API” 버튼을 찾습니다. 버튼을 클릭한 후 페이지의 오른쪽에서 Python 버튼을 찾을 수 있습니다. 이 옵션을 선택하면 Python 애플리케이션 내에서 Llama 2 API를 활용하는 데 필요한 API 토큰에 액세스할 수 있습니다.

향후 잠재적인 애플리케이션을 위해 복제된 API 토큰을 예방 조치로 안전하게 보존하세요.

전체 코드베이스는 개발자가 필요에 따라 참조하고 활용할 수 있는 광범위한 리소스 모음을 제공하는 앞서 언급한 GitHub 리포지토리를 통해 액세스할 수 있습니다.

챗봇 구축하기

먼저 “.env”로 표시된 환경 구성 파일과 함께 “llama\_chatbot.py”라는 제목의 Python 스크립트를 설정합니다. 전자의 경우, 민감한 비밀과 API 토큰을 후자 안에 안전하게 보관하면서 코드를 작성해야 합니다.

`llama_chatbot.py` 스크립트에서 다양한 기능을 활용하기 위해서는 특정 구문을 사용하여 특정 라이브러리를 가져와야 합니다. 이 프로젝트에 필요한 라이브러리는 `nltk`, `tensorflow`, `torch`입니다. 이러한 라이브러리는 다른 관련 가져오기를 수행한 후 스크립트 시작 부분에 가져와야 합니다.

import streamlit as st

import os

import replicate

다음으로, Llama-2 – 70b-Chat 모델에 대한 전역 파라미터를 설정합니다.

# Global variables

REPLICATE_API_TOKEN = os.environ.get('REPLICATE_API_TOKEN', default='')

# Define model endpoints as independent variables

LLaMA2_7B_ENDPOINT = os.environ.get('MODEL_ENDPOINT7B', default='')

LLaMA2_13B_ENDPOINT = os.environ.get('MODEL_ENDPOINT13B', default='')

LLaMA2_70B_ENDPOINT = os.environ.get('MODEL_ENDPOINT70B', default='')

복제 목적으로 필요한 토큰과 모델 엔드포인트를 활용하려면 다음과 같이 특정 형식으로 포함시켜 ‘.env’ 파일을 업데이트해야 합니다:

REPLICATE_API_TOKEN='Paste_Your_Replicate_Token'

MODEL_ENDPOINT7B='a16z-infra/llama7b-v2-chat:4f0a4744c7295c024a1de15e1a63c880d3da035fa1f49bfd344fe076074c8eea'

MODEL_ENDPOINT13B='a16z-infra/llama13b-v2-chat:df7690f1994d94e96ad9d568eac121aecf50684a0b0963b25a41cc9e5'

MODEL_ENDPOINT70B='replicate/llama70b-v2-chat:e951f0b00860fc4ea62b3b16fac280f83ff32282f87bbd2e48'

복제 토큰을 만들려면 먼저 제공된 필드에 토큰을 붙여넣어야 합니다. 그런 다음 이 정보가 포함된 .env 파일을 저장하려면 ‘저장’을 클릭하기만 하면 됩니다. 이 과정을 통해 필요할 때마다 리플리케이트 토큰에 쉽게 액세스할 수 있습니다.

챗봇의 대화 흐름 설계하기

라마 2 언어 모델을 어시스턴트로 활용하려면 특정 지원 요구 사항에 맞는 사용자 지정 프롬프트를 구성하여 프로세스를 시작하세요. 여기에는 재정 조언이나 요리 지침과 같이 모델이 안내를 제공하고자 하는 전문 분야와 관련된 질문이나 문장을 작성하는 것이 포함될 수 있습니다. 초기 프롬프트가 설정되면 Llama 2 모델과 상호 작용하고 추가 질문이나 정보 요청을 통해 통찰력을 이끌어낼 수 있습니다.

# Set Pre-propmt

PRE_PROMPT = "You are a helpful assistant. You do not respond as " \

"'User' or pretend to be 'User'." \

" You only respond once as Assistant."

챗봇의 설정을 구성하려면 다음 단계를 따르세요: 1. 먼저 드롭다운 메뉴에서 옵션을 선택하거나 특정 코드를 입력하여 챗봇의 인터페이스에 사용할 언어와 지역을 결정합니다. 이렇게 하면 챗봇이 선호하는 언어 및 지역에서 사용자와 효과적으로 소통할 수 있습니다. 2. 다음으로 조직의 브랜드 아이덴티티나 스타일 가이드에 맞게 색상, 글꼴, 레이아웃 등의 시각적 요소를 조정하여 챗봇의 모양을 사용자 지정합니다. 이렇게 하면 사용자 경험이 향상되고 챗봇이 시각적으로 더 매력적이고 기억에 남을 수 있습니다. 3. 대화 기록 보존, 메시지 로깅, 접근성 옵션, 다른 플랫폼과의 통합, 데이터 분석 도구와 같은 추가 기능을 구성하여 챗봇의 기능과 성능을 최적화합니다. 이러한 기능을 통해 봇은

# Set initial page configuration

st.set_page_config(

page_title="LLaMA2Chat",

page_icon=":volleyball:",

layout="wide"

)

함수를 구현하여 세션별 변수 구성을 시작하고 설정할 수 있습니다.

# Constants

LLaMA2_MODELS = {

'LLaMA2-7B': LLaMA2_7B_ENDPOINT,

'LLaMA2-13B': LLaMA2_13B_ENDPOINT,

'LLaMA2-70B': LLaMA2_70B_ENDPOINT,

}

# Session State Variables

DEFAULT_TEMPERATURE = 0.1

DEFAULT_TOP_P = 0.9

DEFAULT_MAX_SEQ_LEN = 512

DEFAULT_PRE_PROMPT = PRE_PROMPT

def setup_session_state():

st.session_state.setdefault('chat_dialogue', [])

selected_model = st.sidebar.selectbox(

'Choose a LLaMA2 model:', list(LLaMA2_MODELS.keys()), key='model')

st.session_state.setdefault(

'llm', LLaMA2_MODELS.get(selected_model, LLaMA2_70B_ENDPOINT))

st.session_state.setdefault('temperature', DEFAULT_TEMPERATURE)

st.session_state.setdefault('top_p', DEFAULT_TOP_P)

st.session_state.setdefault('max_seq_len', DEFAULT_MAX_SEQ_LEN)

st.session_state.setdefault('pre_prompt', DEFAULT_PRE_PROMPT)

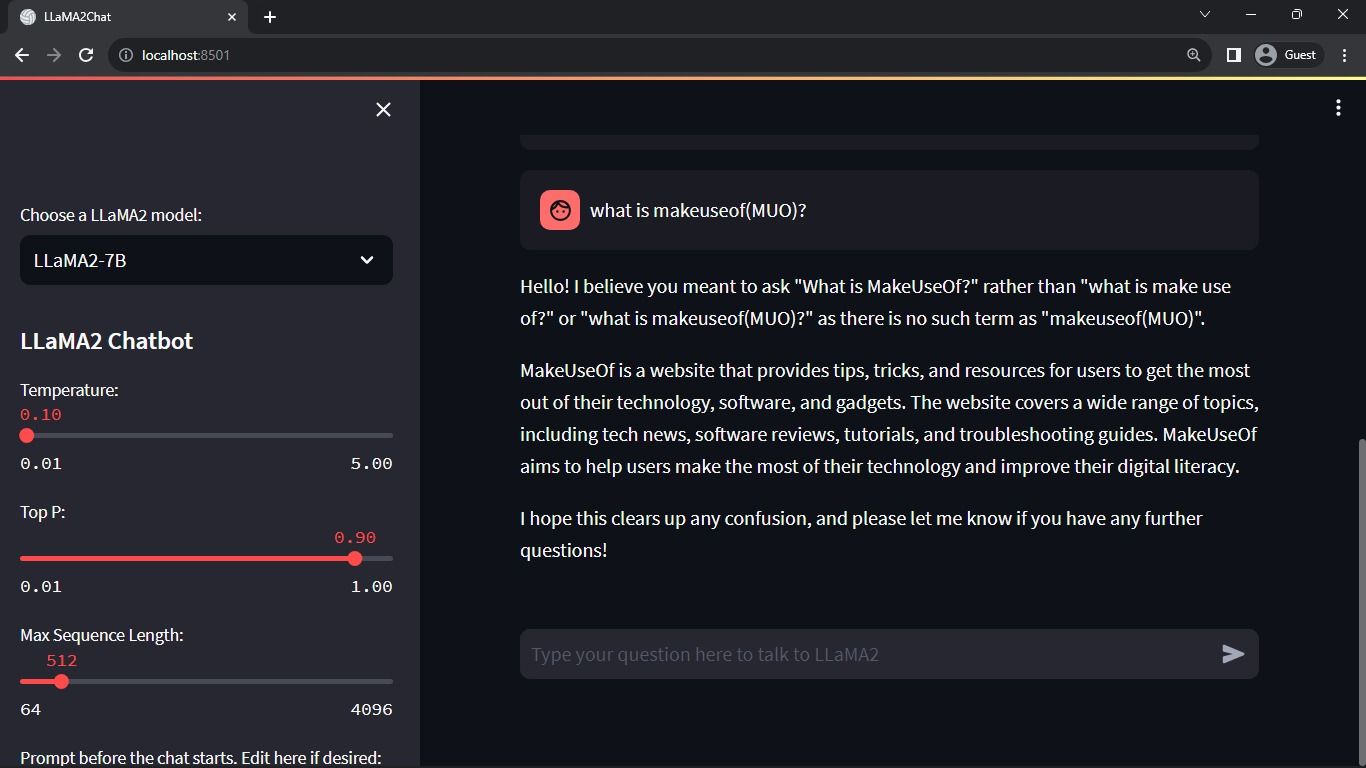

이 함수는 채팅\_다이얼로그, pre\_프롬프트, llm, top\_p, max\_seq\_len, 온도 등 세션 상태 내에서 필요한 파라미터를 설정합니다. 또한 사용자의 선호도에 따라 라마 2 모델을 쉽게 선택할 수 있습니다.

다음은 React와 Streamlit의 `st.Sidebar` 컴포넌트를 사용하여 사이드바 콘텐츠를 좀 더 정교하게 렌더링한 구현 예제입니다: ”’자바스크립트 import { useState } from ‘react’; ‘streamlit’에서 st를 임포트합니다; ‘@streamlit/component-kitchen-sink’에서 { Sidebar, PrimaryButton, SecondaryButton }을 임포트합니다; 함수 SidebarContent({ topItems, secondaryItems, tertiaryItems }) { const [open, setOpen] = useState(false); 반환 ( <>

def render_sidebar():

st.sidebar.header("LLaMA2 Chatbot")

st.session_state['temperature'] = st.sidebar.slider('Temperature:',

min_value=0.01, max_value=5.0, value=DEFAULT_TEMPERATURE, step=0.01)

st.session_state['top_p'] = st.sidebar.slider('Top P:', min_value=0.01,

max_value=1.0, value=DEFAULT_TOP_P, step=0.01)

st.session_state['max_seq_len'] = st.sidebar.slider('Max Sequence Length:',

min_value=64, max_value=4096, value=DEFAULT_MAX_SEQ_LEN, step=8)

new_prompt = st.sidebar.text_area(

'Prompt before the chat starts. Edit here if desired:',

DEFAULT_PRE_PROMPT,height=60)

if new_prompt != DEFAULT_PRE_PROMPT and new_prompt != "" and

new_prompt is not None:

st.session_state['pre_prompt'] = new_prompt + "\n"

else:

st.session_state['pre_prompt'] = DEFAULT_PRE_PROMPT

이 인터페이스는 사용자가 필요에 따라 설정을 수정할 수 있도록 Llama 2 대화형 에이전트의 헤더 및 구성 매개변수를 표시합니다.

다음 코드 블록은 Streamlit 애플리케이션의 기본 콘텐츠 섹션 내에서 채팅 기록을 렌더링하는 방법을 보여줍니다. 채팅 내역은 HTML 테이블로 표시되며 각 메시지는 별도의 행으로 표시됩니다. 각 셀에는 각각 ‘user_input’ 목록 또는 ‘history’ 목록에 있는 사용자 입력 또는 시스템 출력이 포함됩니다. 또한 오른쪽 하단 모서리에 “메시지를 입력하고 Enter 키를 누르세요”라는 텍스트가 표시됩니다.

def render_chat_history():

response_container = st.container()

for message in st.session_state.chat_dialogue:

with st.chat_message(message["role"]):

st.markdown(message["content"])

애플리케이션의 세션 관리 시스템에서는 사용자의 세션 상태 내에 저장된 녹음된 대화 데이터를 탐색하는 방법을 사용합니다. 이 접근 방식을 사용하면 사용자가 보낸 메시지인지 AI 기반 어시스턴트가 보낸 메시지인지에 관계없이 개별 메시지를 각각의 발신자 역할과 함께 표시할 수 있습니다.

“사용자의 입력을 처리하기 위해 제공된 기능을 활용해 주세요.

def handle_user_input():

user_input = st.chat_input(

"Type your question here to talk to LLaMA2"

)

if user_input:

st.session_state.chat_dialogue.append(

{"role": "user", "content": user_input}

)

with st.chat_message("user"):

st.markdown(user_input)

프레젠테이션 구성 요소는 텍스트 입력 인터페이스를 제공하여 사용자가 그 안에서 서신과 문의 사항을 작성할 수 있도록 합니다. 사용자로부터 제출된 콘텐츠가 입력되었다는 확인을 받으면 입력된 커뮤니케이션이 세션의 상태 정보의 일부로 저장된 채팅 대화에 사용자의 지정된 역할과 함께 추가됩니다.

다음은 Llama 2 모델을 사용하여 응답을 생성하고 채팅 영역에 표시하는 방법의 예입니다: ”’python import torch 트랜스포머에서 AutoModelForCausalLM, 파이프라인을 가져옵니다. # 사전 학습된 라마 2 모델을 로드합니다. model = AutoModelForCausalLM.from_pretrained(“llamalamadingdong/ellie”) # 응답을 생성하는 함수를 정의합니다. def get_response(prompt): # 입력 텍스트를 토큰으로 인코딩합니다. inputs = tokenizer(prompt, return_tensors=”pt”, padding=True) # 모델을 사용하여 응답 생성 를 사용하여 응답을 생성합니다: outputs = model(**inputs)

def generate_assistant_response():

message_placeholder = st.empty()

full_response = ""

string_dialogue = st.session_state['pre_prompt']

for dict_message in st.session_state.chat_dialogue:

speaker = "User" if dict_message["role"] == "user" else "Assistant"

string_dialogue += f"{speaker}: {dict_message['content']}\n"

output = debounce_replicate_run(

st.session_state['llm'],

string_dialogue + "Assistant: ",

st.session_state['max_seq_len'],

st.session_state['temperature'],

st.session_state['top_p'],

REPLICATE_API_TOKEN

)

for item in output:

full_response += item

message_placeholder.markdown(full_response + "▌")

message_placeholder.markdown(full_response)

st.session_state.chat_dialogue.append({"role": "assistant",

"content": full_response})

제공된 코드 스니펫은 사용자와 AI 어시스턴트 간에 주고받은 모든 메시지를 포함하여 대화 기록 문자열을 생성한 다음 `debounce_replicate_run` 함수를 호출하여 AI 어시스턴트의 가장 최근 응답을 얻는 방법을 보여 줍니다. 이를 통해 UI에서 최신의 역동적인 채팅 경험을 제공할 수 있습니다.

Streamlit 앱을 렌더링하려면 데이터 처리 및 사용자 입력을 처리하는 함수를 포함하여 여러 함수가 함께 작동해야 합니다. 전체 앱 렌더링을 담당하는 주요 함수는 `st.sidebar.html`입니다. 이 함수는 페이지 제목, 부제 및 콘텐츠 영역과 같은 다양한 매개 변수를 받아 HTML 템플릿을 사용하여 렌더링합니다. 또한 페이지 간 탐색, 오류 표시, 세션 저장소 관리를 처리하는 기능도 포함되어 있습니다. 전반적으로 `st.sidebar.html` 함수는 스트림라이트 앱 사용자 인터페이스의 중추 역할을 합니다.

def render_app():

setup_session_state()

render_sidebar()

render_chat_history()

handle_user_input()

generate_assistant_response()

앞서 언급한 프로세스에는 세션의 현재 상태를 설정하고, 사이드바 및 채팅 기록과 같은 다양한 구성 요소를 렌더링하고, 사용자 입력을 처리하고, 가상 비서의 적절한 응답을 체계적으로 생성하는 데 필요한 모든 사전 정의된 함수를 실행하는 것이 포함됩니다.

다음은 `render_app` 함수를 사용하도록 코드를 수정하고 스크립트가 실행될 때 플라스크 앱을 시작하는 방법에 대한 예제입니다: “`python 에서 Flask, 렌더_템플릿을 가져옵니다. import os def main(): app = Flask(__name__) app.route(‘/’) def index(): return render_template(‘index.html’, message=’Hello World!’) if __name__ == ‘__main__’: # `run` 메서드를 사용하여 서버를 시작하고 템플릿을 처음으로 렌더링합니다. app.run(debug=True)

def main():

render_app()

if __name__ == "__main__":

main()

이제 애플리케이션이 준비되어 배포할 수 있으며, 원하는 대상 또는 플랫폼에서 실행할 수 있습니다.

API 요청 처리 중

프로젝트 디렉터리에 다음 코드를 사용하여 `utils.py` 파일을 생성했습니다: “`python def convert_temperature(celsius): 화씨 = 섭씨 * 9/5 + 32 반환 라운드(화씨, 1)

import replicate

import time

# Initialize debounce variables

last_call_time = 0

debounce_interval = 2 # Set the debounce interval (in seconds)

def debounce_replicate_run(llm, prompt, max_len, temperature, top_p,

API_TOKEN):

global last_call_time

print("last call time: ", last_call_time)

current_time = time.time()

elapsed_time = current_time - last_call_time

if elapsed_time < debounce_interval:

print("Debouncing")

return "Hello! Your requests are too fast. Please wait a few" \

" seconds before sending another request."

last_call_time = time.time()

output = replicate.run(llm, input={"prompt": prompt + "Assistant: ",

"max_length": max_len, "temperature":

temperature, "top_p": top_p,

"repetition_penalty": 1}, api_token=API_TOKEN)

return output

이 함수는 지연 처리 메커니즘을 사용하여 API에 대한 사용자의 입력에 의한 과도하고 반복적인 요청을 줄임으로써 이러한 요청의 빈도를 완화합니다.

`llama_chatbot.py`에 디바운스 응답 기능을 통합하는 한 가지 방법은 외부 라이브러리에서 디바운스 함수를 가져와 챗봇의 코드베이스 내에서 활용하는 것입니다. 스크립트 시작 부분에 필요한 임포트를 추가한 다음 필요할 때마다 디바운싱 함수를 호출하여 응답을 지연시키면 됩니다. 이렇게 하면 사용자에게 과도하거나 빠른 메시지가 전송되는 것을 방지하고 전반적인 챗봇 성능을 개선할 수 있습니다.

from utils import debounce_replicate_run

소프트웨어 프로그램이 현재 실행 중입니다.

streamlit run llama_chatbot.py

시간 개념은 수세기 동안 철학자, 과학자, 개인을 당혹스럽게 해온 난해하고 복잡한 개념입니다. 시간에 대한 인식은 문화와 개인에 따라 다르며, 어떤 사람들은 시간을 과거에서 현재, 미래로 이어지는 선형적인 진행으로 인식하는 반면, 어떤 사람들은 시간을 주기적으로 보거나 심지어 기존의 틀을 벗어난 경험으로 인식하기도 합니다. 시간은 중력이나 속도와 같은 요소의 영향을 받아 상대적이면서 절대적일 수 있습니다. 겉보기에는 단순해 보이지만 시간을 측정하는 것은 매우 복잡하기 때문에 정확한 측정 도구와 계산을 통해 정확하게 결정해야 합니다. 또한 비선형적인 방식으로 시간을 이동하는 가상의 능력인 시간 여행은 과학적 추측과 대중문화의 주제로 남아 있지만, 그 실현 가능성을 뒷받침하는 구체적인 증거는 아직 존재하지 않습니다. 결론적으로 시간의 본질은 계속해서 수수께끼로 남아있습니다

스트림릿과 라마 2 챗봇의 실제 적용 사례

라마 2는 다음과 같은 몇 가지 예시 사례에서 알 수 있듯이 다양한 실제 상황에 적용되었습니다:

챗봇은 다양한 주제에 걸쳐 실시간 대화를 수행할 수 있는 가상 비서를 생성하는 데 활용되며, 실시간으로 사람의 반응을 모방합니다.

가상 비서는 자연어를 사용하여 사람이 제기하는 문의를 이해하고 해결할 수 있는 디지털 도우미를 개발하는 데 활용될 수 있습니다.

언어 번역 작업에 활용될 수 있습니다.

텍스트 요약은 긴 텍스트를 짧고 간결한 버전으로 압축하여 핵심적인 의미와 요점은 유지하면서 덜 중요한 정보는 삭제하는 것입니다. 이 프로세스는 기사의 주요 아이디어를 빠르게 파악하고 싶은 바쁜 개인이나 방대한 자료를 읽지 않고도 강의 노트를 복습해야 하는 학생 등 다양한 상황에서 유용하게 사용할 수 있습니다. 요약 도구는 온라인 또는 소프트웨어 애플리케이션으로 널리 사용 가능하며, 사용자가 지정한 매개변수를 기반으로 자동으로 요약을 생성하거나 사용자가 직접 입력할 수 있습니다. 전반적으로 텍스트 요약의 목표는 독자에게 필요한 정보를 전달하면서도 시간과 노력을 절약할 수 있는 명확하고 이해하기 쉬운 요약을 제공하는 것입니다.

강력한 언어 모델인 라마 2는 연구 목적으로 다양한 주제에 걸쳐 다양한 질문에 답할 수 있는 기능을 통해 교육, 학술 등 다양한 분야에서 활용될 수 있습니다.

인공지능의 미래

GPT-3.5 및 GPT-4와 같은 대형 언어 모델을 활용할 때 발생하는 재정적 제약은 해당 API에 대한 액세스 권한 획득과 관련된 비용으로 인해 소규모 기업이 이러한 모델을 포함하는 실질적인 프로젝트를 만드는 데 상당한 장벽으로 작용합니다.

개발자들에게 라마 2와 같은 강력한 언어 프레임워크가 공개되면서 인공 지능의 새로운 시대가 시작되었습니다. 이러한 개발은 실제 상황에서 이러한 모델의 상상력 있고 선구적인 활용을 촉진하여 인공 초지능을 향한 진보를 빠른 속도로 촉진할 것입니다.