대규모 언어 모델을 활용하면 대화에 참여하고 다양한 수준의 정확성을 갖춘 응답을 제공할 수 있기 때문에 일상 생활과 직업 수행 방식을 크게 변화시킬 수 있습니다.

LLM 제공업체에 계정을 개설하고 웹 애플리케이션 또는 독립형 프로그램을 통해 로그인하여 대규모 언어 모델을 운영할 수 있습니다. 그러나 인터넷에 연결하지 않고도 Linux 시스템에서 로컬로 모든 기능을 갖춘 대규모 언어 모델을 호스팅할 수도 있습니다.

Linux에서 대규모 언어 모델을 실행하는 이유는 무엇인가요?

아마존 알렉사나 애플 시리 같은 AI 비서가 현대 가정에 보편화되면서 화면에 아무것도 입력하지 않고도 음성 명령으로 스마트 기기를 제어하거나 질문에 대한 답변을 쉽게 얻을 수 있게 되었습니다.

기존 검색 엔진을 넘어 인공지능 챗봇을 활용하면 질문에 답하고, 구절을 만들고, 학업 과제를 대신 완료하는 등 다양한 활동에 참여할 수 있습니다.

온라인 플랫폼을 통한 LLM의 활용은 언제든지 철회될 수 있는 제3자 공급업체의 자선에 의존합니다.

귀하의 활용에도 특정 제한 사항이 적용됩니다. 예를 들어 나치 독일을 배경으로 한 6,000단어 분량의 에로틱 소설을 작성해 달라고 OpenAI에 요청하면 “죄송하지만 그 이야기는 만들어 드릴 수 없습니다.”와 같은 응답이 돌아옵니다.

온라인 언어 모델을 통해 제공하는 정보는 지속적인 학습에 활용되며, 비공개로 유지하고자 하는 민감한 데이터는 나중에 다른 개인의 문의에 대한 응답의 일부로 공개될 수 있습니다.

플랫폼 사용량이 많기 때문에 적절한 서비스 수준을 유지하기 위해 특정 기능을 제한하거나 결제를 요청해야 할 수 있습니다. 이로 인해 불편을 끼쳐 드려 죄송하며, 이러한 사항에 대해 양해해 주셔서 감사합니다.

Dalai는 무료로 제공되는 오픈소스 애플리케이션으로, Meta의 LLaMa LLM과 스탠포드의 알파카(Alpaca)를 구현합니다. 이 프로그램은 적당한 하드웨어 리소스에서도 원활하게 작동하며 다양한 프롬프트 템플릿과 함께 사용자 친화적인 웹 인터페이스를 자랑하므로 사용자는 잠재적인 계정 폐쇄, 응답하지 않는 LLM 또는 연결 문제에 대한 걱정 없이 원하는 모든 주제에 대해 문의할 수 있습니다.

Linux에 로컬 언어 모델(LLM)을 설치하면 단독 소유권을 획득하여 설치자가 해당 모델을 제한 없이 활용할 수 있습니다.

Linux에 Dalai를 설치하는 방법

Linux에서 Dalai를 손쉽게 설치하려면 Docker와 Docker Compose를 활용하세요. 익숙하지 않은 경우 Docker 및 Docker Compose 설치에 대한 종합 가이드를 참조하세요.

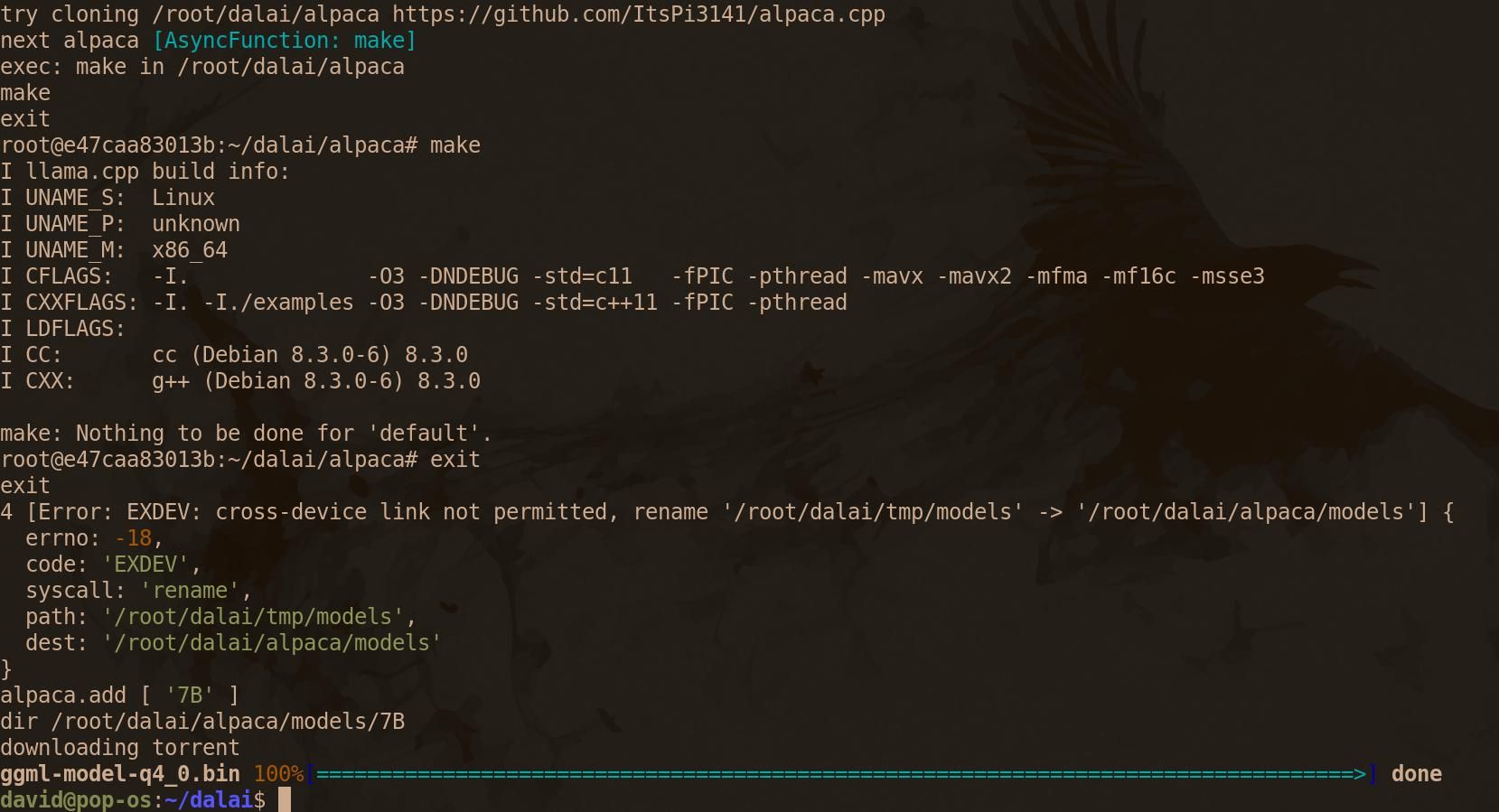

이전 단계를 성공적으로 완료했으므로 이제 Dalai의 설치 프로세스를 시작할 준비가 되었습니다. 계속 진행하려면 “clone” 명령을 사용하여 GitHub에서 Dalai 리포지토리를 복제한 다음 “cd” 명령을 사용하여 해당 리포지토리로 이동하세요.

git clone https://github.com/cocktailpeanut/dalai.git && cd dalaiDalai가 그래픽 사용자 인터페이스가 있는 애플리케이션으로 작동하도록 하려면 먼저 Docker Compose 파일을 구성해야 합니다.

docker-compose buildDocker Compose 유틸리티는 Python 버전 3.11과 노드 버전 관리자(NVM) 및 Node.js를 검색하고 설정해야 합니다.

Docker Compose가 Dalai를 다운로드하는 동안 빌드 프로세스가 9단계 중 7단계에서 일시적으로 중단된 것으로 보입니다. 이러한 일시적인 정체에도 불구하고 여전히 백그라운드에서 여러 단계가 수행되고 있습니다. 우려를 덜기 위해 인터넷 사용량을 모니터링하여 작업 진행 상황을 확인하거나, 대기 기간 동안 명령줄 인터페이스를 통해 가상 유기체의 시뮬레이션된 진화를 관찰할 수 있습니다.

궁극적으로 명령 프롬프트로 다시 연결됩니다.

달라이와 LLaMa/알파카 모델 모두 최적의 기능을 발휘하기 위해서는 상당한 양의 메모리가 필요하다는 사실이 알려졌습니다. 구체적인 가이드라인은 정해져 있지 않지만 일반적으로 7B 모델은 4GB, 13B 모델은 8GB, 30B 모델은 16GB, 65B 모델은 32GB의 메모리가 필요한 것으로 권장됩니다.

알파카 모델은 적당한 크기이며, 13B 버전은 7.6GB의 적당한 저장 공간을 차지합니다. 그러나 대용량 언어 모델(LLaMA)의 무게는 상당할 수 있으며, 해당 13B 다운로드에는 60.21GB의 메모리가 필요하고 65B 모델은 하드 드라이브에서 상당한 0.5테라바이트의 저장 공간을 소비합니다.

사용 가능한 리소스에 맞는 모델을 선택하고 다음 지시어를 사용하여 설치하십시오:

docker-compose run dalai npx dalai alpaca install 13B잘 설치하셨나요. 문제 없이 잘 설치될 텐데요. 아래 명령으로 알파카가 아닌 라마 모델을 설치할 수 있습니다.

docker-compose run dalai npx dalai llama install 13B혹시 문제가 발생한다면? 달라이를 통해 다운로드한 모델이 손상되었을 가능성이 있습니다. 이 경우 허깅 페이스 에서 다운로드하세요.

명령 프롬프트로 돌아오면 연결이 끊긴 상태에서 Docker Compose 세션을 시작합니다.

docker-compose up -d컨테이너의 현재 상태를 검사하여 컨테이너가 제대로 작동하는지 확인합니다.

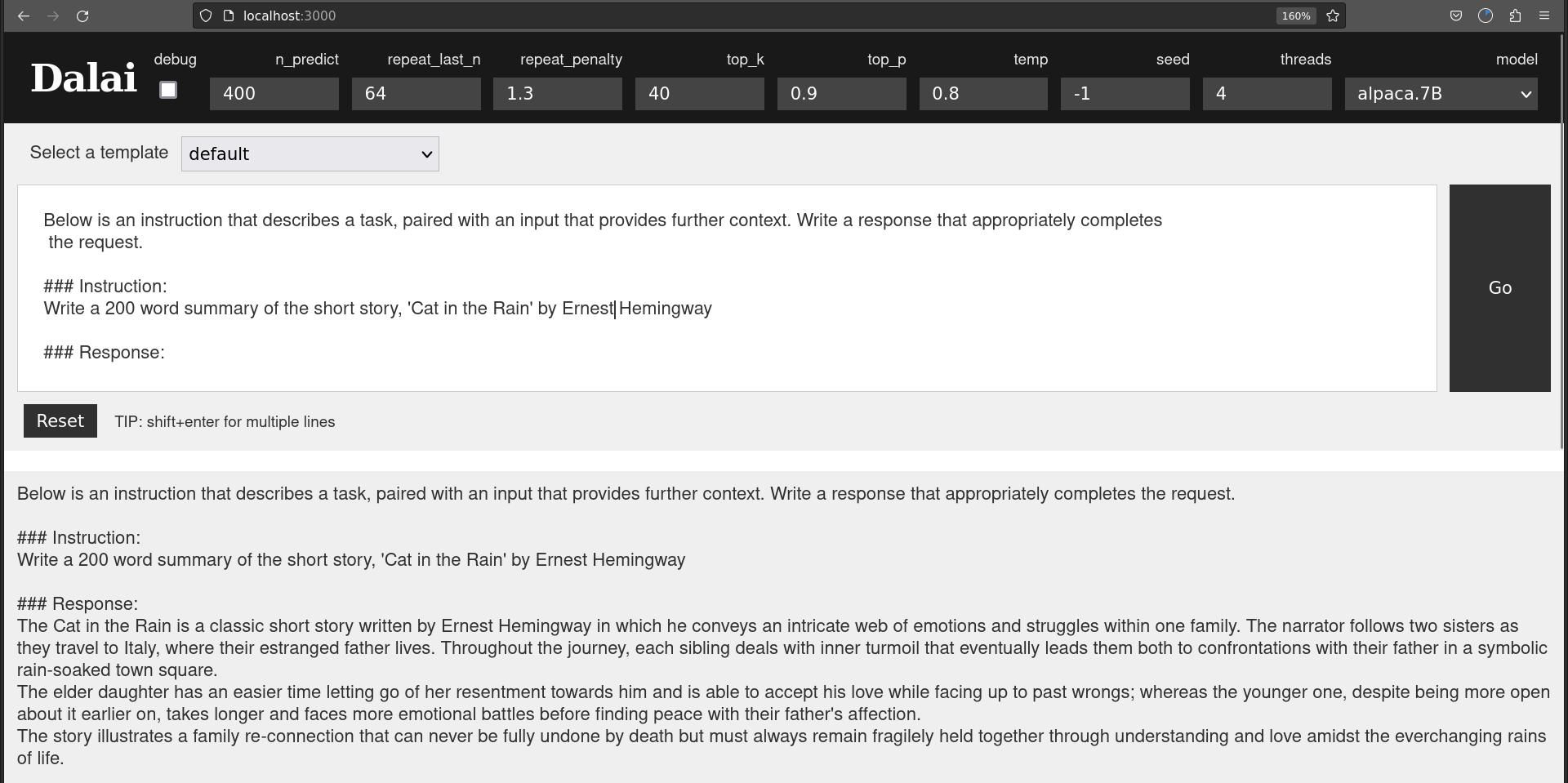

docker-compose ps브라우징 애플리케이션으로 이동하여 모든 기능이 올바르게 작동하는지 주소 표시줄에 “localhost:3000” URL을 입력하세요.

Linux에서 나만의 대형 언어 모델을 즐겨보세요

웹 인터페이스를 열면 문의 사항을 입력할 수 있는 텍스트 입력란이 표시됩니다.

매력적인 프롬프트를 만드는 것은 어려운 작업일 수 있으며, Dalai의 개발자들은 Dalai로부터 유익한 답변을 이끌어내는 데 도움이 되는 다양한 템플릿을 기꺼이 제공했습니다.

AI 대화, 챗봇, 기본값, 지시, 재작성, 번역, 트위터 게시물에 대한 감성 분석

AI 대화 및 챗봇 템플릿은 유한책임회사(LLM)와 대화를 나눌 수 있는 특정 구조를 가지고 있습니다. 두 개체 모두 이러한 특성을 공유하지만 챗봇은 뛰어난 지능을 발휘하도록 설계된 반면, AI-Dialog는 도움이 되고, 예의 바르고, 규정을 준수하고, 진실하며, 자신의 한계를 스스로 인식하는 자질을 보여주도록 설계되었습니다.

물론, 그것은 옵션입니다. 챗봇의 매개 변수를 조정하여 지능이 떨어지고 응답이 없어져 가학적이고 비생산적인 대화가 이루어지도록 만들 수 있습니다. 이 변경은 귀하의 재량에 따라 결정됩니다.

번역 기능에 대한 평가는 달라이를 사용하여 BBC 뉴스 기사의 첫 구절을 스페인어로 번역한 다음 Google 번역을 통해 다시 영어로 재번역하는 방식으로 이루어졌습니다. 그 결과 번역된 텍스트는 언어 구조와 표현이 원본 자료와 매우 유사하여 정확하고 이해하기 쉬운 것으로 판명되었습니다.

마찬가지로 재구성 템플릿은 콘텐츠를 새로운 작품의 시작 부분으로 능숙하게 변형했습니다.

기본 및 명령 프롬프트는 사용자가 달라이에게 질문을 던질 수 있을 뿐만 아니라 달라이의 행동에 대한 명시적인 지침을 제공할 수 있도록 설계되었습니다.

달라이가 사용자의 쿼리에 응답하는 성능은 사용되는 특정 모델에 따라 크게 달라질 수 있습니다. 특히 30B 모델을 사용하면 7B 모델에 비해 정확도가 더 높아집니다.그러나 LLM은 문장 내에서 다음 단어를 예측하도록 설계된 고급 도구일 뿐이라는 점을 인식하는 것이 중요합니다.

7B 및 13B 알파카 모델은 어니스트 헤밍웨이가 쓴 “빗속의 고양이”라는 단편 소설의 약 200개 단어에 대한 신뢰할 수 있는 요약을 생성하는 데 실패했습니다. 두 모델 모두 이야기 내용에 관한 상당한 세부 사항으로 가득 찬 정교한 내러티브를 만들어냈습니다.

달라이 시스템은 잠재적으로 민감한 주제에서 발생할 수 있는 윤리적 고려 사항과 관계없이 사용자가 원하는 출력물에 대한 명시적인 지침 또는 기본 요청을 제공할 수 있는 옵션을 제공합니다. 이 기능을 통해 개인은 자신의 특정 요구에 맞게 응답을 조정할 수 있으며, 생성된 콘텐츠를 완벽하게 제어할 수 있습니다.

Linux 머신의 대규모 언어 모델은 여러분의 것입니다

개인 Linux 기기에서 강력한 언어 모델을 활용하면 자율성과 서비스 조사 또는 해지로부터의 자유를 누릴 수 있습니다. 기업 콘텐츠 가이드라인의 잠재적 위반에 대한 우려 없이 적절하다고 판단되는 대로 자유롭게 사용할 수 있습니다.

컴퓨팅 리소스가 제한적인 경우 저비용 Raspberry Pi 플랫폼에 언어 모델(LLM)을 로컬로 설치하는 것이 가능합니다.